LangChain4j

理论概述

介绍

LangChain4j 等价于 LangChain For Java

LangChain4j 的目标是简化将 LLM 集成到 Java 应用程序中的过程。

具体方式如下:

- 统一 API: LLM 提供商(如 OpenAI 或 Google Vertex AI)和嵌入(向量)存储(如 Pinecone 或 Milvus) 使用专有 API。LangChain4j 提供统一的 API,避免了学习和实现每个特定 API 的需求。 要尝试不同的 LLM 或嵌入存储,您可以在它们之间轻松切换,无需重写代码。 LangChain4j 目前支持 15+ 个流行的 LLM 提供商 和 20+ 个嵌入存储。

- 全面的工具箱: 自 2023 年初以来,社区一直在构建众多 LLM 驱动的应用程序, 识别常见的抽象、模式和技术。LangChain4j 将这些提炼成一个即用型包。 我们的工具箱包含从低级提示模板、聊天记忆管理和函数调用 到高级模式如代理和 RAG 的工具。 对于每个抽象,我们提供一个接口以及基于常见技术的多个即用型实现。 无论您是在构建聊天机器人还是开发包含从数据摄取到检索完整管道的 RAG, LangChain4j 都提供多种选择。

- 丰富的示例: 这些示例展示了如何开始创建各种 LLM 驱动的应用程序, 提供灵感并使您能够快速开始构建。

LangChain4j 始于 2023 年初 ChatGPT 热潮期间。 我们注意到与众多 Python 和 JavaScript LLM 库和框架相比,缺少 Java 对应物, 我们必须解决这个问题! 虽然我们的名字中有"LangChain",但该项目是 LangChain、Haystack、 LlamaIndex 和更广泛社区的想法和概念的融合,并加入了我们自己的创新。

我们积极关注社区发展,旨在快速整合新技术和集成, 确保您保持最新状态。 该库正在积极开发中。虽然一些功能仍在开发中, 但核心功能已经就位,让您现在就可以开始构建 LLM 驱动的应用程序!

为了更容易集成,LangChain4j 还包括与 Quarkus 和 Spring Boot 的集成。

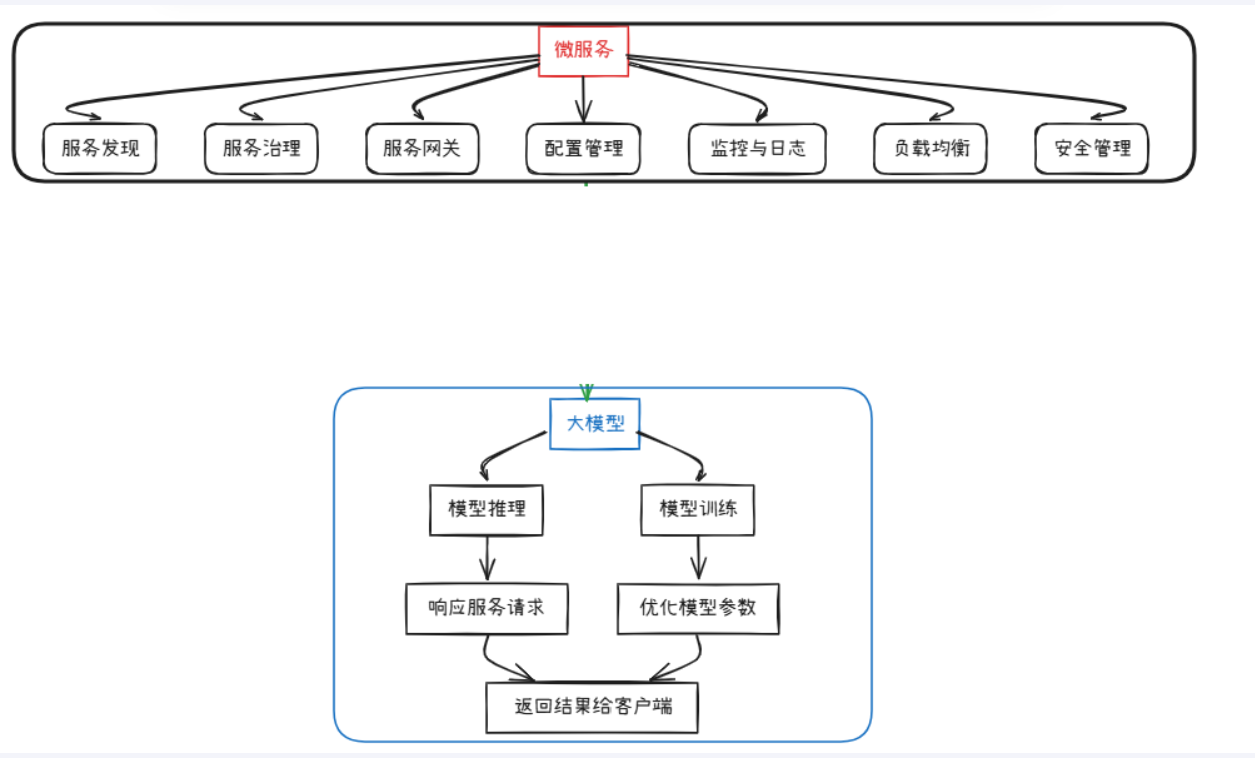

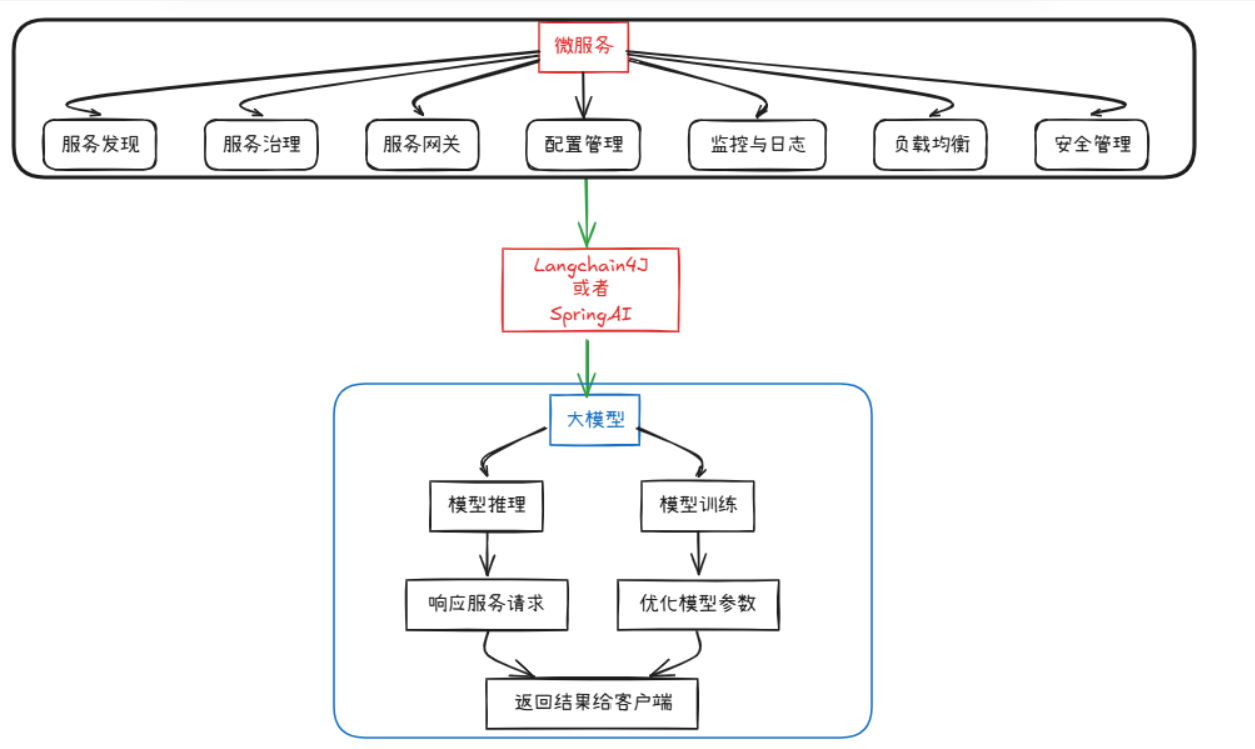

AB法则(Before | After)

随着人工智能(AI)技术的迅猛发展,越来越多的开发者开始将目光投向AI应用的开发。然而,目前市场上大多数AI框架和工具如LangChain、PyTorch等主要支持Python,而Java开发者常常面临工具缺乏和学习门槛较高的问题,但是不用担心,谁让Java/Spring群体强大那?,O(∩_∩)O

任何一个框架/XXX云服务器,想要大面积推广,应该不会忘记庞大的Spring社区和Java程序员

Before(没有 LangChain4j 之前)

各干各的

After(有 LangChain4j 之后)

官网

能干嘛

LLM 大模型能干嘛

- controller

- service

- dao/mapper

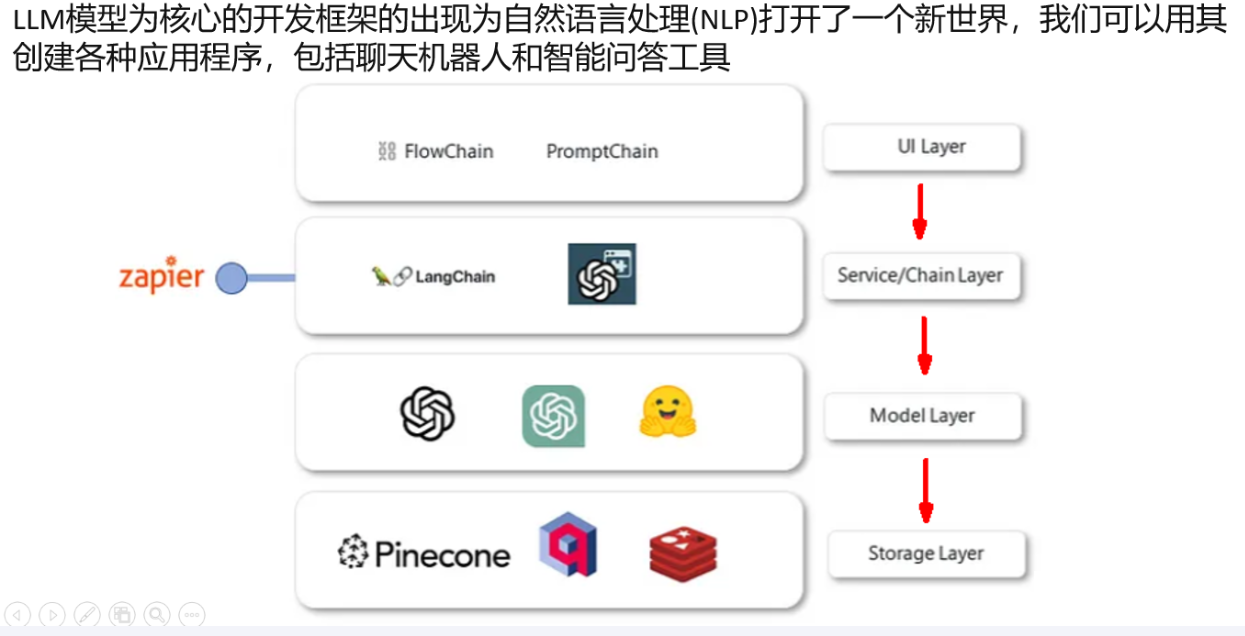

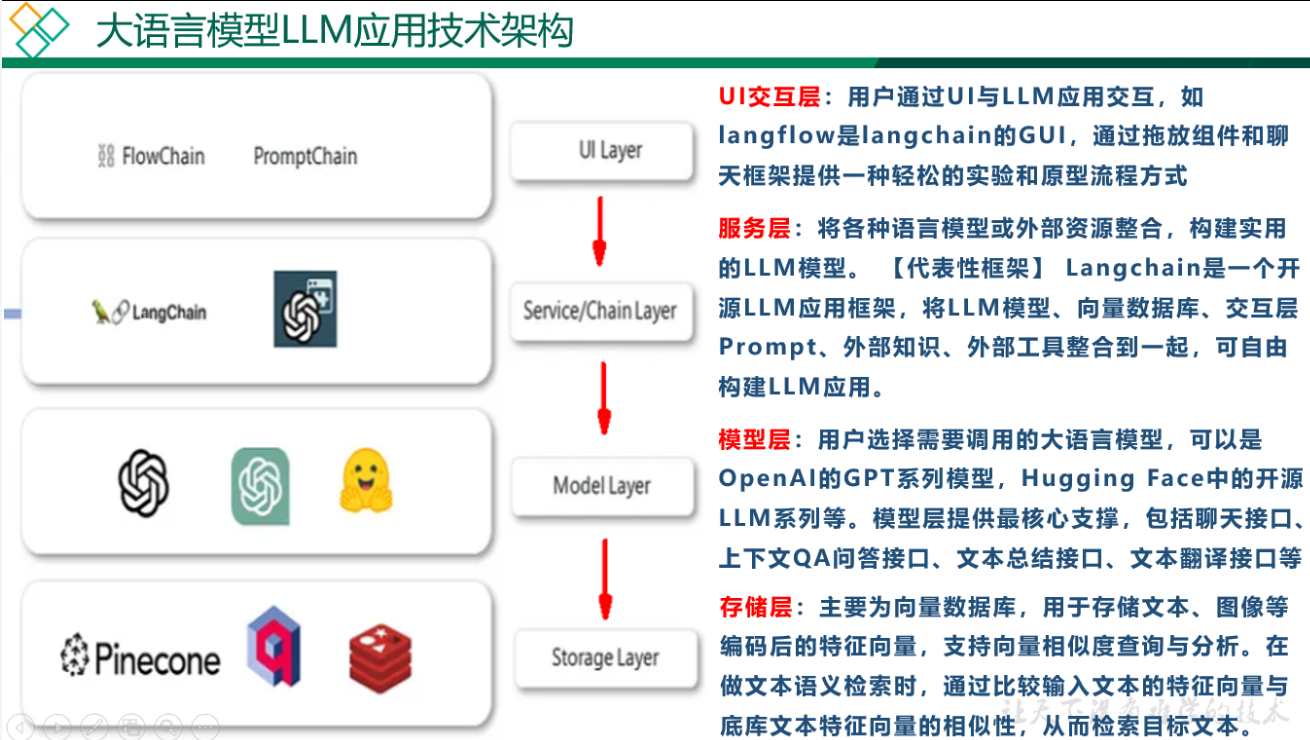

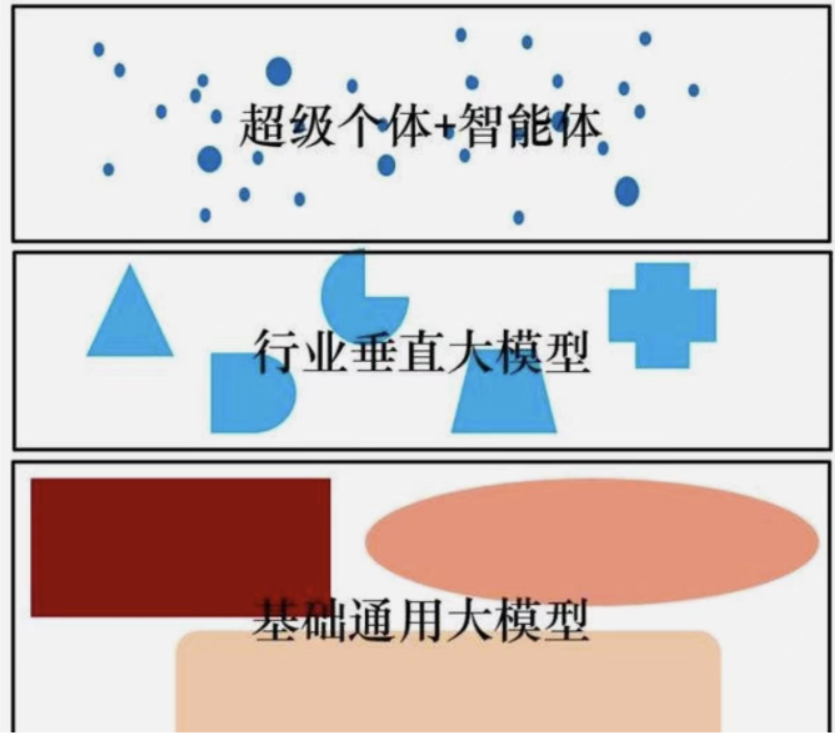

LLM 大模型应用技术架构

去哪下

怎么玩

大模型开发分类

产品定位

永远的HelloWorld

前置约定

LangChain4j支持的各种大模型语言模型(LLMS)

- 中文:https://docs.langchain4j.info/integrations/language-models

- 英文:https://docs.langchain4j.dev/integrations/language-models

本次以阿里百炼平台(通义千问)为主并辅以DeepSeek模型

配置门道和关键点

- 所有调用均基于 OpenAI 协议或者 SpringBoot 官方推荐整合规则,实现一致的接口设计与规范,确保了多模型切换的便利性,提供高度可拓展的开发支持

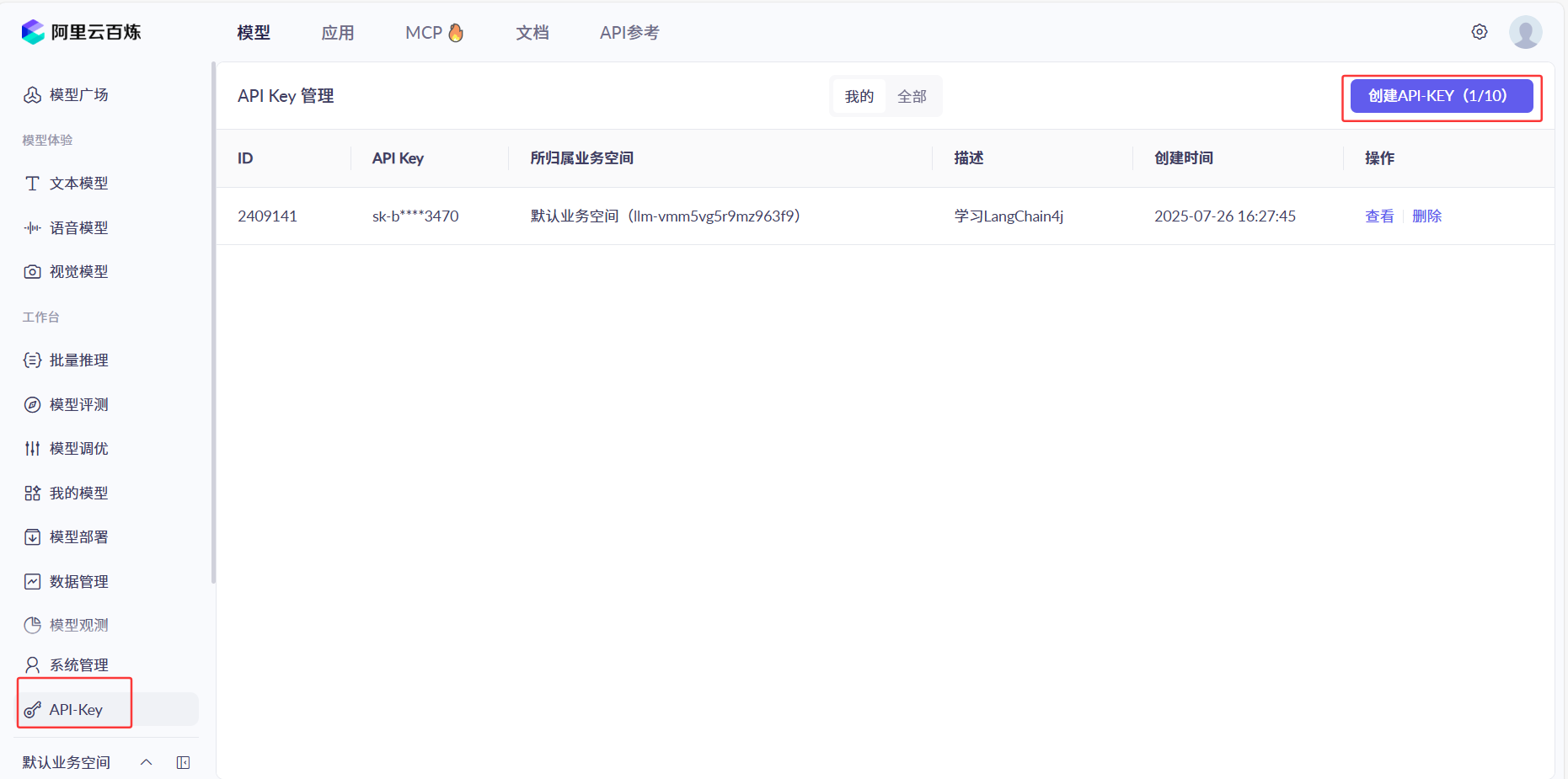

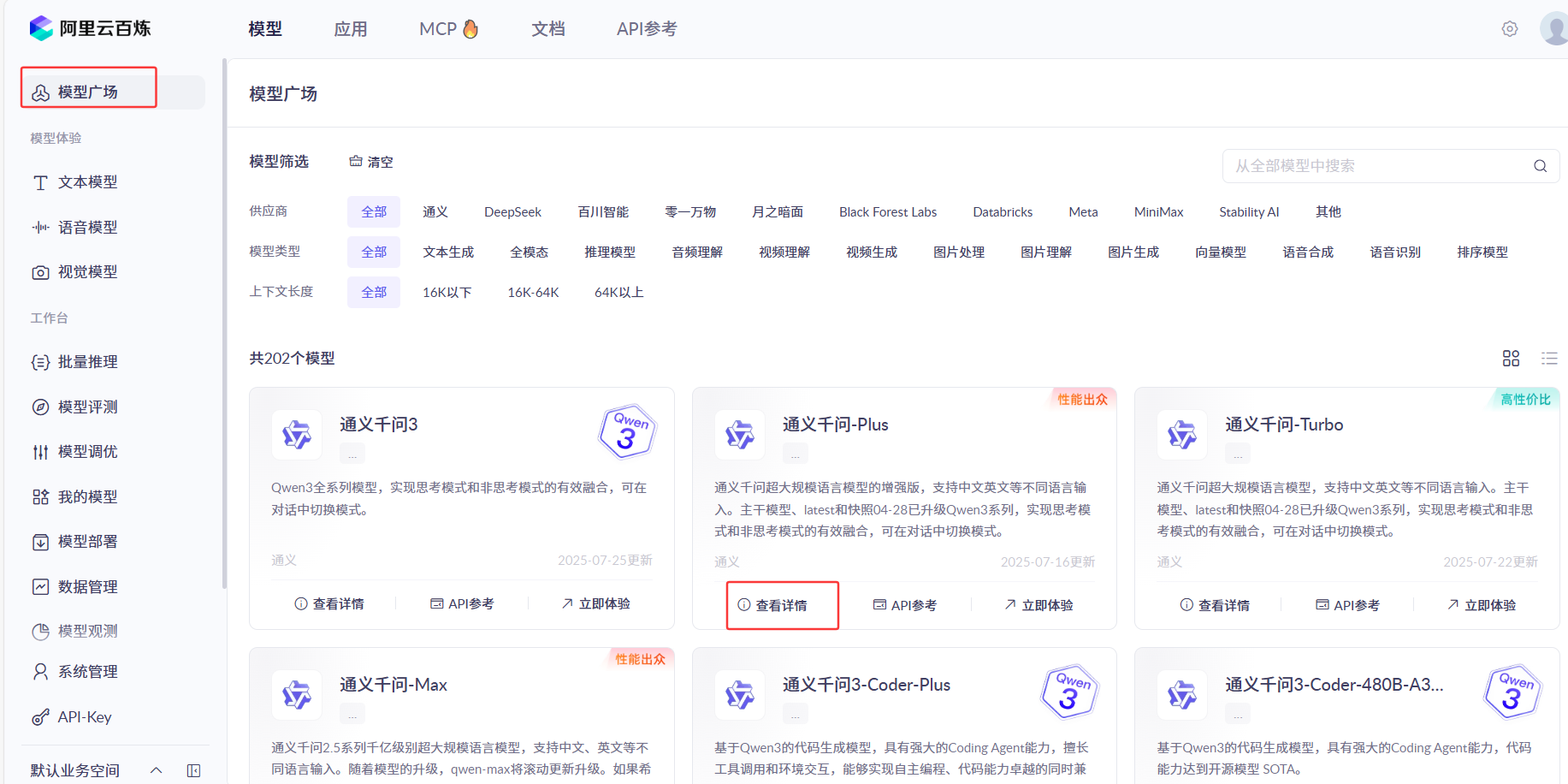

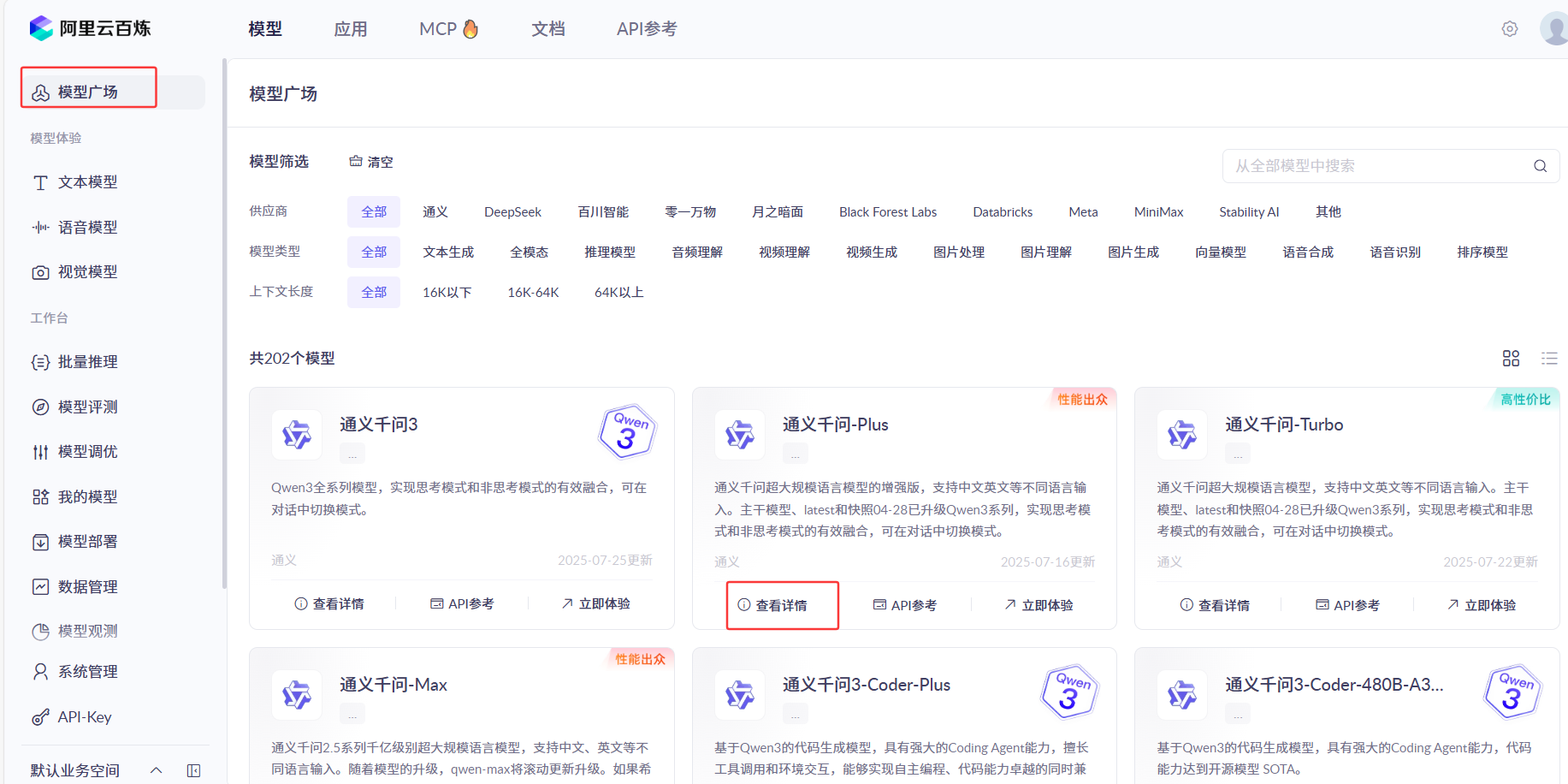

阿里云百炼平台入口

接入阿里百炼平台的通义模型:https://bailian.console.aliyun.com

大模型调用三件套

获得 api-key

先登录并创建API-key

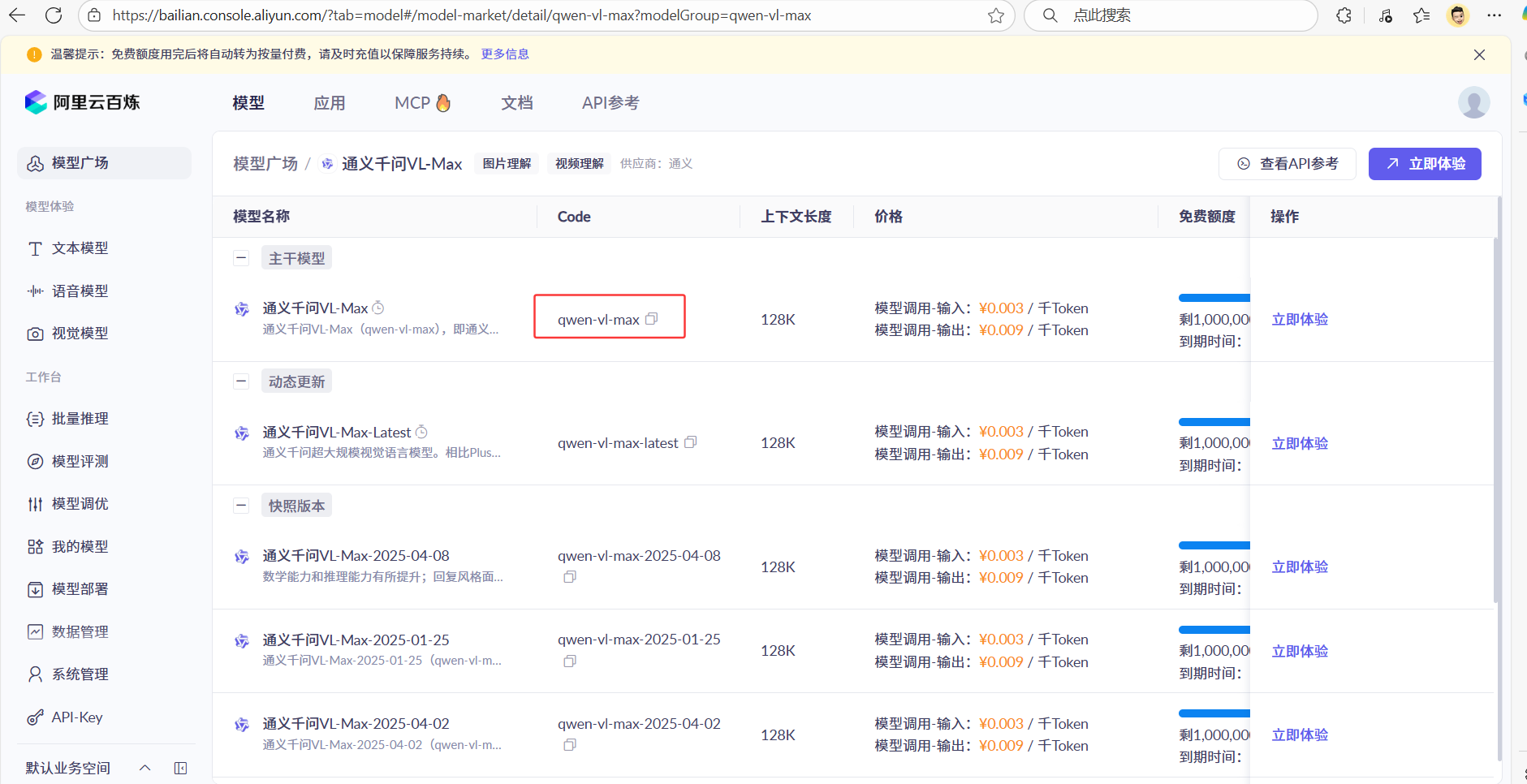

选择想要的模型,点击查看详情

获得模型名

点击模型广场,点击想要的模型,点击查看详情

选择你想要的模型复制下来

例如:模型名:

qwen-plus获得 baseUrl 开发地址

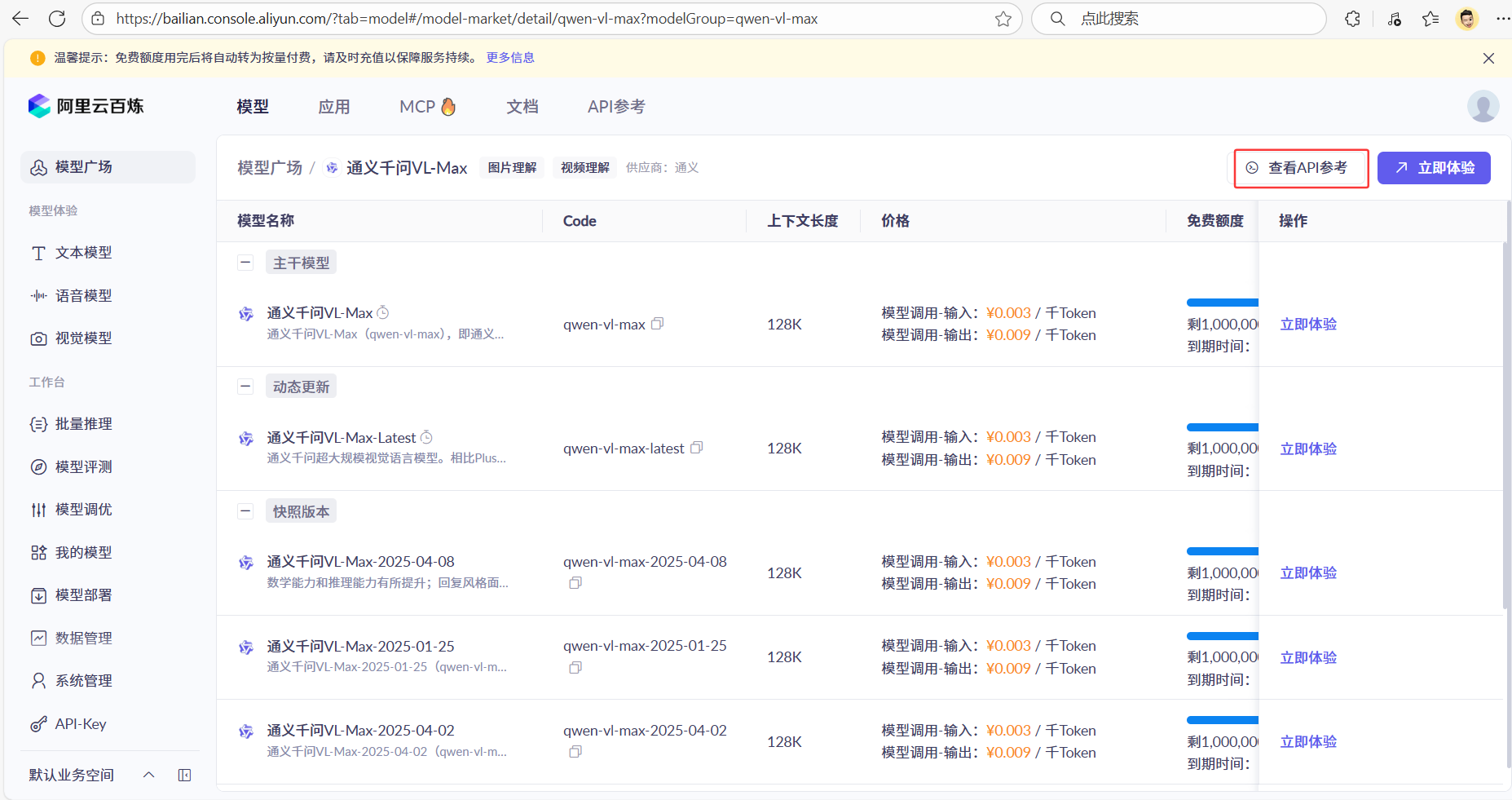

点击查看api参考

假设你要换一个模型实例

总结

API Key

sk-xxx 你自己的 API Key

模型名

qwen-plus

调用地址

使用 SDK 调用时需配置的 base_url:https://dashscope.aliyuncs.com/compatible-mode/v1

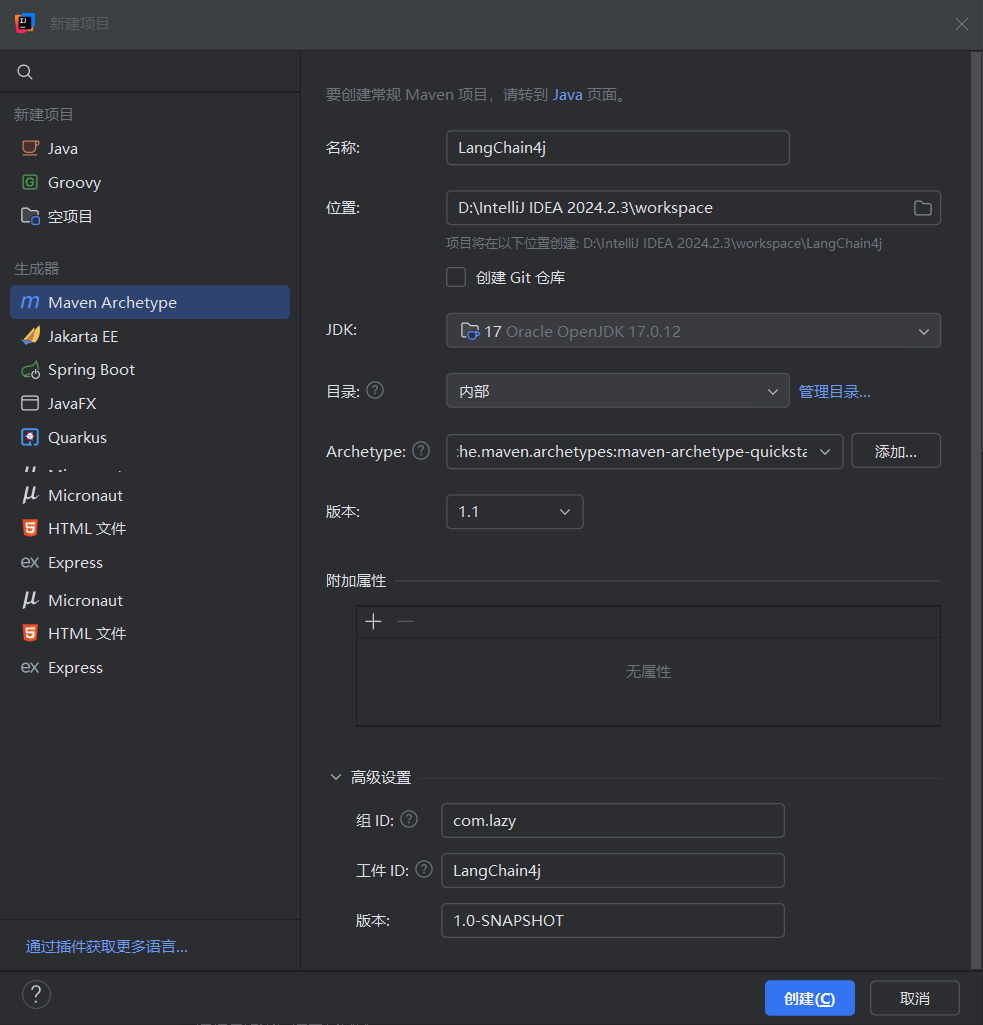

IDEA 工具中建 project 父工程

LangChain4j

pom

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.lazy</groupId>

<artifactId>LangChain4j</artifactId>

<version>1.0-SNAPSHOT</version>

<packaging>pom</packaging>

<name>LangChain4j父工程</name>

<url>http://maven.apache.org</url>

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<project.reporting.outputEncoding>UTF-8</project.reporting.outputEncoding>

<java.version>17</java.version>

<maven.compiler.source>17</maven.compiler.source>

<maven.compiler.target>17</maven.compiler.target>

<!-- Spring Boot -->

<spring-boot.version>3.5.0</spring-boot.version>

<!-- Spring AI -->

<spring-ai.version>1.0.0</spring-ai.version>

<!-- Spring AI Alibaba -->

<spring-ai-alibaba.version>1.0.0-M6.1</spring-ai-alibaba.version>

<!-- langchain4j -->

<langchain4j.version>1.0.1</langchain4j.version>

<!--langchain4j-community 引入阿里云百炼平台依赖管理清单-->

<langchain4j-community.version>1.0.1-beta6</langchain4j-community.version>

<!-- maven plugin -->

<maven-deploy-plugin.version>3.1.1</maven-deploy-plugin.version>

<flatten-maven-plugin.version>1.3.0</flatten-maven-plugin.version>

<maven-compiler-plugin.version>3.8.1</maven-compiler-plugin.version>

</properties>

<dependencyManagement>

<dependencies>

<!-- Spring Boot -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-dependencies</artifactId>

<version>${spring-boot.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!-- Spring AI -->

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-bom</artifactId>

<version>${spring-ai.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!-- Spring AI Alibaba -->

<dependency>

<groupId>com.alibaba.cloud.ai</groupId>

<artifactId>spring-ai-alibaba-starter</artifactId>

<version>${spring-ai-alibaba.version}</version>

</dependency>

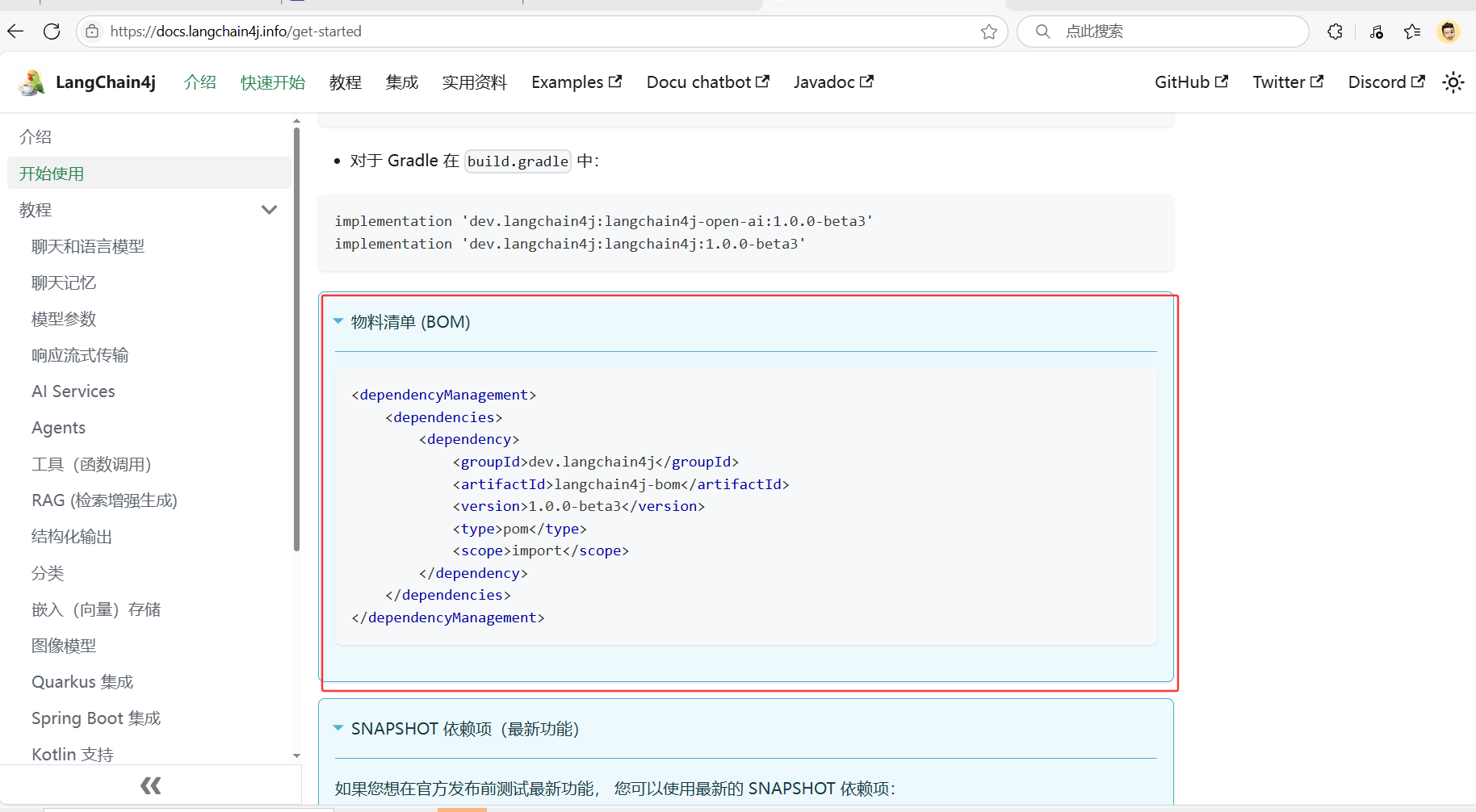

<!--langchain4j的依赖清单,加载BOM后所有langchain4j版本号可以被统一管理起来

https://docs.langchain4j.dev/get-started

-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-bom</artifactId>

<version>${langchain4j.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!--引入阿里云百炼平台依赖管理清单

https://docs.langchain4j.dev/integrations/language-models/dashscope

-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-bom</artifactId>

<version>${langchain4j-community.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

<version>${spring-boot.version}</version>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-deploy-plugin</artifactId>

<version>${maven-deploy-plugin.version}</version>

<configuration>

<skip>true</skip>

</configuration>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>${maven-compiler-plugin.version}</version>

<configuration>

<release>${java.version}</release>

<compilerArgs>

<compilerArg>-parameters</compilerArg>

</compilerArgs>

</configuration>

</plugin>

<plugin>

<groupId>org.codehaus.mojo</groupId>

<artifactId>flatten-maven-plugin</artifactId>

<version>${flatten-maven-plugin.version}</version>

<inherited>true</inherited>

<executions>

<execution>

<id>flatten</id>

<phase>process-resources</phase>

<goals>

<goal>flatten</goal>

</goals>

<configuration>

<updatePomFile>true</updatePomFile>

<flattenMode>ossrh</flattenMode>

<pomElements>

<distributionManagement>remove</distributionManagement>

<dependencyManagement>remove</dependencyManagement>

<repositories>remove</repositories>

<scm>keep</scm>

<url>keep</url>

<organization>resolve</organization>

</pomElements>

</configuration>

</execution>

<execution>

<id>flatten.clean</id>

<phase>clean</phase>

<goals>

<goal>clean</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

<repositories>

<repository>

<id>spring-milestones</id>

<name>Spring Milestones</name>

<url>https://repo.spring.io/milestone</url>

<snapshots>

<enabled>false</enabled>

</snapshots>

</repository>

<repository>

<id>spring-snapshots</id>

<name>Spring Snapshots</name>

<url>https://repo.spring.io/snapshot</url>

<releases>

<enabled>false</enabled>

</releases>

</repository>

<repository>

<id>aliyunmaven</id>

<name>aliyun</name>

<url>https://maven.aliyun.com/repository/public</url>

</repository>

</repositories>

<pluginRepositories>

<pluginRepository>

<id>public</id>

<name>aliyun nexus</name>

<url>https://maven.aliyun.com/repository/public</url>

<releases>

<enabled>true</enabled>

</releases>

<snapshots>

<enabled>false</enabled>

</snapshots>

</pluginRepository>

</pluginRepositories>

</project>

创建一个子maven项目:LangChain4j-helloWorld

改pom

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>com.lazy</groupId>

<artifactId>LangChain4j</artifactId>

<version>1.0-SNAPSHOT</version>

</parent>

<name>LangChain4j入门案例之HelloWorld</name>

<artifactId>LangChain4j-helloWorld</artifactId>

<packaging>jar</packaging>

<properties>

<maven.compiler.source>17</maven.compiler.source>

<maven.compiler.target>17</maven.compiler.target>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

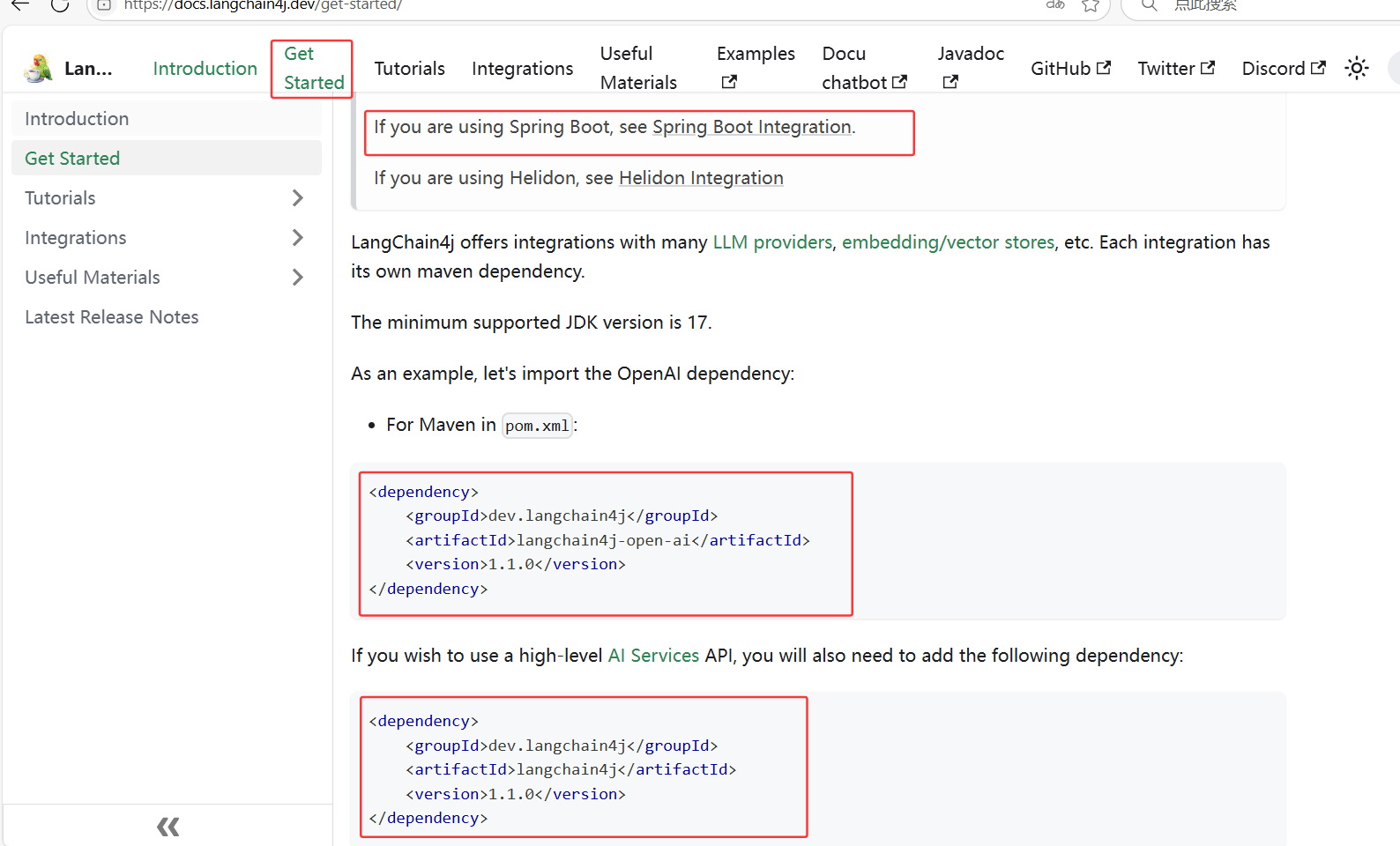

<!--langchain4j-open-ai 基础-->

<!--所有调用均基于 OpenAI 协议标准,实现一致的接口设计与规范LangChain4j 提供与许多 LLM 提供商的集成

从最简单的开始方式是从 OpenAI 集成开始https://docs.langchain4j.dev/get-started -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<!--langchain4j 高阶-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!--lombok-->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<!--test-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>

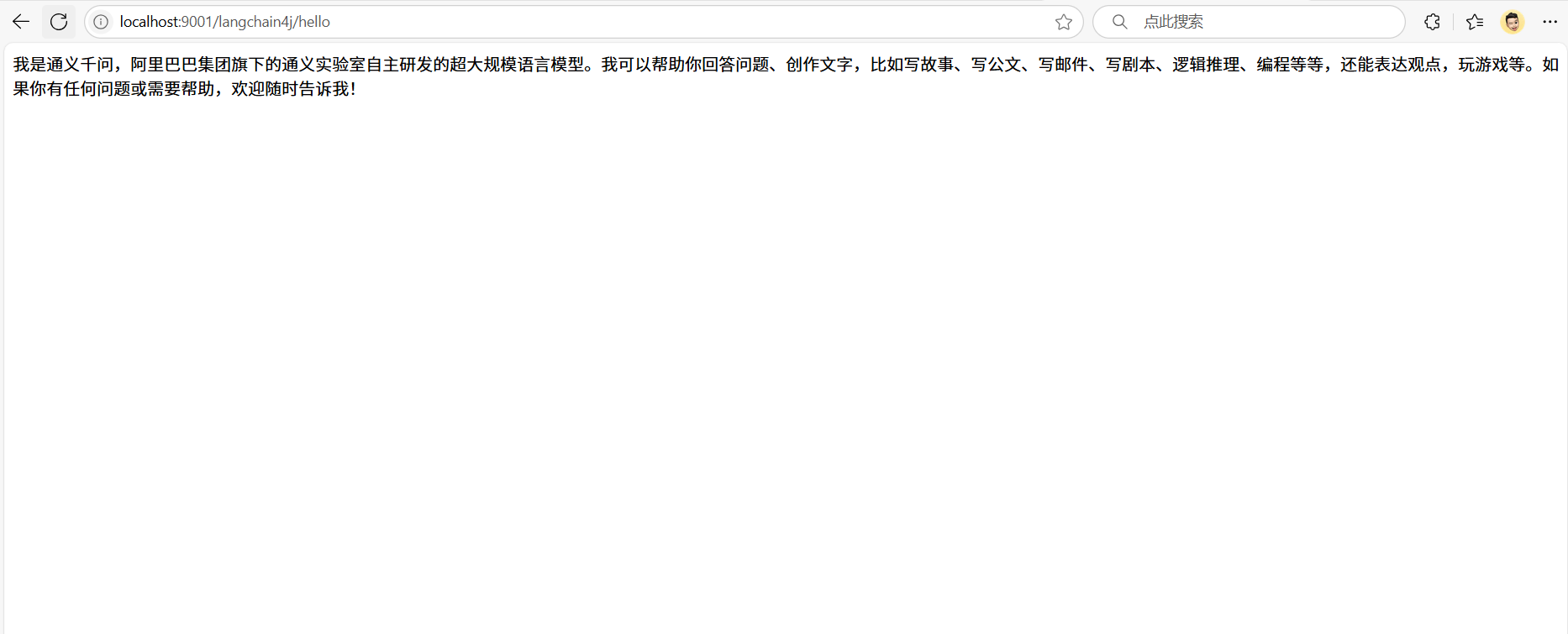

yaml

server:

port: 9001

spring:

application:

name: LangChain4j-helloWorld业务类

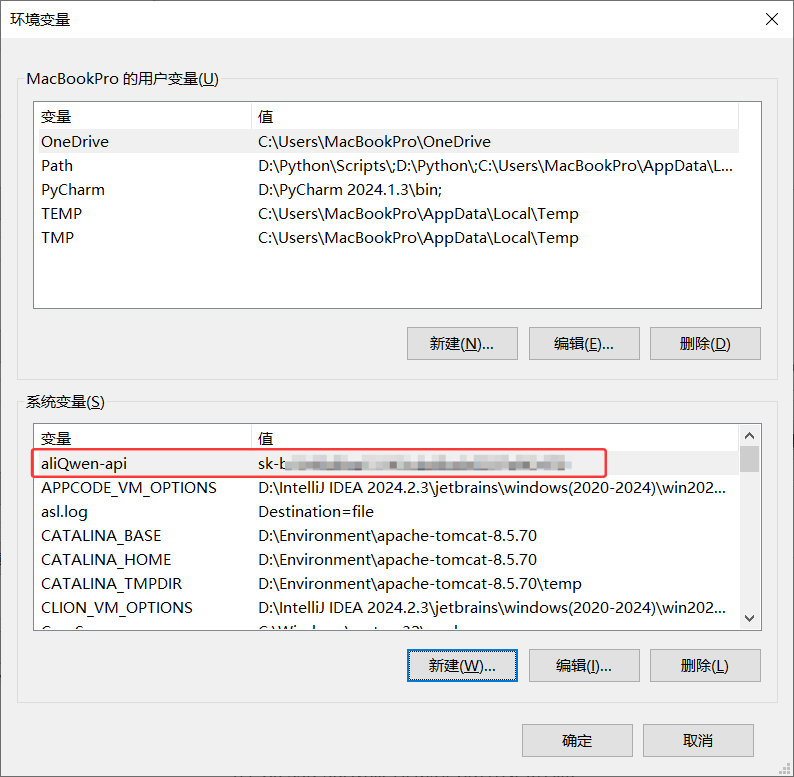

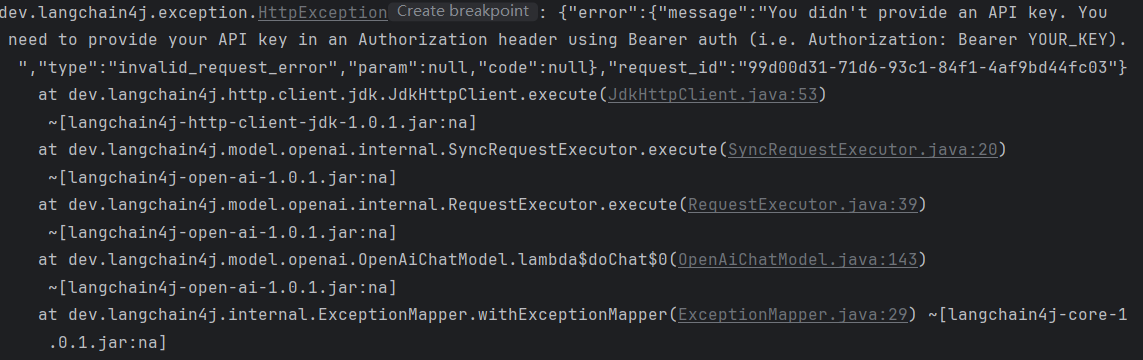

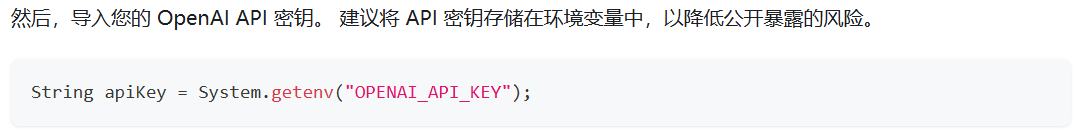

ApiKey不建议明文,需配置进环境变量

修改环境变量

以防不生效,建议重启IDEA

如果遇到这种情况,重启电脑试试

LLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.build();

}

}

HelloLangChainController

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class HelloLangChainController {

@Resource

private ChatModel chatModelQWen;

@GetMapping("/langchain4j/hello")

public String hello(@RequestParam(value = "question",defaultValue = "你是谁?") String question) {

String result = chatModelQWen.chat(question);

System.out.println("通过LangChain4j调用QWen返回结果:"+result);

return result;

}

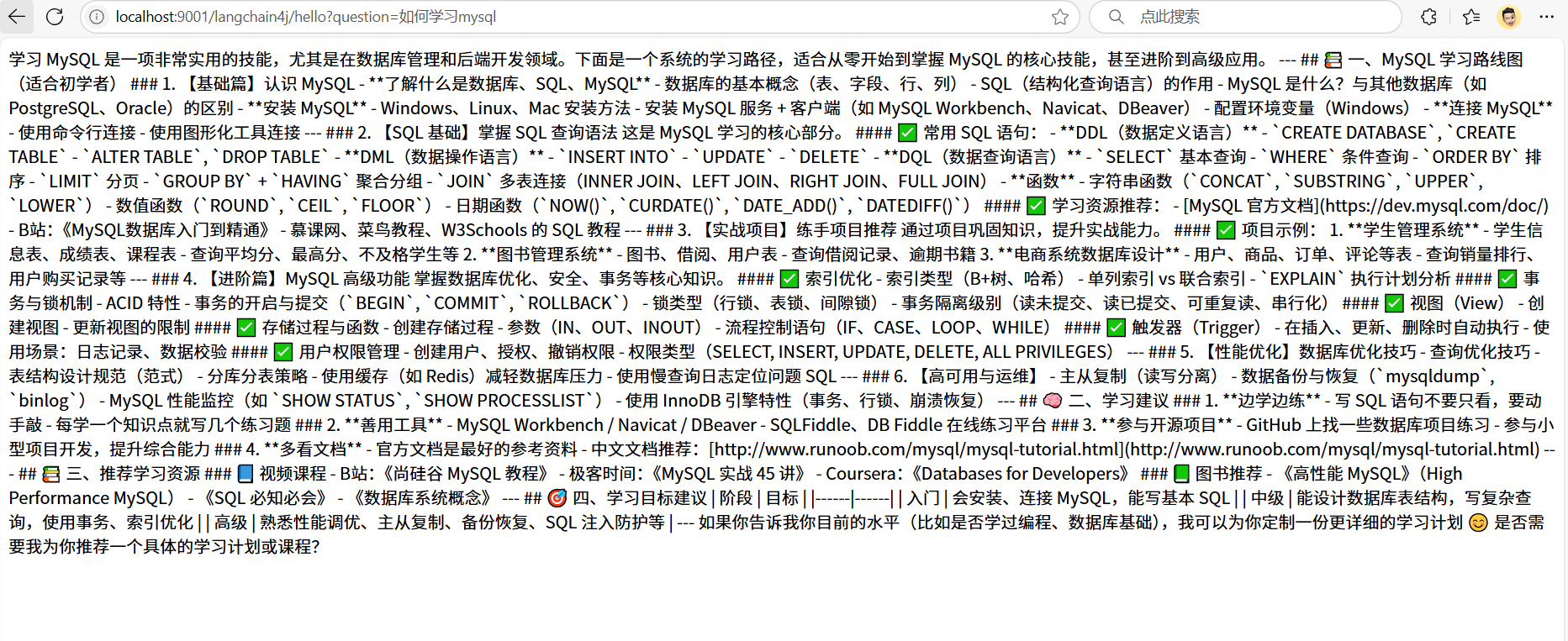

}测试

如何同时存在多种大模型在系统里共存使用?

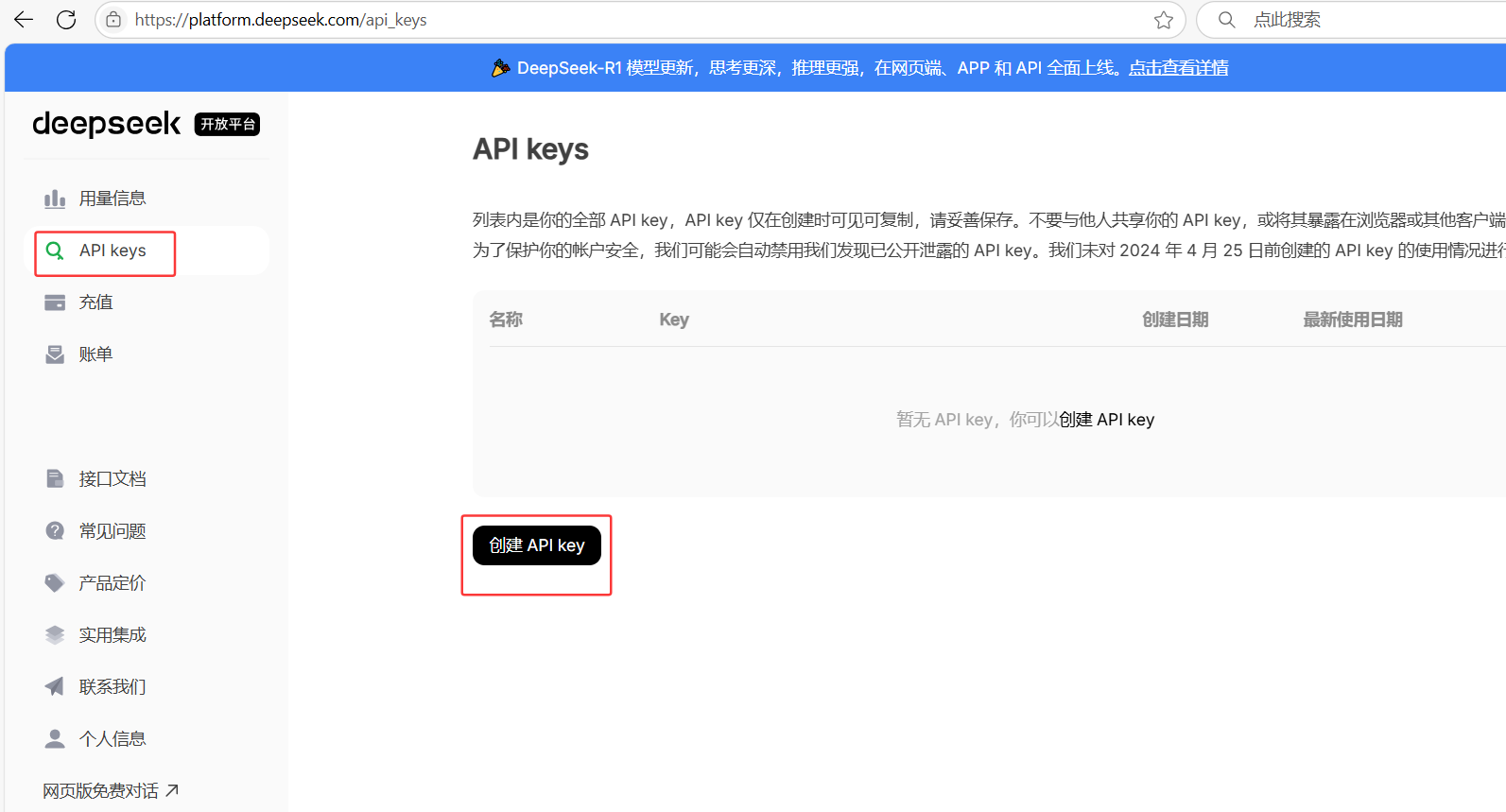

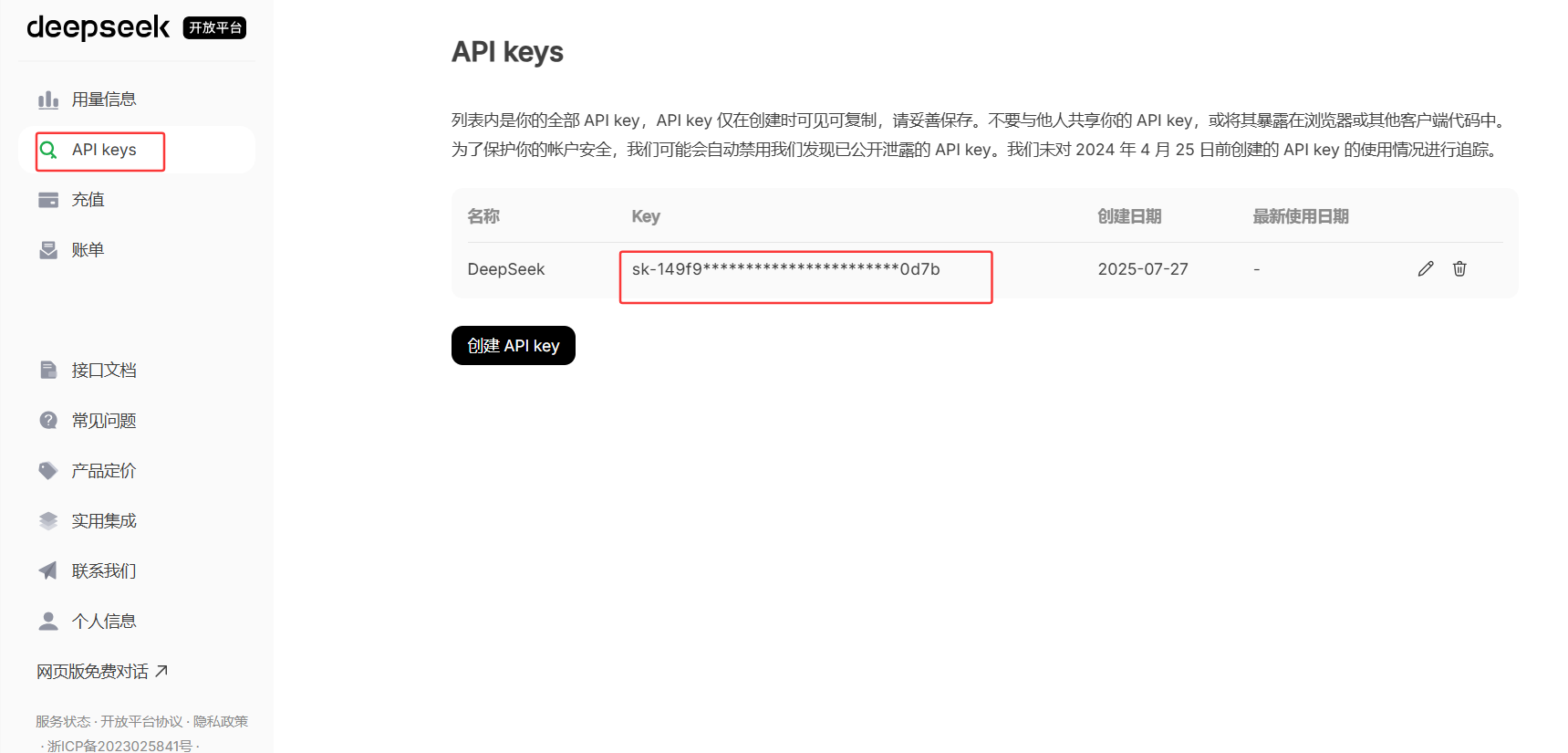

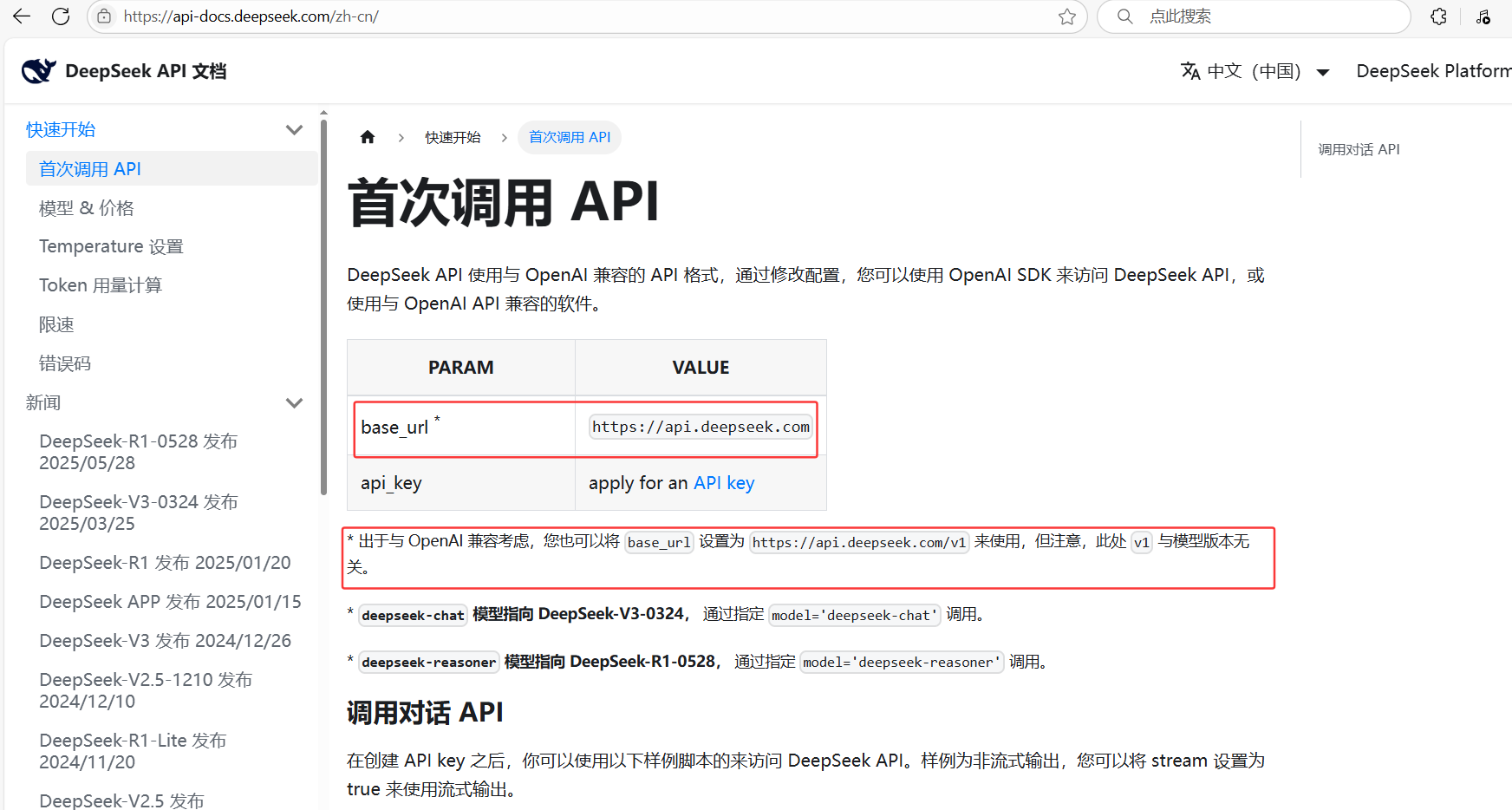

DeepSeek API 文档

https://platform.deepseek.com/usage

API 文档:https://api-docs.deepseek.com/zh-cn/

如果没有申请 API-key 先申请 api-key

申请地址

https://platform.deepseek.com/usage

如果申请成功了,跟上述那个一样把api-key配置到环境变量里面

大模型调用三件套

获得 Api-key

获得模型名

获得 baseUrl 开发地址

备注:

通过指定

model='deepseek-chat'即可调用 DeepSeek-V3 (普通) 通过指定

model='deepseek-reasoner'即可调用 DeepSeek-R1(深度)。

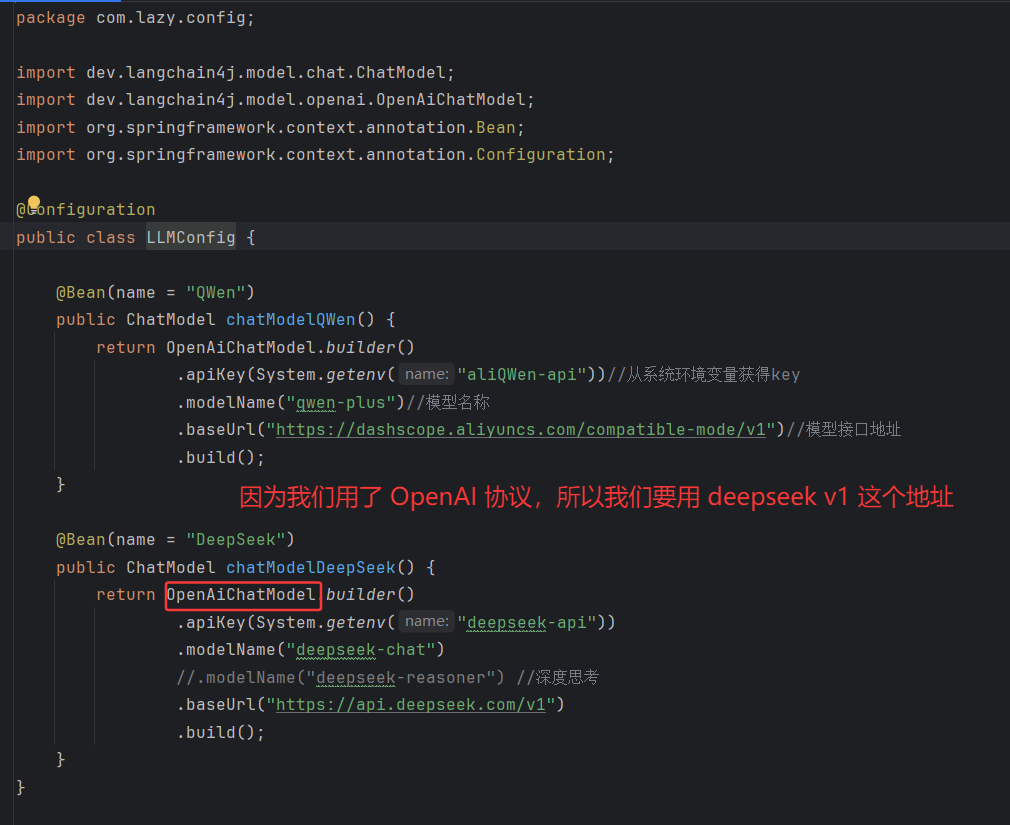

多模型共存使用

新建module

LangChain4j-02multi-model-together

pom

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!--langchain4j-open-ai 基础-->

<!--所有调用均基于 OpenAI 协议标准,实现一致的接口设计与规范LangChain4j 提供与许多 LLM 提供商的集成

从最简单的开始方式是从 OpenAI 集成开始https://docs.langchain4j.dev/get-started -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<!--langchain4j 高阶-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!--lombok-->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<!--test-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>yaml

server:

port: 9002

spring:

application:

name: LangChain4j-02multi-model-together业务类

LLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean(name = "QWen")

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.build();

}

@Bean(name = "DeepSeek")

public ChatModel chatModelDeepSeek() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("deepseek-api"))

.modelName("deepseek-chat")

//.modelName("deepseek-reasoner") //深度思考

.baseUrl("https://api.deepseek.com/v1")

.build();

}

}

MultiModelController

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class MultiModelController {

@Resource(name = "QWen")

private ChatModel chatModelQWen;

@Resource(name = "DeepSeek")

private ChatModel chatModelDeepSeek;

@GetMapping("/multimodel/qwen")

public String QWen(@RequestParam(name = "prompt",defaultValue = "你是谁") String prompt) {

String chatQWen = chatModelQWen.chat(prompt);

System.out.println("模型返回结果:\t"+chatQWen);

return chatQWen;

}

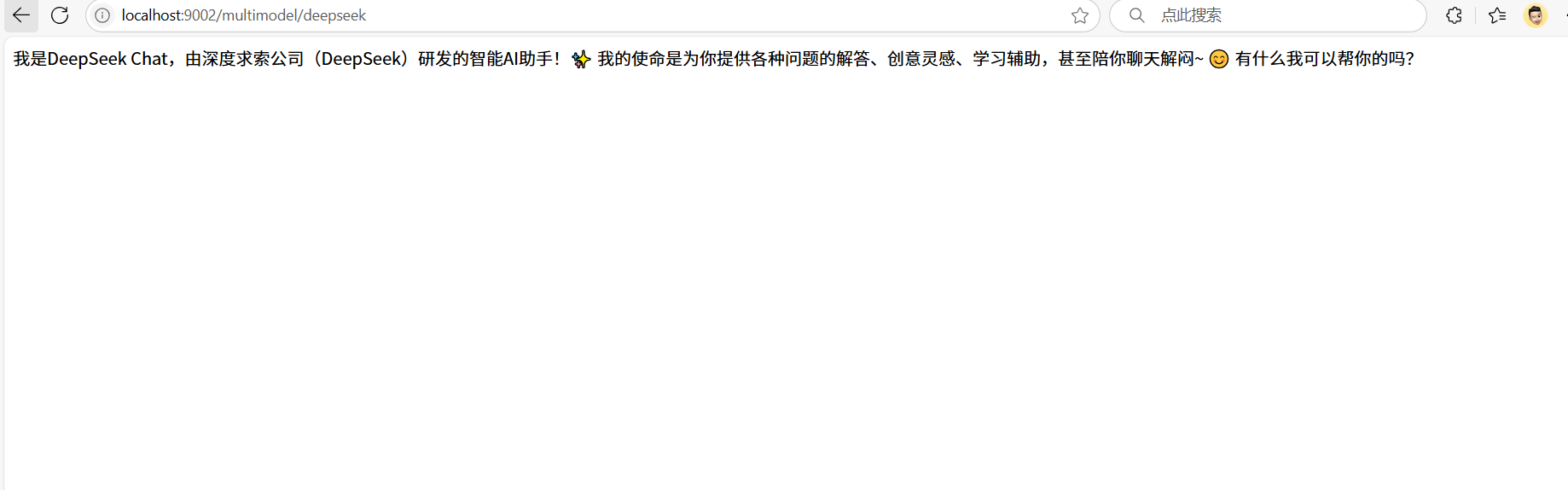

@GetMapping("/multimodel/deepseek")

public String DeepSeek(@RequestParam(name = "prompt",defaultValue = "你是谁") String prompt) {

String chatDeepSeek = chatModelDeepSeek.chat(prompt);

System.out.println("模型返回结果:\t"+chatDeepSeek);

return chatDeepSeek;

}

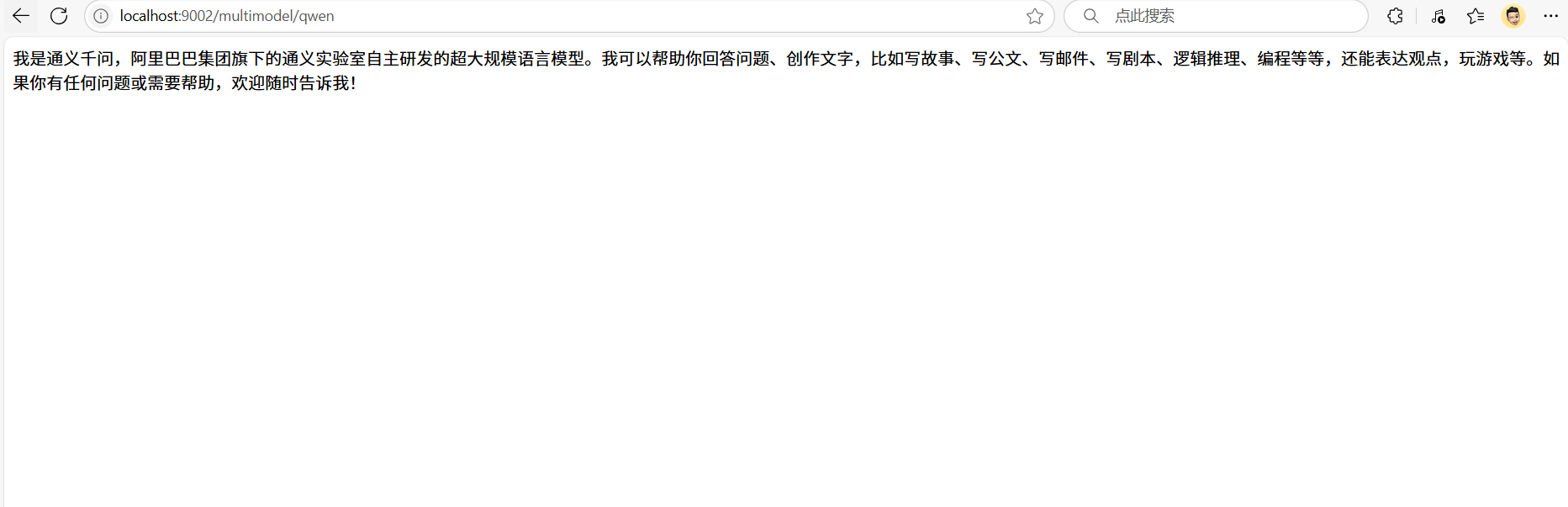

}启动项目,测试!

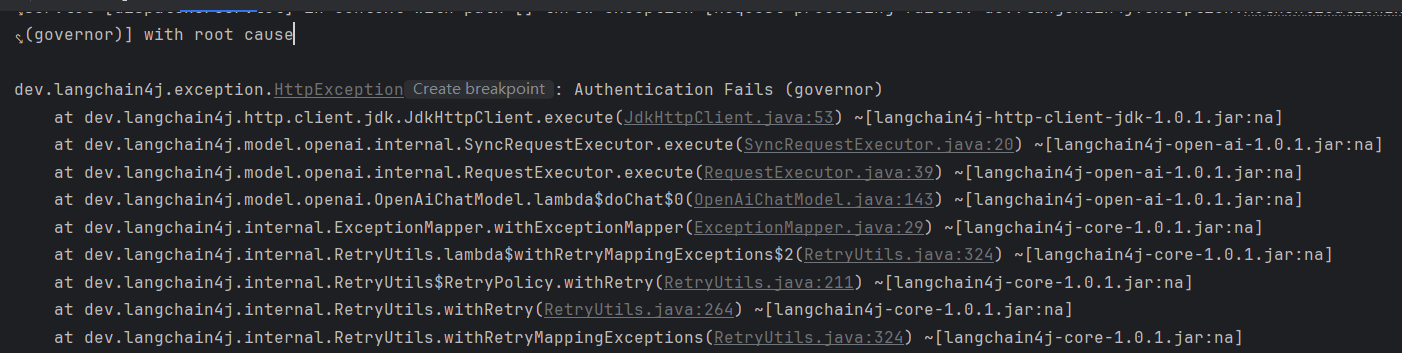

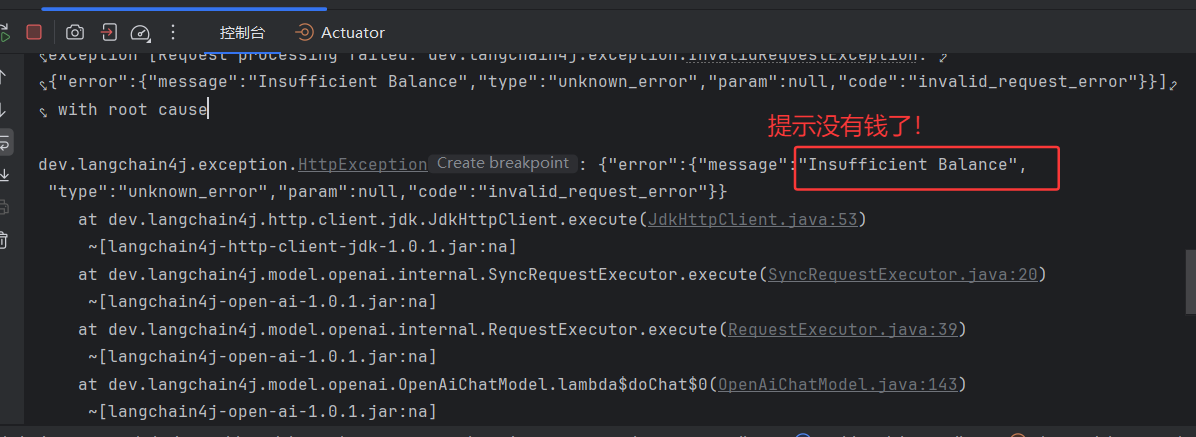

访问deepseek报错了,重启试试

我们充点钱再试试!

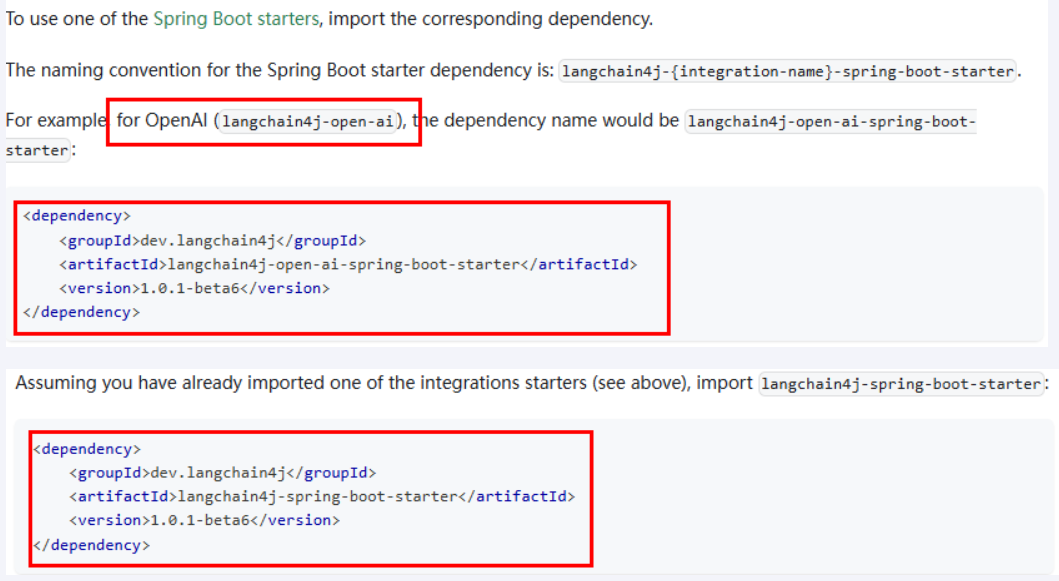

原生整合和SpringBoot整合

官网

- 中文:

https://docs.langchain4j.info/tutorials/spring-boot-integration - 英文:

https://docs.langchain4j.dev/tutorials/spring-boot-integration

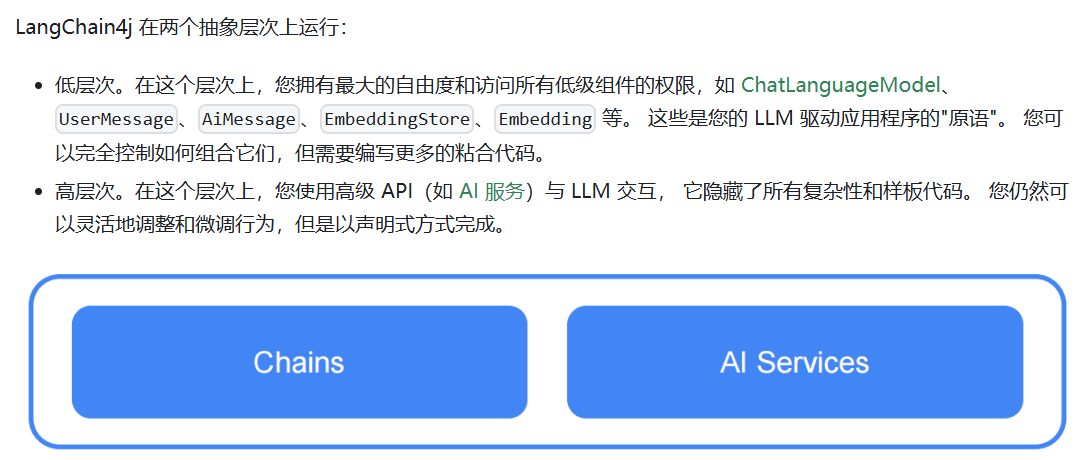

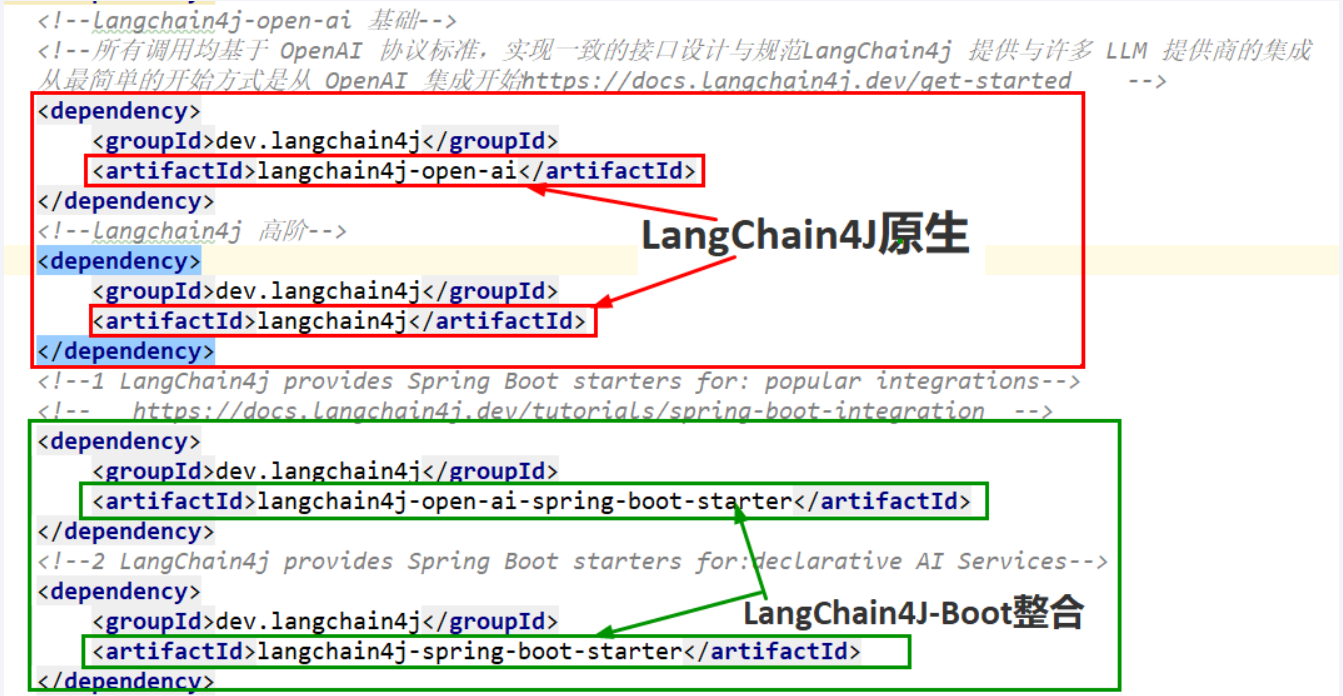

低阶 api VS 高阶 api

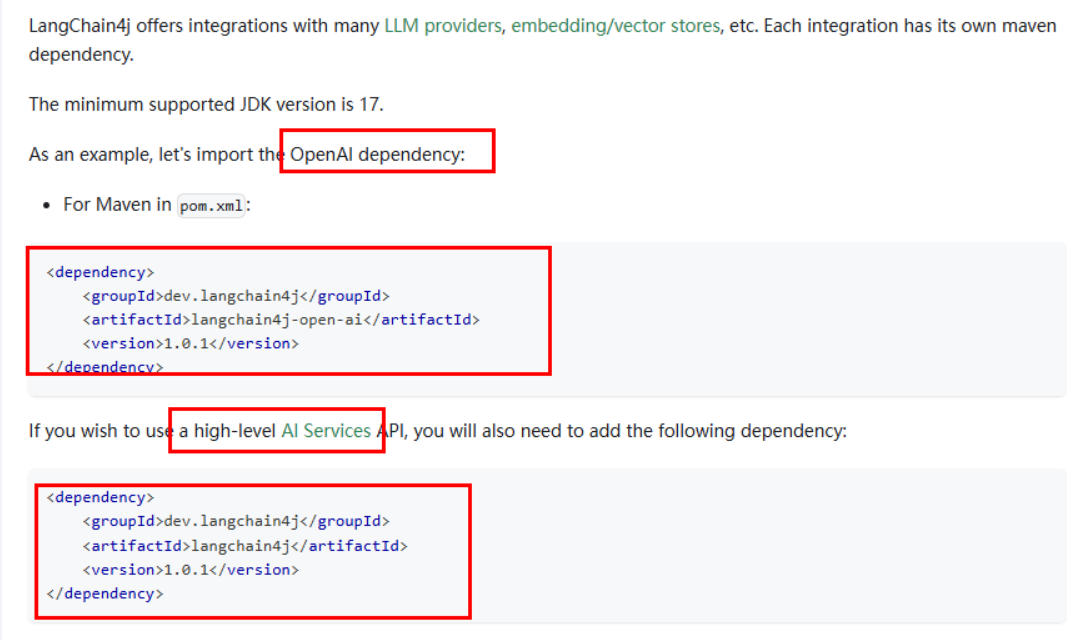

SpringBoot 整合低阶 api 所需要的

pomxml<dependency> <groupId>dev.langchain4j</groupId> <artifactId>langchain4j-open-ai-spring-boot-starter</artifactId> <version>1.0.0-beta3</version> </dependency>

SpringBoot 整合高阶 api 所需要的

pom

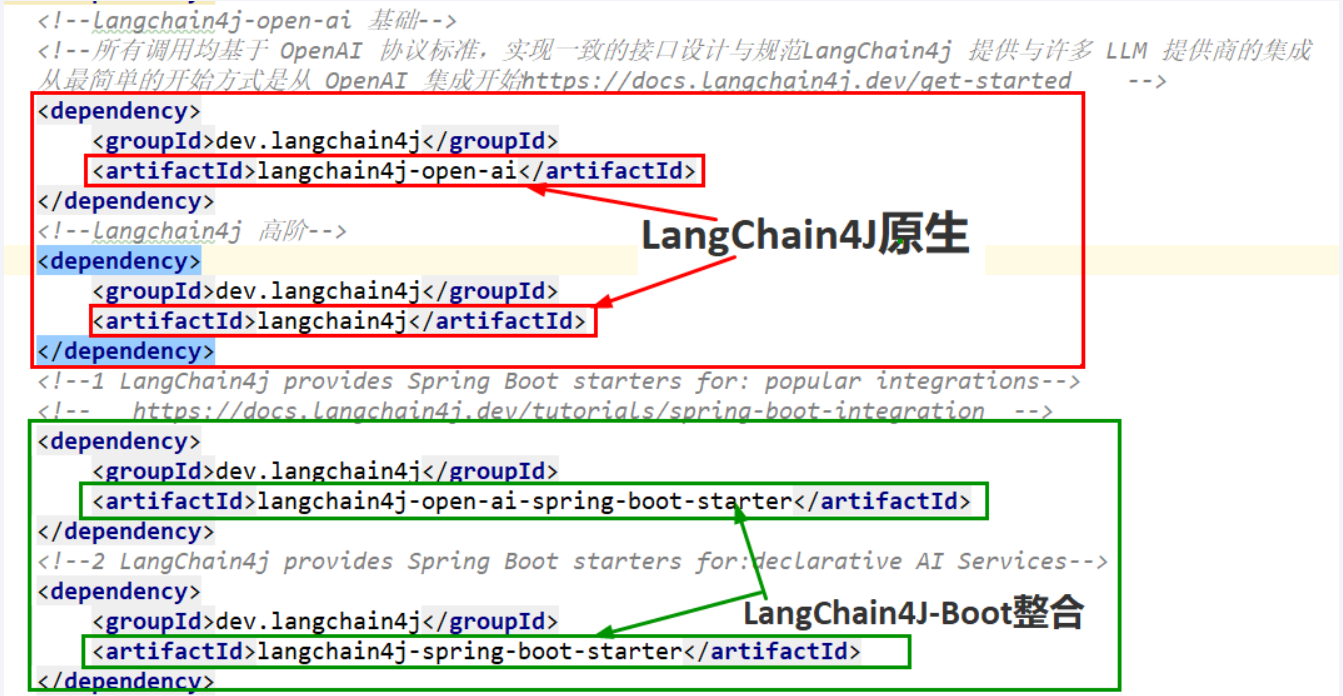

总结

LangChain4j 原生 VS LangChain4j-Boot整合

LangChain4j 原生整合

LangChain4j-Boot整合

总结

LangChain4j 原生集成与使用 LangChain4j-Boot(Spring Boot Starter)进行整合的主要区别在于 易用性、配置管理、自动装配和与 Spring 生态的集成深度。以下是详细对比:

- 依赖管理

原生 LangChain4j:

需手动添加核心库及模型提供者(如 OpenAI、HuggingFace)的依赖。

示例 Maven 依赖:

xml<dependency> <groupId>dev.langchain4j</groupId> <artifactId>langchain4j-core</artifactId> <version>0.31.0</version> </dependency> <dependency> <groupId>dev.langchain4j</groupId> <artifactId>langchain4j-open-ai</artifactId> <version>0.31.0</version> </dependency>

LangChain4j-Boot:

通过单一 Starter 依赖自动引入核心库和常用模块。

示例:

xml<dependency> <groupId>io.github.microutils</groupId> <artifactId>langchain4j-boot-spring-boot-starter</artifactId> <version>0.1.0</version> <!-- 版本可能变化 --> </dependency>

- 配置方式

原生 LangChain4j:

手动编码创建组件(如

OpenAiChatModel),需硬编码 API Key 或自行管理配置。javaOpenAiChatModel model = OpenAiChatModel.builder() .apiKey("sk-...") .modelName("gpt-4") .build();

LangChain4j-Boot:

通过

application.yml/application.properties集中配置,支持多模型切换。yamllangchain4j: openai: api-key: ${OPENAI_API_KEY} model: gpt-4-turbo huggingface: api-key: ${HF_API_KEY}自动注入 Bean,无需手动构建:

java@Autowired private ChatModel chatModel; // 根据配置自动选择 OpenAI/HuggingFace

- 自动装配与扩展

原生 LangChain4j:

- 需自行管理组件生命周期(如注入

ChatMemory、Tool)。- 需手动集成 Spring(如通过

@Bean工厂方法)。

- 需手动集成 Spring(如通过

- 需自行管理组件生命周期(如注入

LangChain4j-Boot:

自动装配:根据配置创建

ChatModel、EmbeddingModel等 Bean。工具集成:自动扫描

@Tool注解的 Bean 并注入AiServices。java@Service @Tool("查询用户信息") public class UserService { public String getUserEmail(String username) { ... } }- 对话内存:自动配置

ChatMemory(如InMemoryChatMemory)并关联会话。

- 对话内存:自动配置

- Spring 生态集成

原生 LangChain4j:

- 与 Spring 无深度整合,需自行实现:

- 配置绑定(如

@ConfigurationProperties)。 - 异常处理、健康检查。

- 配置绑定(如

- 与 Spring 无深度整合,需自行实现:

LangChain4j-Boot:

配置绑定:通过

@ConfigurationProperties映射配置项。健康检查:提供

/health端点验证模型连接状态。AOP 支持:通过注解管理对话上下文(如

@MemoryId标识用户会话):java@Service public class ChatService { @Autowired private Assistant assistant; public String chat(String userId, String message) { return assistant.chat(userId, message); // 自动关联 userId 的对话历史 } }

- 生产就绪特性

- LangChain4j-Boot 额外提供:

- 监控指标:集成 Micrometer 统计 Token 使用量、延迟等。

- 异常处理:统一处理模型调用异常(如

ModelNotFoundException)。 - 多模型切换:通过配置动态切换模型(如测试用 OpenAI,生产用 Azure OpenAI)。

- 代码简洁性对比

原生实现示例(手动管理依赖和配置):

java@Bean public ChatModel openAiChatModel() { return OpenAiChatModel.builder() .apiKey(env.getProperty("openai.api-key")) .modelName("gpt-4") .build(); }- LangChain4j-Boot 实现(零配置):

java@Service public class MyAssistant { @Autowired private ChatModel chatModel; // 自动注入 public String answer(String question) { return chatModel.generate(question); } }

总结:如何选择?

| 场景 | 推荐方式 |

|---|---|

| 快速原型验证、小型项目 | 原生 LangChain4j |

| Spring Boot 项目,需生产部署 | LangChain4j-Boot |

| 需要动态配置/多模型支持 | LangChain4j-Boot |

| 深度集成 Spring 生态(AOP、监控) | LangChain4j-Boot |

LangChain4j-Boot 的本质:通过 Spring Boot Starter 机制封装原生 LangChain4j,提供自动配置、依赖管理、生态集成,显著提升开发效率,降低样板代码量。

案例

建module:LangChain4j-03boot-integration

pom

<properties>

<maven.compiler.source>17</maven.compiler.source>

<maven.compiler.target>17</maven.compiler.target>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!--langchain4j原生 基础-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<!--langchain4j原生 高阶-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!--1 LangChain4j 整合boot底层支持-->

<!-- https://docs.langchain4j.dev/tutorials/spring-boot-integration -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai-spring-boot-starter</artifactId>

</dependency>

<!--2 LangChain4j 整合boot高阶支持-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-spring-boot-starter</artifactId>

</dependency>

<!--lombok-->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<!--test-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

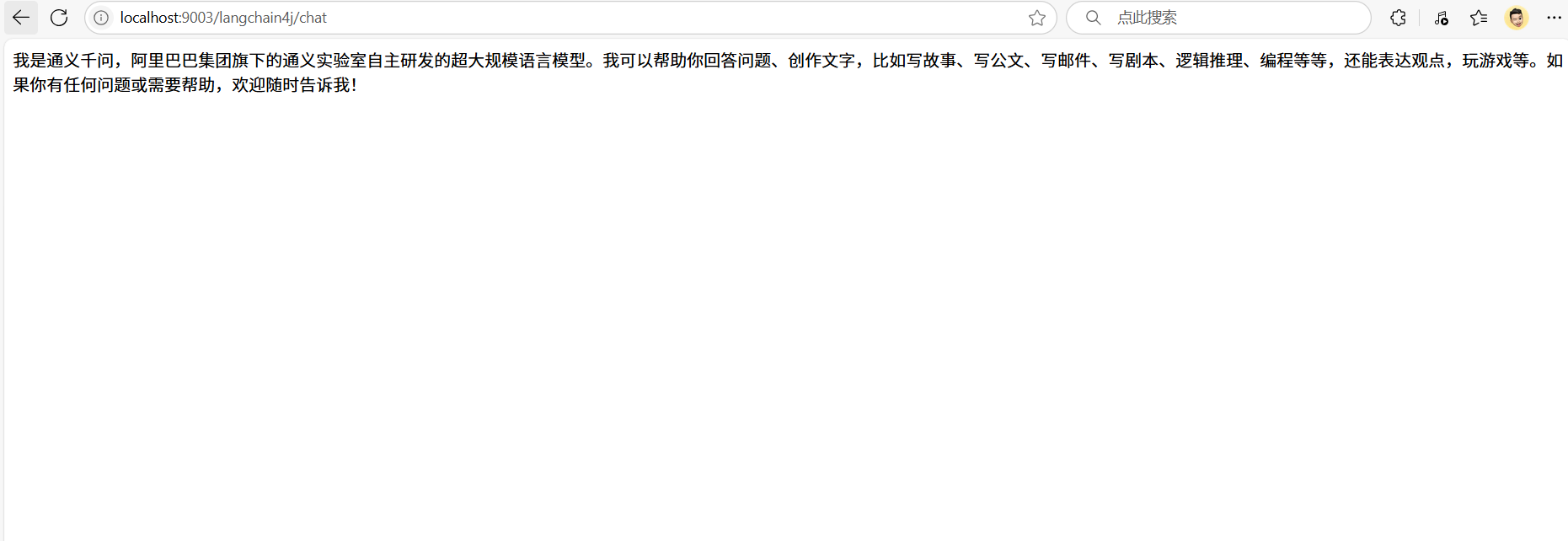

</build>低阶api

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class PopularIntegrationController {

@Resource

private ChatModel chatModelQWen;

@GetMapping("/langchain4j/chat")

public String chatQWen(@RequestParam(value = "prompt",defaultValue = "你是谁") String prompt) {

return chatModelQWen.chat(prompt);

}

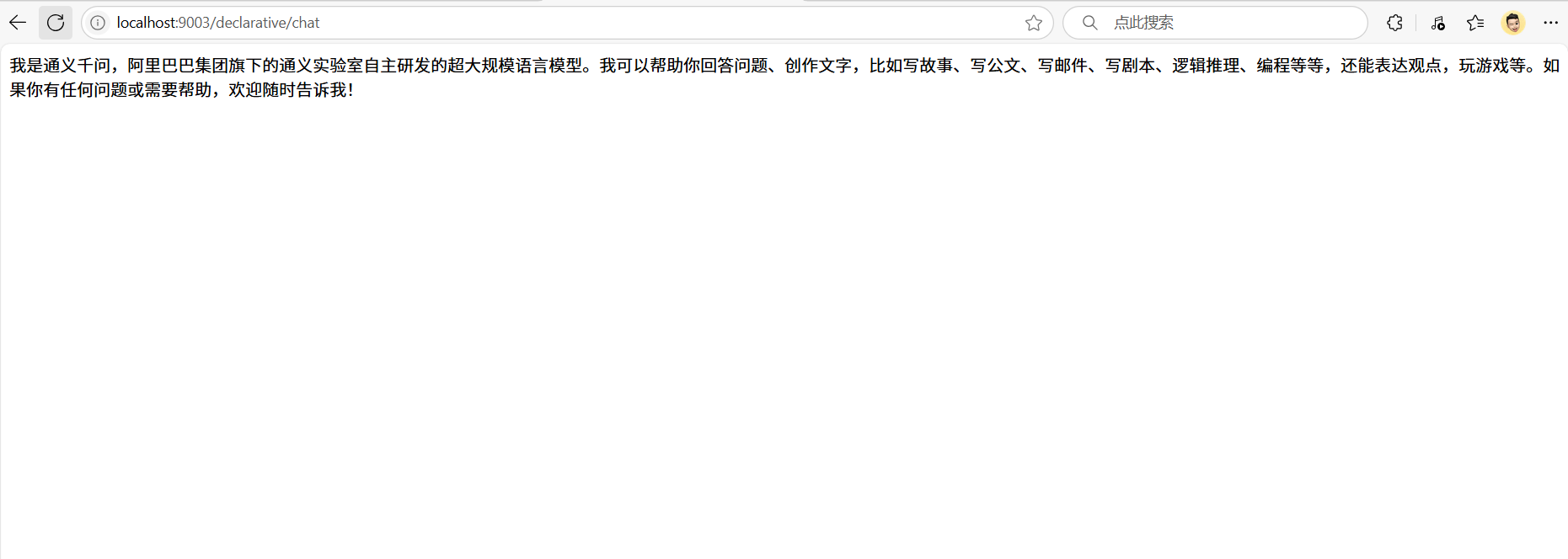

}测试

高阶api

ChatAssistantService

package com.lazy.service;

import dev.langchain4j.service.spring.AiService;

@AiService

public interface ChatAssistantService {

String chat(String prompt);

}DeclarativeAIController

package com.lazy.controller;

import com.lazy.service.ChatAssistantService;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class DeclarativeAIController {

@Resource

private ChatAssistantService chatAssistantService;

@GetMapping("/declarative/chat")

public String declarativeChat(@RequestParam(value = "prompt",defaultValue = "你是谁") String prompt) {

return chatAssistantService.chat(prompt);

}

}测试

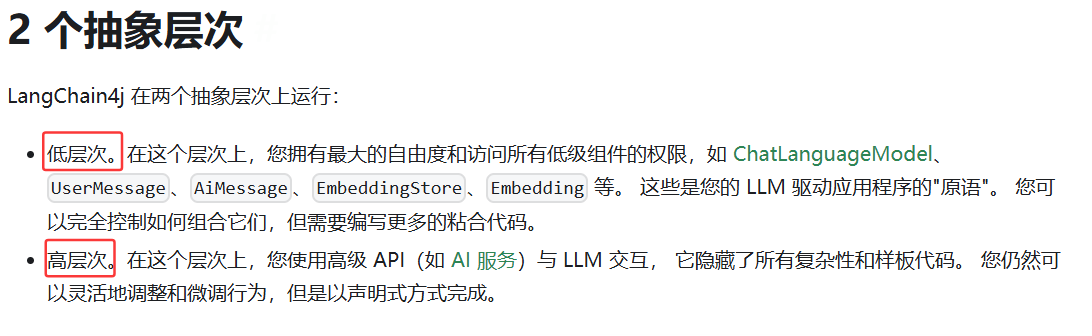

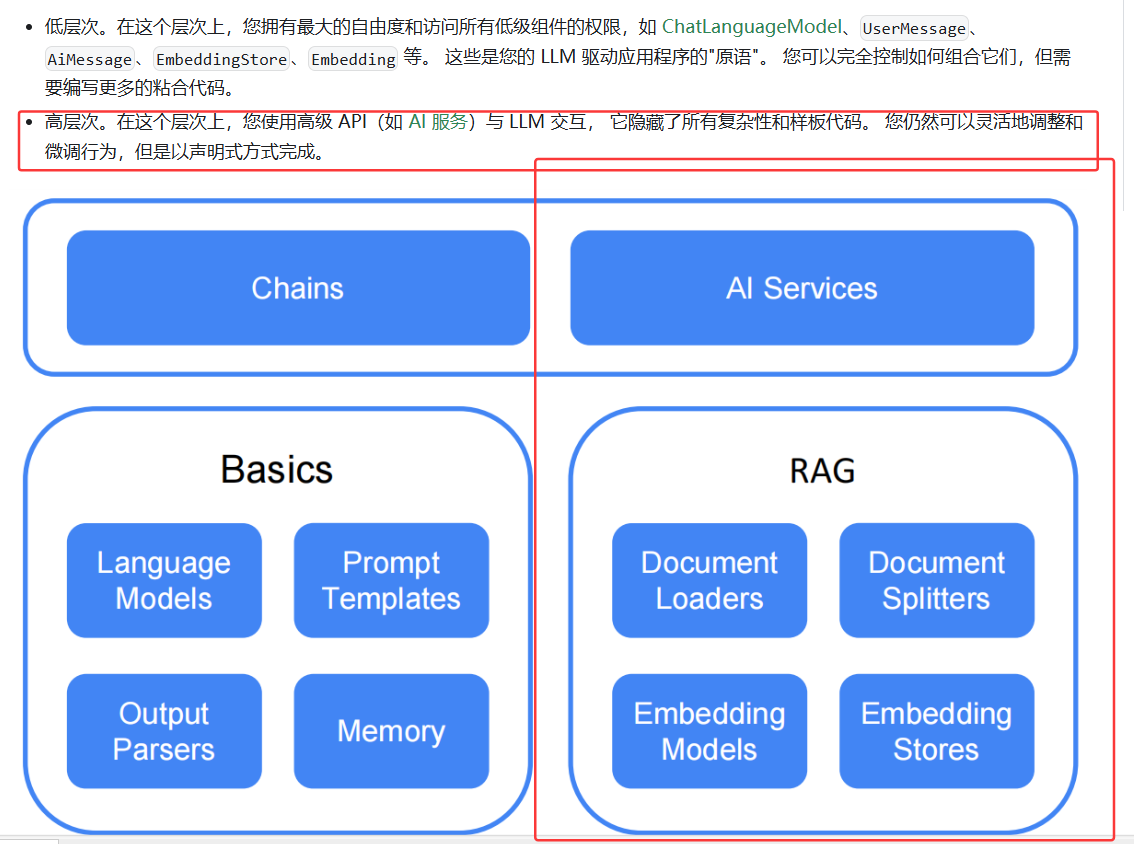

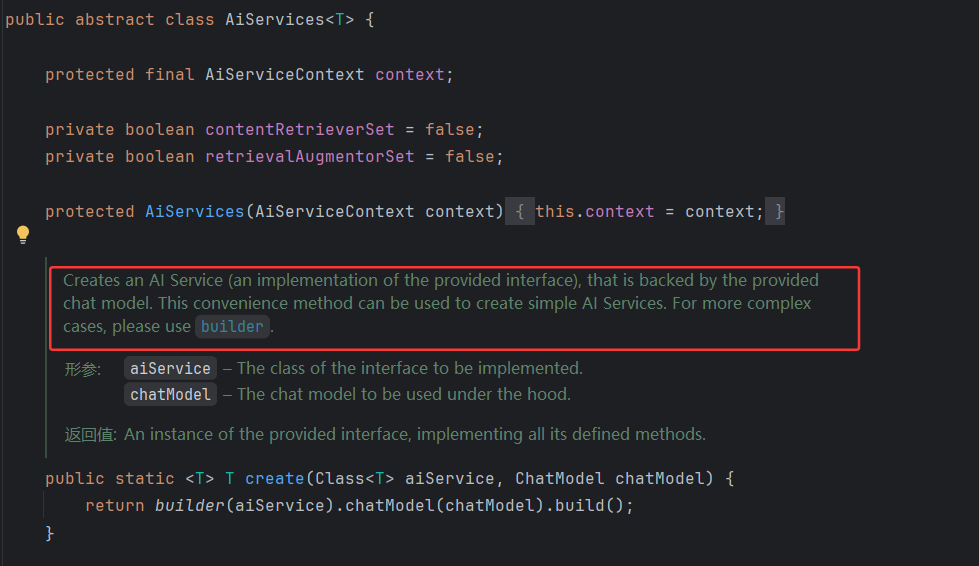

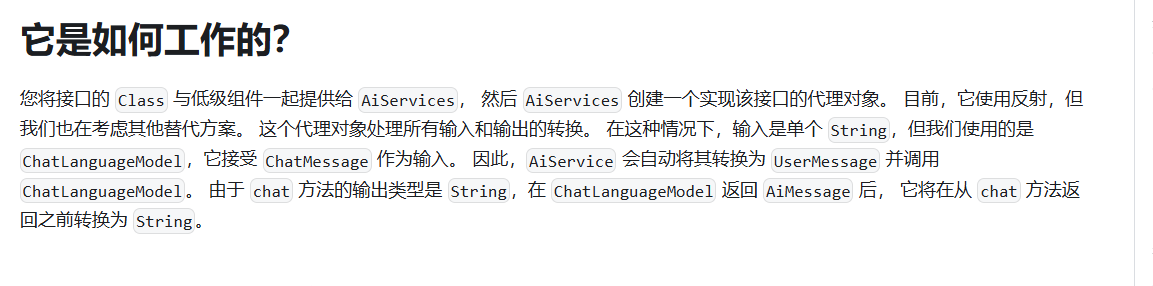

高阶api集成官网解释

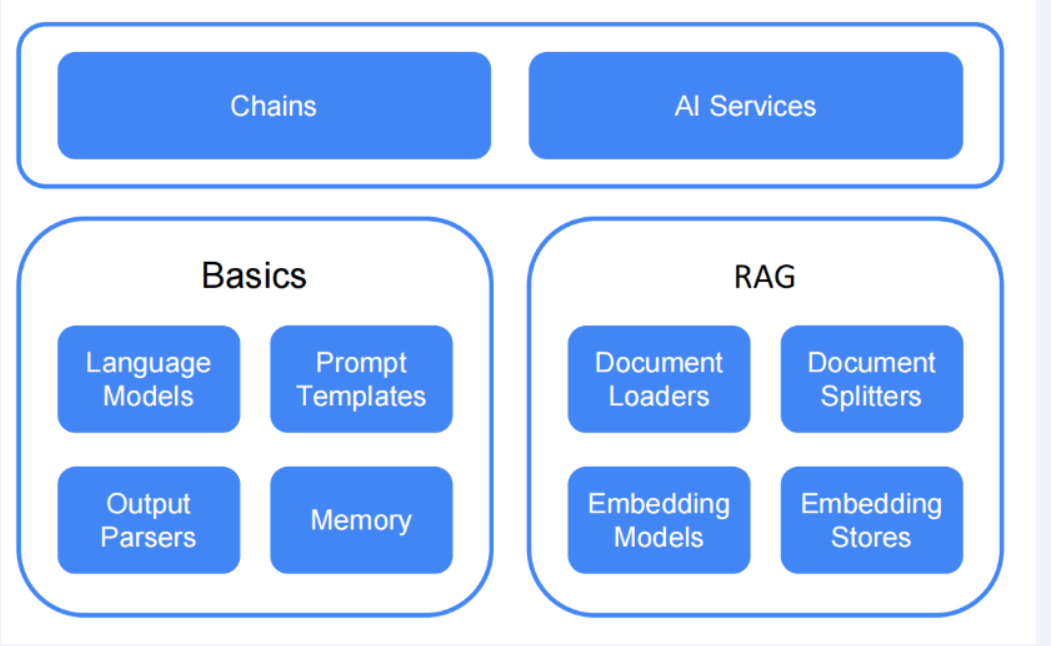

低阶和高阶API

LangChain4j在两个抽象层提供不同的api

低阶api

如 ChatLanguageModel、UserMessage、AiMessage、EmbeddingStore、Embedding 等

优点:是可以自由组合适宜于各个组件但编码量高

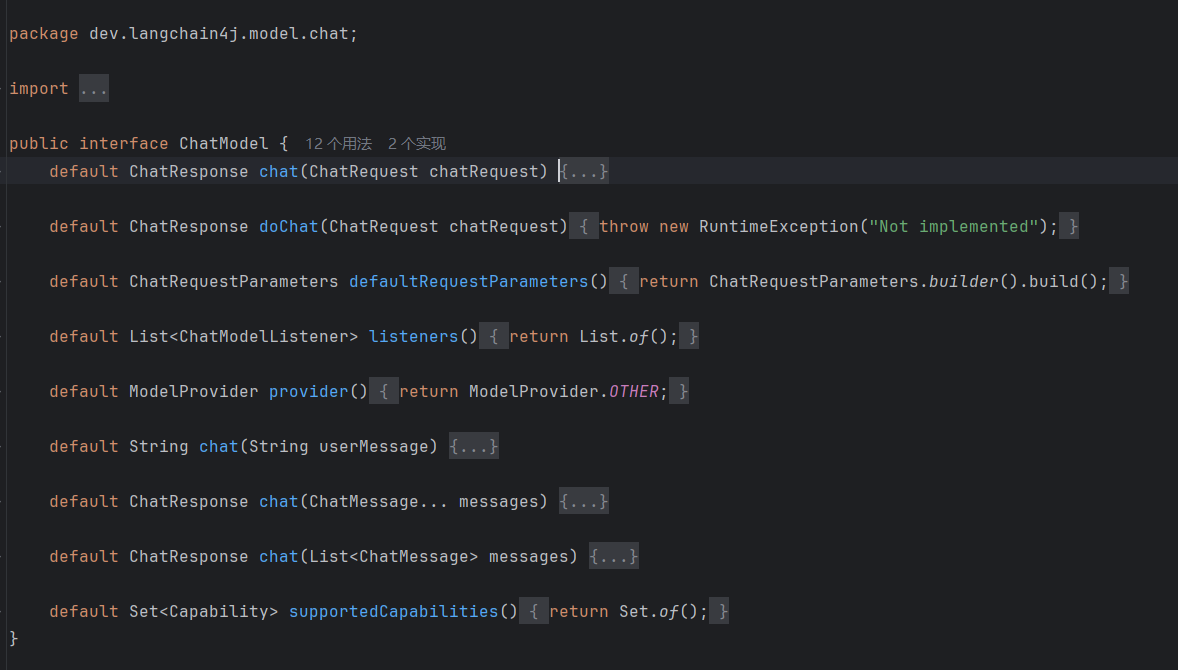

ChatModel

low-level(低阶api)模型api,提供各种chat方法用于对话,可以接受单个或多个消息

ChatModel 提供的一种极其简便的方法

javadefault String chat(String userMessage) { ChatRequest chatRequest = ChatRequest.builder() .messages(UserMessage.from(userMessage)) .build(); ChatResponse chatResponse = chat(chatRequest); return chatResponse.aiMessage().text(); }java@GetMapping(value = "/langchain4j/hello") public String hello(@RequestParam(value = "prompt", defaultValue = "你是谁") String prompt) { String result = chatModel.chat(prompt); System.out.println("通过langchain4j调用模型返回结果:\n"+result); return result; }

高阶api

- AiServices、Tools等

- 程序员自己定义接口,通过AiServices 类里面的方法实现,优点是api封装度比较高,减少了代码的复杂性,但仍可以进行灵活的微调

创建由提供的聊天模型支持的 AI 服务(所提供接口的实现)。这种方便的方法可用于创建简单的 AI 服务。对于更复杂的情况,请使用 builder。

LangChian4j提供大模型接口、提示词模板、结构化输出、对话记忆、文档加载、文档分割、向量模型、向量存储等组件

代码案例

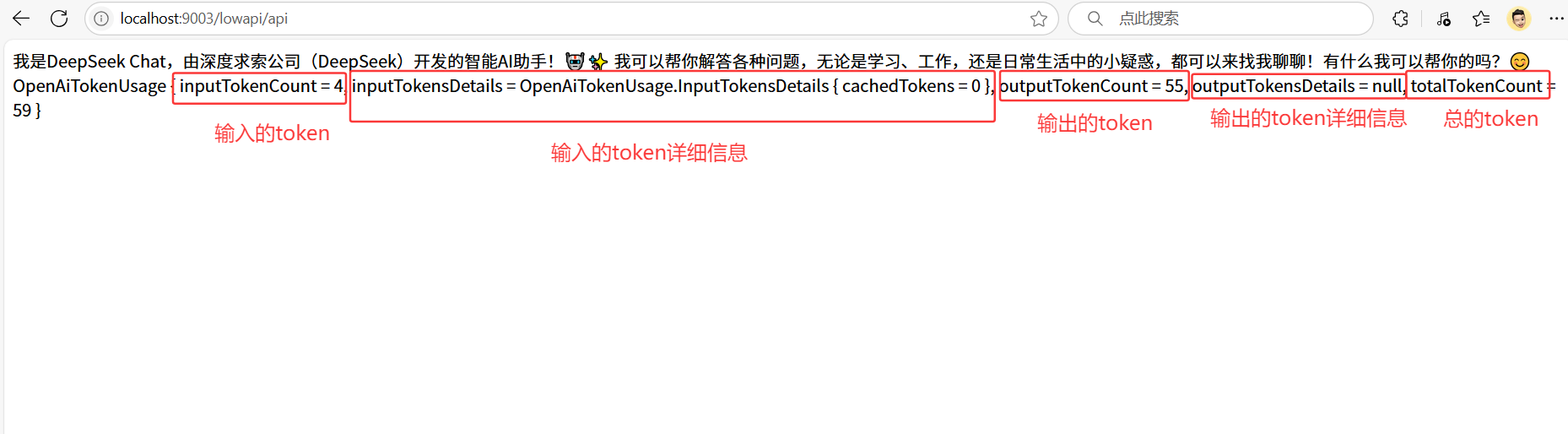

低阶api(token使用情况)

大模型中的 Token VS Web开发中的Token

大模型中的token

Web开发中的token

在web开发中,“token”通常指的是用于认证和授权的一种加密字符串。它被用来确保用户身份的安全验证,比如JWT(JSON Web Token)。这类token一般由服务器生成,并发给客户端保存(例如存储在浏览器的本地存储或cookie中),之后每次请求都需要携带这个token来证明用户的身份。

区别

- 目的不同:大模型中的token是为了将文本分割成可处理的单元,便于进行计算;而web开发中的token主要用于安全地传递用户身份信息

- 生成方式不同:前者通过特定的算法(如BPE)对文本进行分割得到;后者则通常是通过加密算法生成的唯一字符串。

- 应用场景不同:前者应用于文本分析、机器翻译等NLP任务;后者多见于用户登录系统、API访问控制等领域。

新建module:LangChain4j-04low-high-api

pom

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

</dependencies>LLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean(name = "QWen")

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.build();

}

@Bean(name = "DeepSeek")

public ChatModel chatModelDeepSeek() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("deepseek-api"))

.modelName("deepseek-chat")

//.modelName("deepseek-reasoner") //深度思考

.baseUrl("https://api.deepseek.com/v1")

.build();

}

}LowApiController

package com.lazy.controller;

import dev.langchain4j.data.message.UserMessage;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.response.ChatResponse;

import dev.langchain4j.model.output.TokenUsage;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class LowApiController {

@Resource(name = "DeepSeek")

private ChatModel chatModelQWen;

@GetMapping("/lowapi/api")

public String api(@RequestParam(name = "prompt", defaultValue = "你是谁") String prompt) {

ChatResponse chatResponse = chatModelQWen.chat(UserMessage.userMessage(prompt));//使用带返回结果的api

String text = chatResponse.aiMessage().text();

System.out.println("大模型调用返回结果:" + text);

TokenUsage token = chatResponse.tokenUsage();

System.out.println("本次调用结果消耗的token:" + token);

return text + "\t\n" + token;

}

}测试

高阶api

AI Service 是如何工作的?

配置

定义 AI Service 接口

javapackage com.lazy.service; public interface ChatAssistant { String chat(String prompt); }LLMConfig 类配置调用三件套

javapackage com.lazy.config; import dev.langchain4j.model.chat.ChatModel; import dev.langchain4j.model.openai.OpenAiChatModel; import org.springframework.context.annotation.Bean; import org.springframework.context.annotation.Configuration; @Configuration public class LLMConfig { @Bean public ChatModel chatModelQwen() { return OpenAiChatModel.builder() .apiKey(System.getenv("aliQWen-api")) .modelName("qwen-plus") .baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1") .build(); } }AI Service 对应接口实现类落地

javapackage com.lazy.config; import com.atguigu.study.service.ChatAssistant; import dev.langchain4j.model.chat.ChatModel; import dev.langchain4j.model.openai.OpenAiChatModel; import dev.langchain4j.service.AiServices; import org.springframework.beans.factory.annotation.Qualifier; import org.springframework.context.annotation.Bean; import org.springframework.context.annotation.Configuration; /** * @auther zzyybs@126.com * @Date 2025-05-27 22:04 * @Description: 知识出处 https://docs.langchain4j.dev/get-started */ @Configuration public class LLMConfig { @Bean(name = "qwen") public ChatModel chatModelQwen() { return OpenAiChatModel.builder() .apiKey(System.getenv("aliQWen-api")) .modelName("qwen-plus") .baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1") .build(); } public interface ChatAssistant{ String chat(String prompt); } @Bean public ChatAssistant chatAssistant(@Qualifier("qwen") ChatModel chatModelQwen) { return AiServices.create(ChatAssistant.class, chatModelQwen); } }

HighApiController

package com.lazy.controller;

import com.lazy.service.ChatAssistant;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class HighApiController {

@Resource

private ChatAssistant chatAssistant;

@GetMapping("/high/highapi")

public String highApi(@RequestParam(value = "prompt",defaultValue = "你是谁") String prompt) {

return chatAssistant.chat(prompt);

}

}测试

注意:

@AiService注解是与SpringBoot整合的包才能使用,当前我们没有引用于SpringBoot整合的包,使用的是langchain4j原生的包,所以不能使用@AiService注解

模型参数配置

官网:

- 中文:https://docs.langchain4j.info/tutorials/model-parameters

- 英文:https://docs.langchain4j.dev/tutorials/model-parameters

建module:LangChain4j-05model-parameters

pom

<properties>

<maven.compiler.target>17</maven.compiler.target>

<maven.compiler.source>17</maven.compiler.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- langchain4j 基础 -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<!-- langchain4j 高阶 -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!-- hutool-all -->

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

</dependencies>yaml

server:

port: 9003

spring:

application:

name: LangChain4j-05model-parametersLLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.build();

}

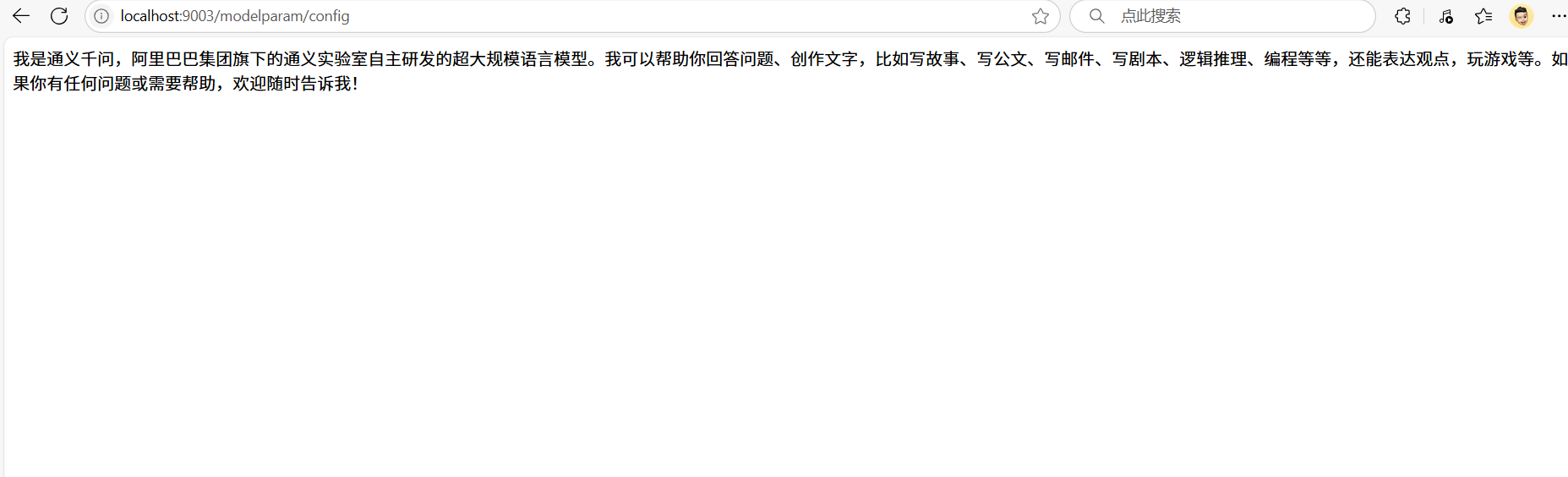

}Controller

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class ModelParameterController {

@Resource

private ChatModel chatModel;

@GetMapping("/modelparam/config")

public String config(@RequestParam(value = "prompt",defaultValue = "你是谁") String prompt) {

return chatModel.chat(prompt);

}

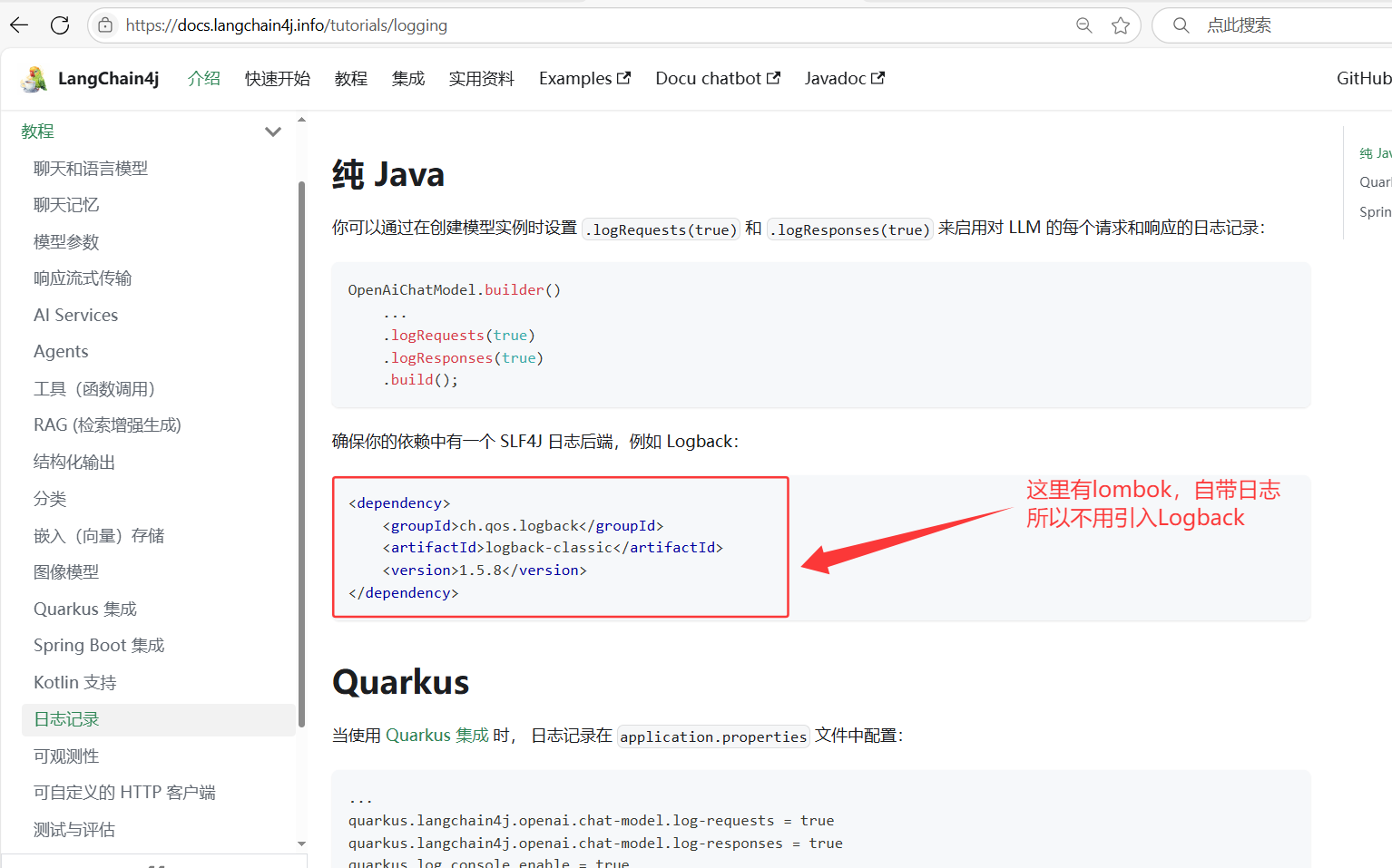

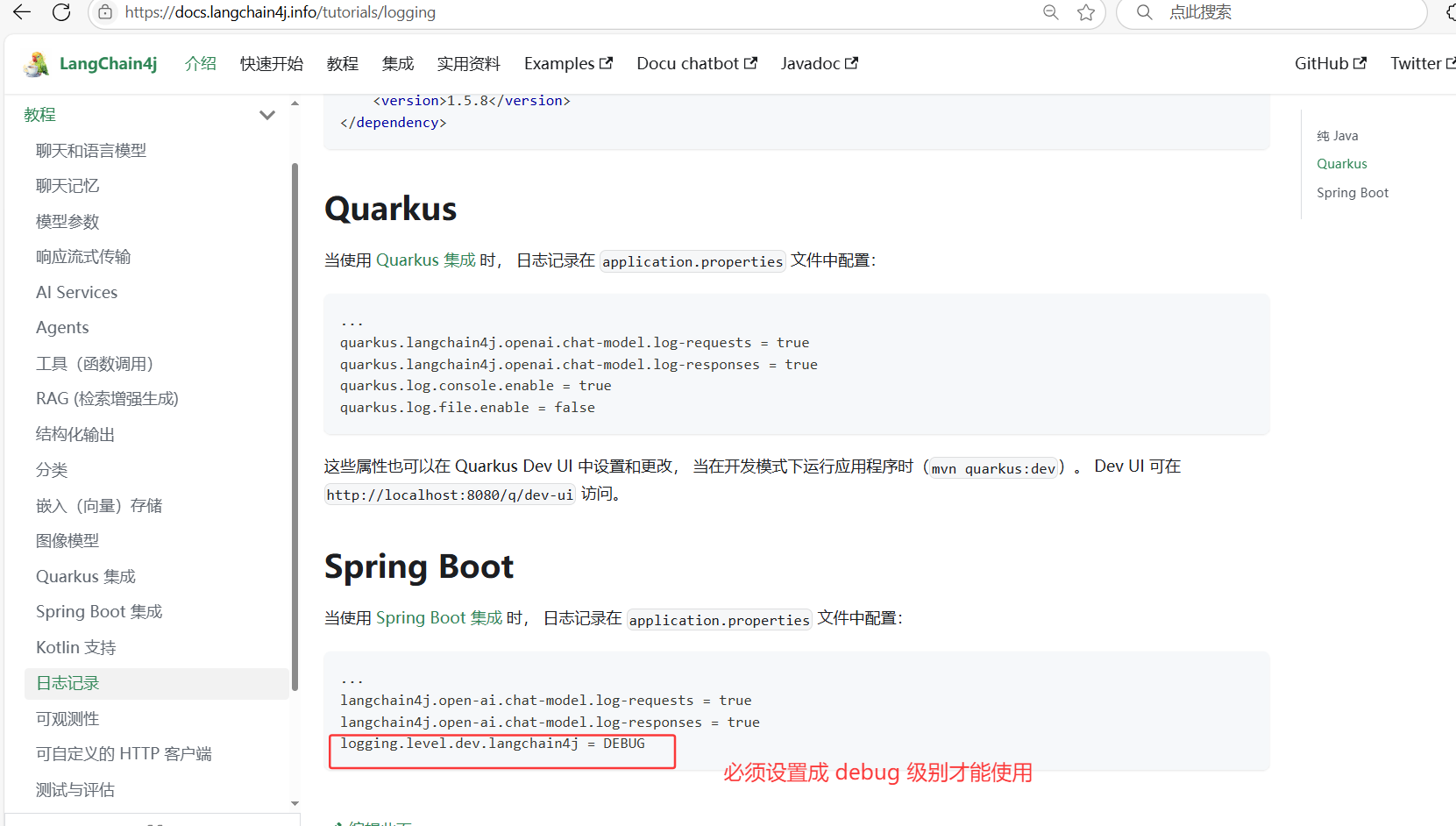

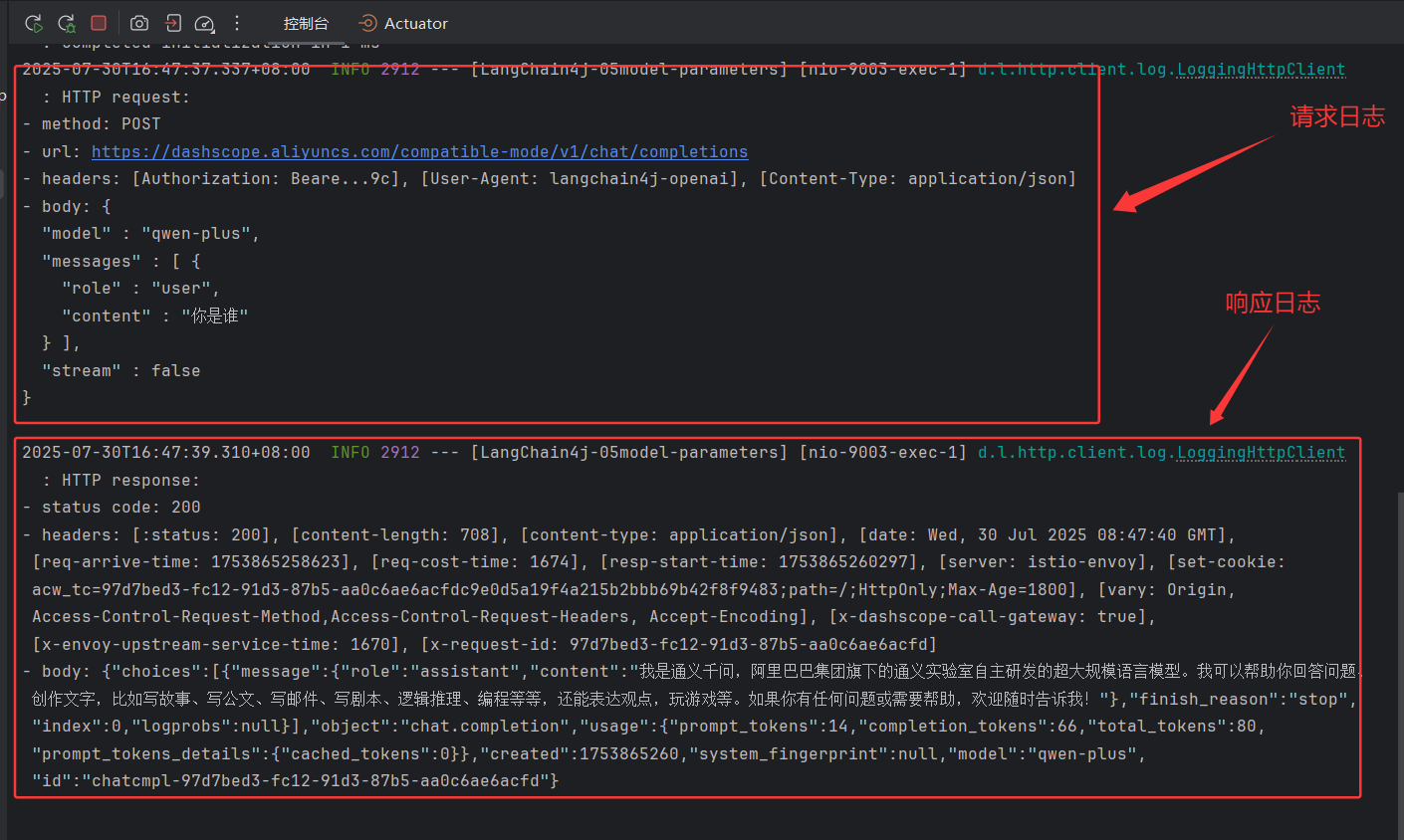

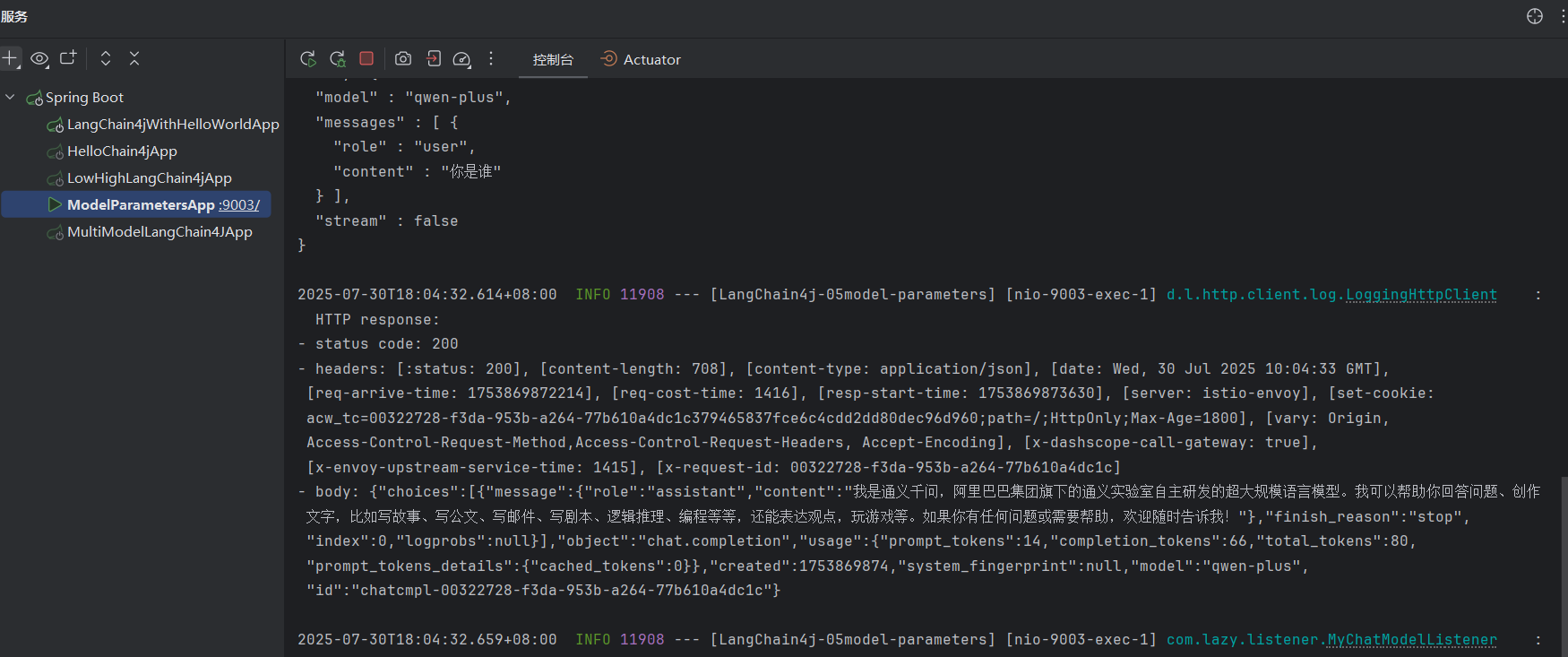

}日志配置(Logging)

https://docs.langchain4j.info/tutorials/logging

引入日志包

在

application.yaml,开启日志 yaml

yamllogging: level: dev: langchain4j: DEBUG开启日志

javapackage com.lazy.config; import dev.langchain4j.model.chat.ChatModel; import dev.langchain4j.model.openai.OpenAiChatModel; import org.springframework.context.annotation.Bean; import org.springframework.context.annotation.Configuration; @Configuration public class LLMConfig { @Bean public ChatModel chatModelQWen() { return OpenAiChatModel.builder() .apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key .modelName("qwen-plus")//模型名称 .baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址 .logRequests(true) //开启请求日志 .logResponses(true) //开启响应日志 .build(); } }测试

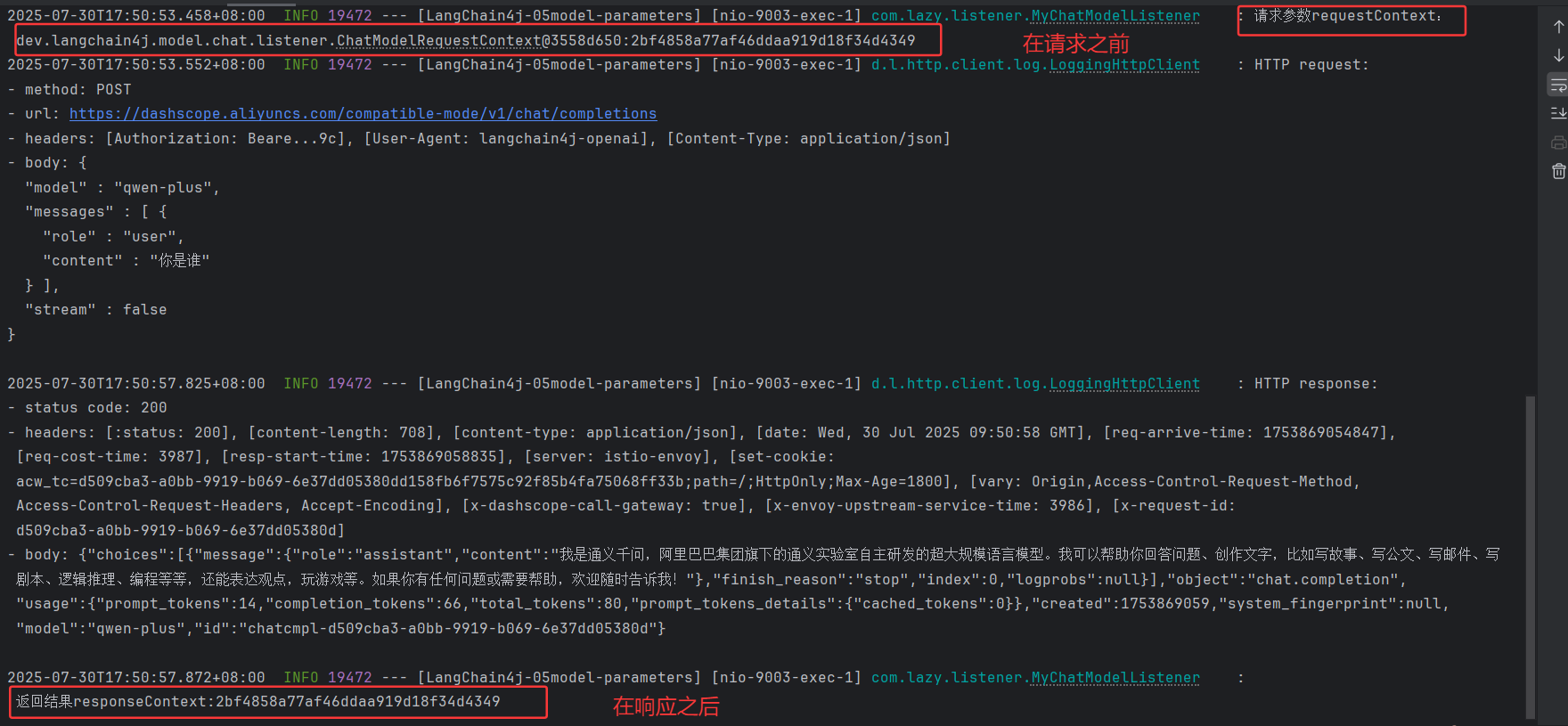

监控(observability)

https://docs.langchain4j.info/tutorials/observability

某些 ChatLanguageModel 和 StreamingChatLanguageModel 的实现 (参见"可观测性"列)允许配置 ChatModelListener(多个)来监听事件,例如:

- 向 LLM 发送的请求

- 来自 LLM 的响应

- 错误

我们就可以定义监听器,来监听这些事件的发生,如果发生意外,好做及时的处理!

结论

他是如何工作的?

- 监听器被指定为

List<ChatModelListener>,并按照迭代顺序调用。 - 监听器同步调用,并在同一线程中调用。有关流式处理情况的更多详细信息,请参见下文。 第二个监听器直到第一个监听器返回后才会被调用。

ChatModelListener.onRequest()方法在调用 LLM 提供商 API 之前立即调用。ChatModelListener.onRequest()方法每个请求只调用一次。 如果在调用 LLM 提供商 API 时发生错误并进行重试,ChatModelListener.onRequest()将***不会***为每次重试调用。ChatModelListener.onResponse()方法只调用一次, 在从 LLM 提供商收到成功响应后立即调用。ChatModelListener.onError()方法只调用一次。 如果在调用 LLM 提供商 API 时发生错误并进行重试,ChatModelListener.onError()将***不会***为每次重试调用。- 如果从

ChatModelListener方法之一抛出异常, 它将以WARN级别记录。后续监听器的执行将照常继续。 - 通过

ChatModelRequestContext、ChatModelResponseContext和ChatModelErrorContext提供的ChatRequest是最终请求,包含在ChatLanguageModel上配置的默认ChatRequestParameters和特定于请求的ChatRequestParameters合并在一起。 - 对于

StreamingChatLanguageModel,ChatModelListener.onResponse()和ChatModelListener.onError()在与ChatModelListener.onRequest()不同的线程上调用。 线程上下文目前不会自动传播,因此您可能希望使用attributes映射 从ChatModelListener.onRequest()传播任何必要的数据到ChatModelListener.onResponse()或ChatModelListener.onError()。 - 对于

StreamingChatLanguageModel,ChatModelListener.onResponse()在StreamingChatResponseHandler.onCompleteResponse()被调用之前调用。ChatModelListener.onError()在StreamingChatResponseHandler.onError()被调用之前调用。

案例

在上面的代码进行改造

创建一个MyChatModelLinstener监听器,并实现ChatModelLinstener接口

package com.lazy.listener;

import cn.hutool.core.util.IdUtil;

import dev.langchain4j.model.chat.listener.ChatModelErrorContext;

import dev.langchain4j.model.chat.listener.ChatModelListener;

import dev.langchain4j.model.chat.listener.ChatModelRequestContext;

import dev.langchain4j.model.chat.listener.ChatModelResponseContext;

import lombok.extern.slf4j.Slf4j;

@Slf4j

public class MyChatModelListener implements ChatModelListener {

@Override

public void onRequest(ChatModelRequestContext requestContext) {

String requestId = IdUtil.simpleUUID();

requestContext.attributes().put("traceId", requestId);

log.info("请求参数requestContext:{}", requestContext+":"+requestId);

}

@Override

public void onResponse(ChatModelResponseContext responseContext) {

Object traceId = responseContext.attributes().get("traceId");

log.info("返回结果responseContext:{}",traceId);

}

@Override

public void onError(ChatModelErrorContext errorContext) {

log.info("发生错误了errorContext:{}",errorContext);

}

}将监听器,添加到大模型配置类里面

LLMConfig

package com.lazy.config;

import com.lazy.listener.MyChatModelListener;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.util.List;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.logRequests(true) //开启请求日志

.logResponses(true) //开启响应日志

.listeners(List.of(new MyChatModelListener()))//将我们写入的监听器,添加到里面

.build();

}

}由于listeners方法传递的是List集合,所以我们使用List.of添加List集合里面在传入

测试

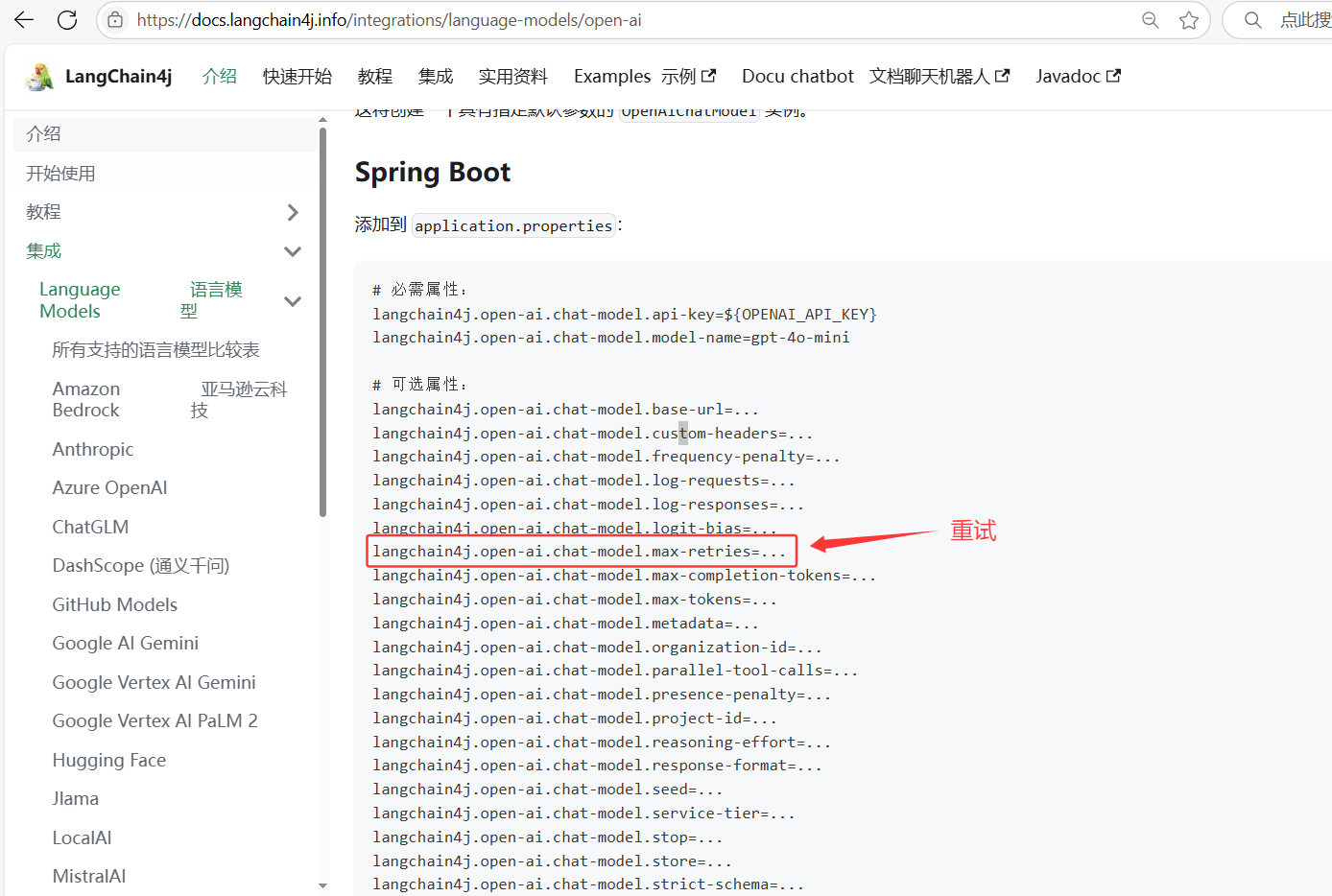

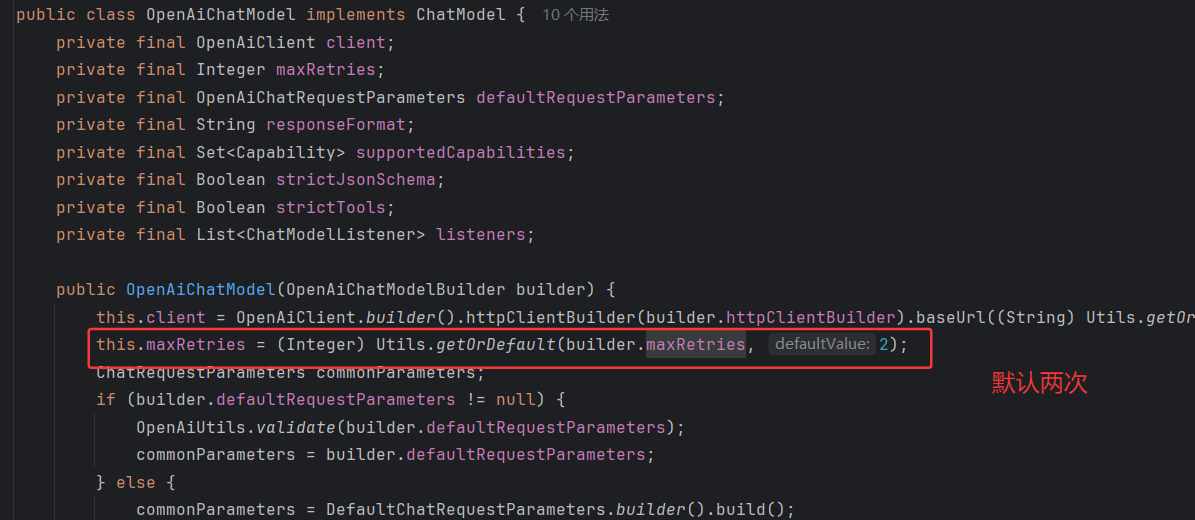

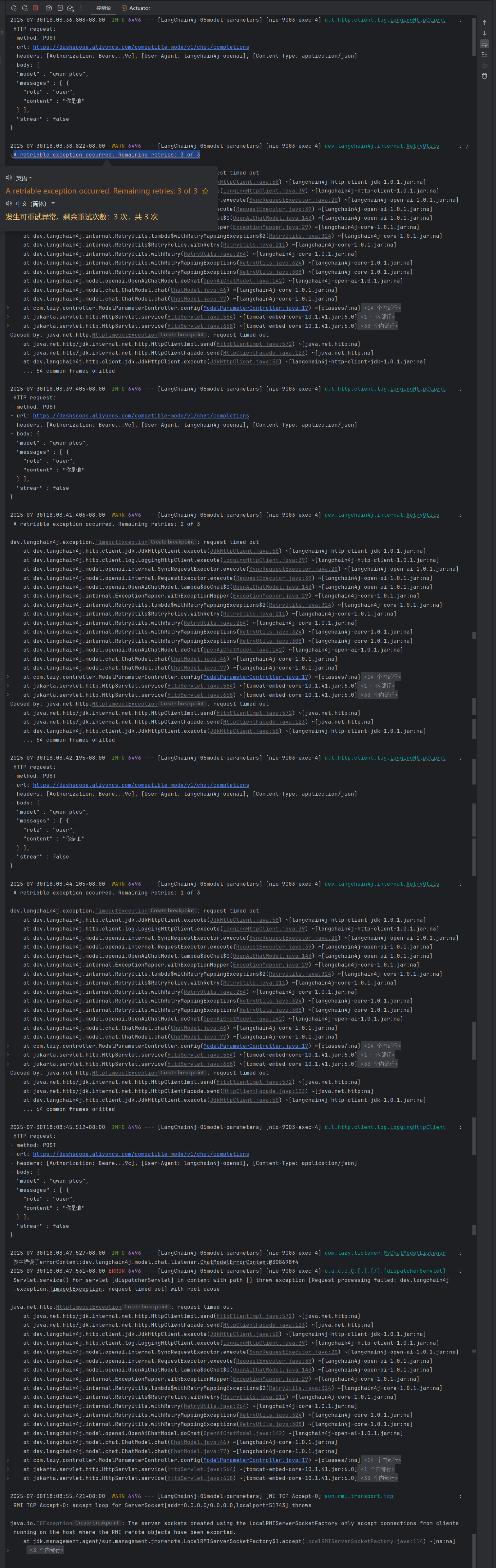

重试机制(Retry Configuration)

改造LLMConfig,添加重试和超时配置

package com.lazy.config;

import com.lazy.listener.MyChatModelListener;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.time.Duration;

import java.util.List;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.logRequests(true) //开启请求日志

.logResponses(true) //开启响应日志

.listeners(List.of(new MyChatModelListener()))

.maxRetries(3)//最大重试次数

.timeout(Duration.ofMillis(2000))//超时时间2秒

.build();

}

}测试

正常的情况

异常情况

发现重试了4次,因为,重试的时候不包含第一次请求的

超时控制(timeout)

向大模型发送请求,如过在指定的时间内没有收到响应,该请求被中断并且报request timed out(请求超时)

在重试机制演示了超时控制,所以不在演示

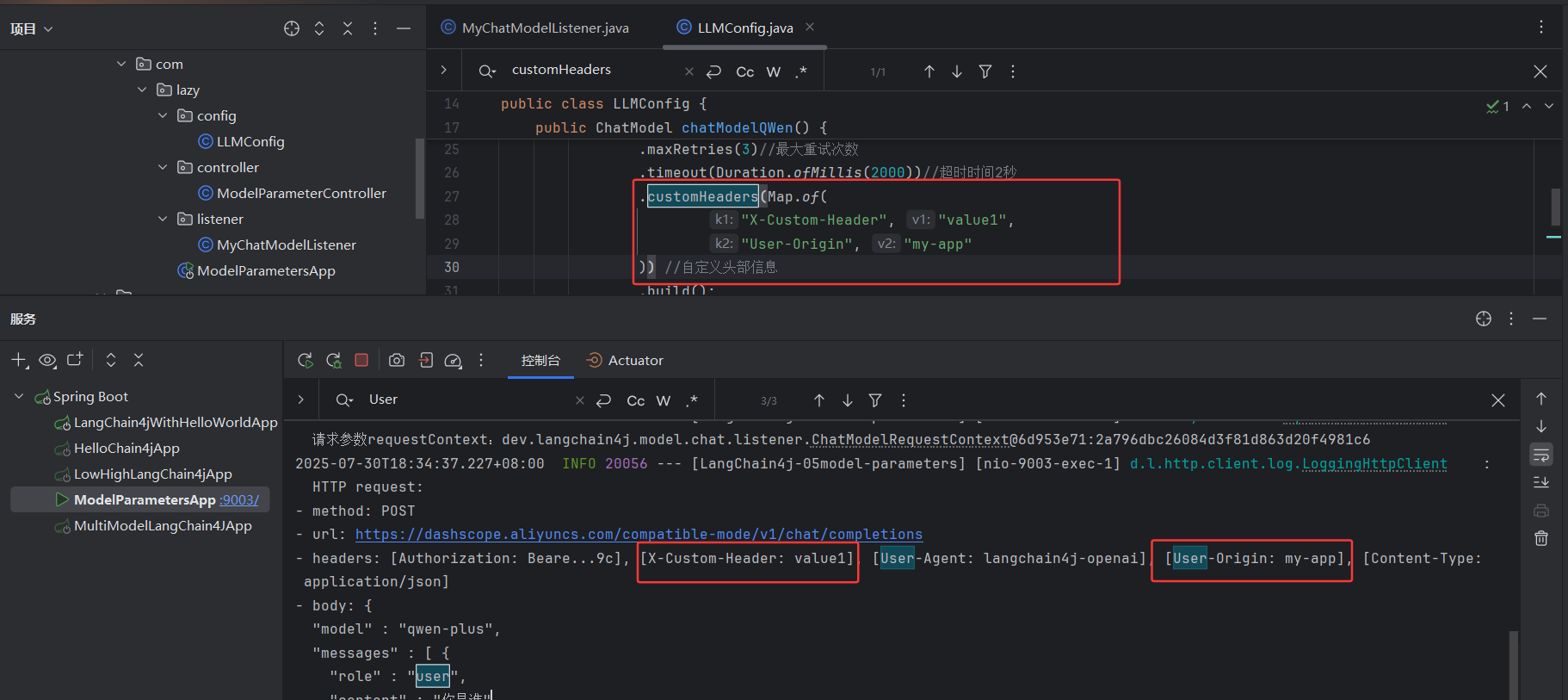

自定义头

在 LangChain4j 中,customHeaders 是一个用于向 HTTP 请求添加**自定义请求头(HTTP Headers)**的配置选项。它主要用于与外部 API(如 OpenAI、Azure OpenAI、Hugging Face 等模型服务)交互时,传递额外的元数据或认证信息。

核心作用:

- 自定义认证:添加 API 密钥、Token 或其他认证凭据。

- 传递元数据:添加业务相关的标识(如请求来源、版本号)。

- 兼容特定服务:适配某些 API 的特殊头部要求(如

x-api-key)。

案例

改造LLMConfig类

package com.lazy.config;

import com.lazy.listener.MyChatModelListener;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import java.time.Duration;

import java.util.List;

import java.util.Map;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))//从系统环境变量获得key

.modelName("qwen-plus")//模型名称

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")//模型接口地址

.logRequests(true) //开启请求日志

.logResponses(true) //开启响应日志

.listeners(List.of(new MyChatModelListener()))

.maxRetries(3)//最大重试次数

.timeout(Duration.ofMillis(2000))//超时时间2秒

.customHeaders(Map.of(

"X-Custom-Header", "value1",

"User-Origin", "my-app"

)) //自定义头部信息

.build();

}

}测试

注意事项:

- 优先级:若与 LangChain4j 默认头部(如

Authorization)冲突,customHeaders中的值会覆盖默认值。- 安全性:避免在

customHeaders中硬编码敏感信息(建议通过环境变量注入)。- 服务兼容性:不同 API 对头部的支持不同(如 OpenAI 用

Authorization,Azure 用api-key)。- 自定义头是添加到请求头上的,而不是响应头!

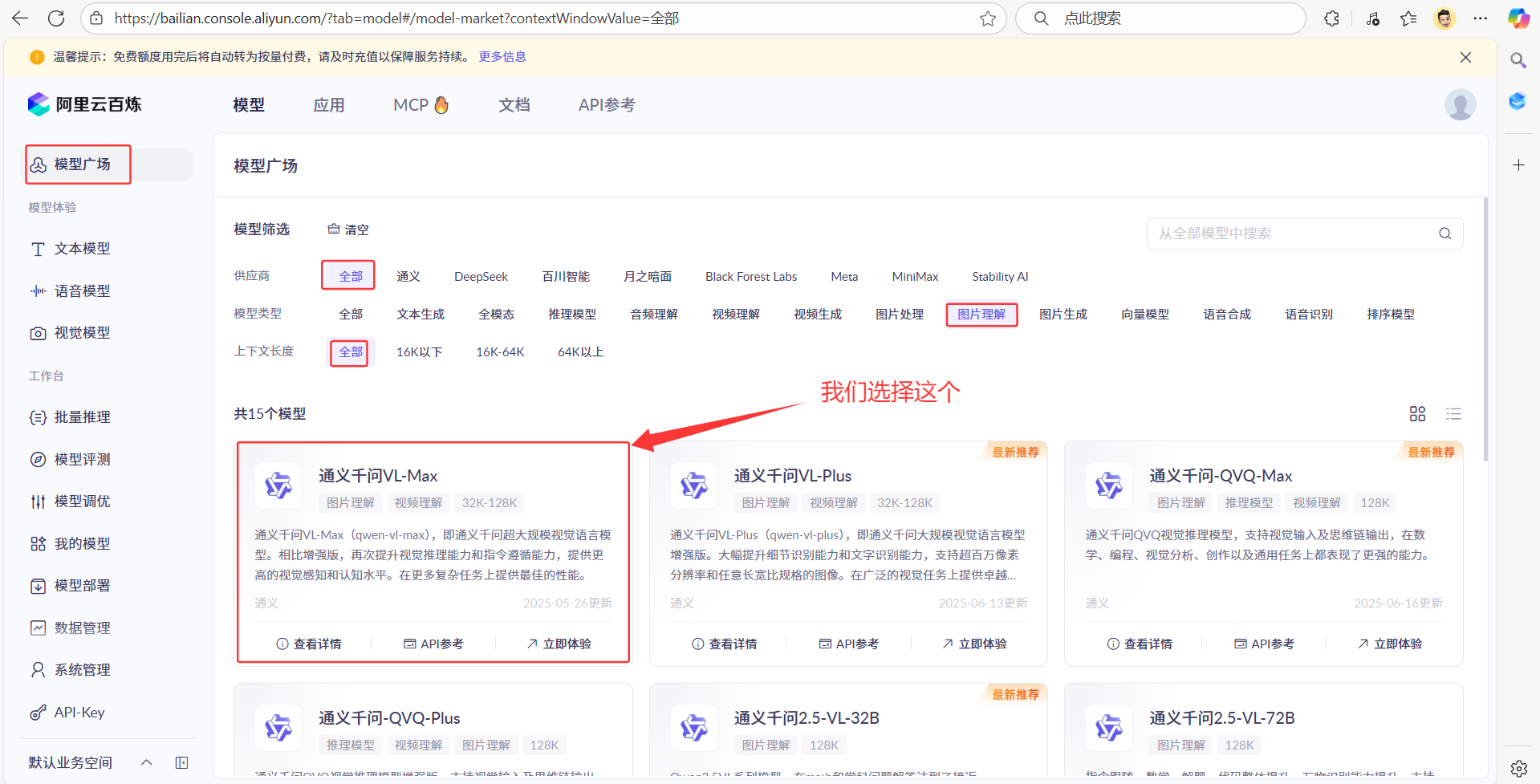

多模态视觉理解

“多模态视觉” 是指 计算机视觉技术与其他感知模态(如语言、声音、触觉等)相结合 的研究和应用领域。它的核心思想是模仿人类感知世界的方式——我们并非仅仅依靠眼睛看,而是综合运用视觉、听觉、触觉、语言理解等多种感官信息来理解和交互环境。

就是利用图片和文字跟 AI 进行对话!

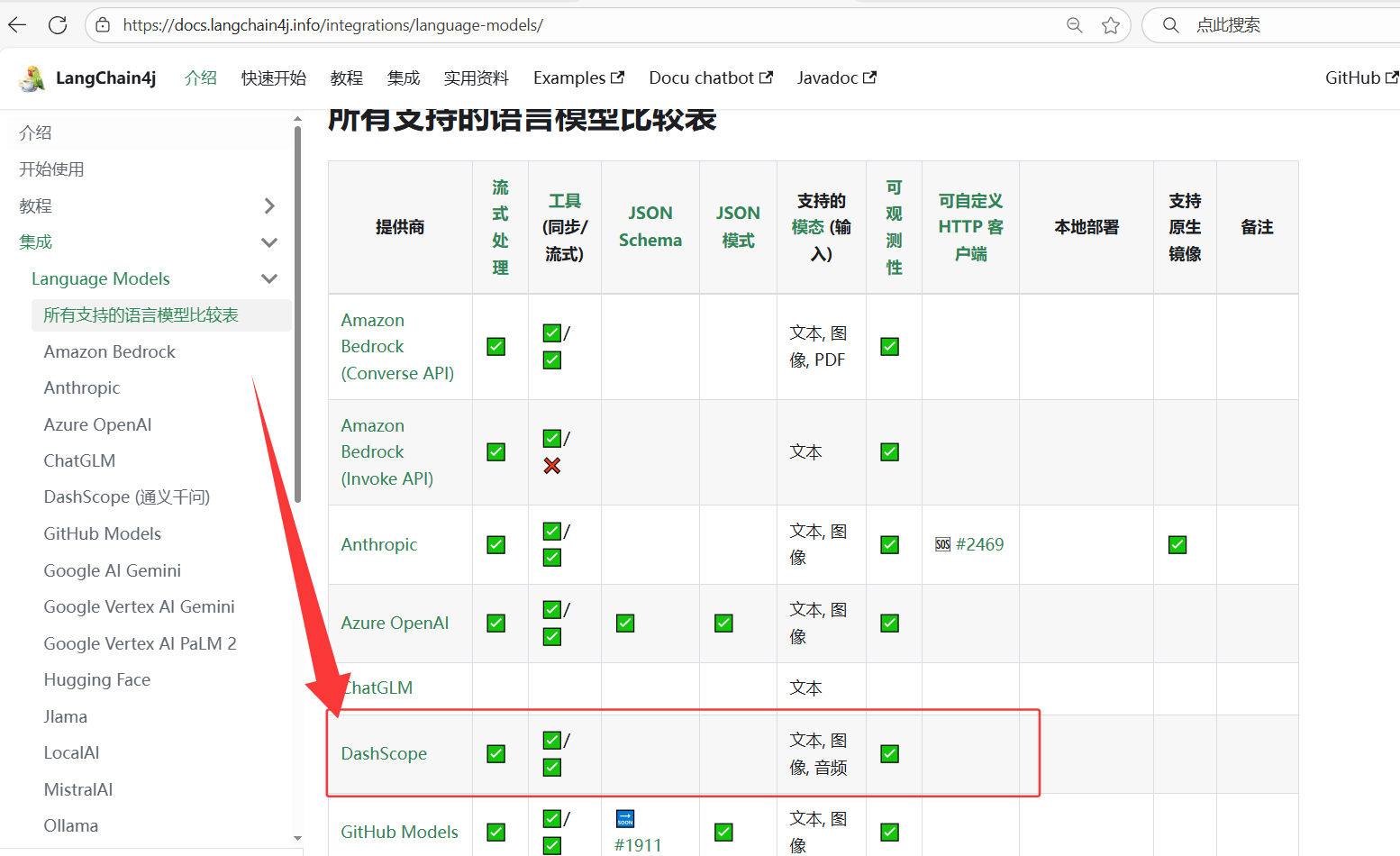

所有支持的语言模型比较表

| 提供商 | 流式处理 | 工具 (同步/流式) | JSON Schema | JSON 模式 | 支持的模态 (输入) | 可观测性 | 可自定义 HTTP 客户端 | 本地部署 | 支持原生镜像 | 备注 |

|---|---|---|---|---|---|---|---|---|---|---|

| Amazon Bedrock (Converse API) | ✅ | ✅/✅ | 文本, 图像, PDF | ✅ | ||||||

| Amazon Bedrock (Invoke API) | ✅ | ✅/❌ | 文本 | ✅ | ||||||

| Anthropic | ✅ | ✅/✅ | 文本, 图像 | ✅ | 🆘 #2469 | ✅ | ||||

| Azure OpenAI | ✅ | ✅/✅ | ✅ | ✅ | 文本, 图像 | ✅ | ||||

| ChatGLM | 文本 | |||||||||

| DashScope | ✅ | ✅/✅ | 文本, 图像, 音频 | ✅ | ||||||

| GitHub Models | ✅ | ✅/✅ | 🔜 #1911 | ✅ | 文本, 图像 | ✅ | ||||

| Google AI Gemini | ✅ | ✅/✅ | ✅ | ✅ | 文本, 图像, 音频, 视频, PDF | ✅ | ||||

| Google Vertex AI Gemini | ✅ | ✅/✅ | 🆘 #1717 | ✅ | 文本, 图像, 音频, 视频, PDF | ✅ | ||||

| Google Vertex AI PaLM 2 | 文本 | ✅ | ||||||||

| Hugging Face | 文本 | |||||||||

| Jlama | ✅ | ✅/✅ | 文本 | ✅ | ✅ | |||||

| LocalAI | ✅ | ✅/✅ | 文本, 图像, 音频 | ✅ | ||||||

| Mistral AI | ✅ | ✅/✅ | ✅ | ✅ | 文本 | 🆘 #2524 | ||||

| Ollama | ✅ | ✅/✅ | ✅ | ✅ | 文本, 图像 | ✅ | ✅ | ✅ | ||

| OpenAI | ✅ | ✅/✅ | ✅ | ✅ | 文本, 图像, 音频 | ✅ | ✅ | 兼容:Ollama, LM Studio, GPT4All, 等 | ✅ | 兼容:Groq, 等 |

| Qianfan | ✅ | ✅/✅ | 文本 | |||||||

| Cloudflare Workers AI | 文本 | |||||||||

| Zhipu AI | ✅ | ✅/✅ | 文本, 图像 | ✅ |

图例:

- ✅ 表示"支持"

- 🆘 表示"尚未支持;请帮助我们实现它"

- 🔜 表示"正在实现中;请等待"

- ❌ 表示"LLM 提供商不支持"

选择模型

我们用阿里云百炼平台,地址:https://bailian.console.aliyun.com/

模型名字,点击要选择的模型,查看详情

模型的api地址,点击查看api参考

code 案例

example 1(LangChain4j 原生)

建module:LangChain4j-06chat-image

pom

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

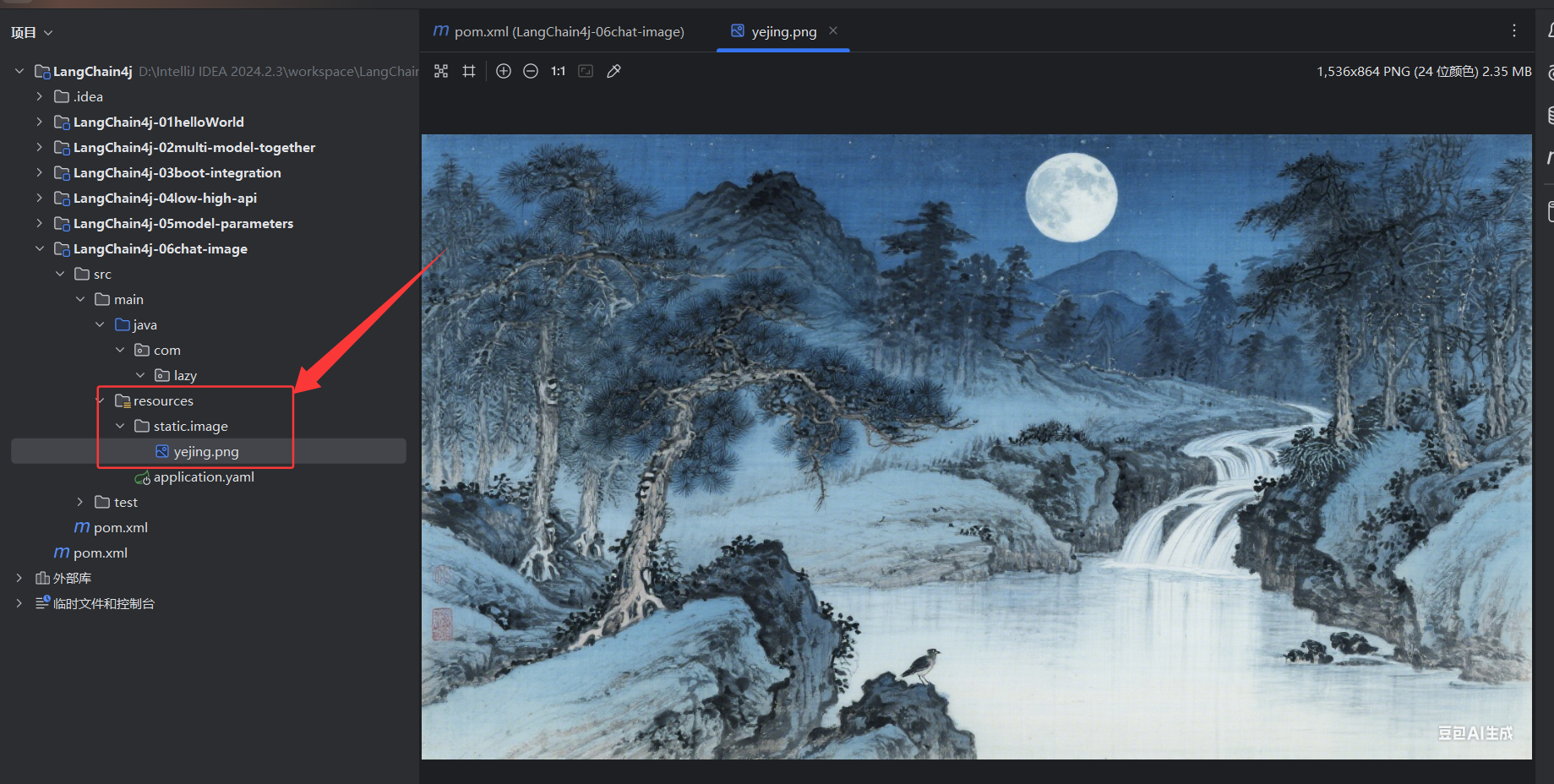

</build>引入图片到resources/static/image

LLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModelQWen() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

//qwen-vl-max 是一个多模态大模型,支持图片和文本的结合输入,适用于视觉-语言任务。

.modelName("qwen-vl-max")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

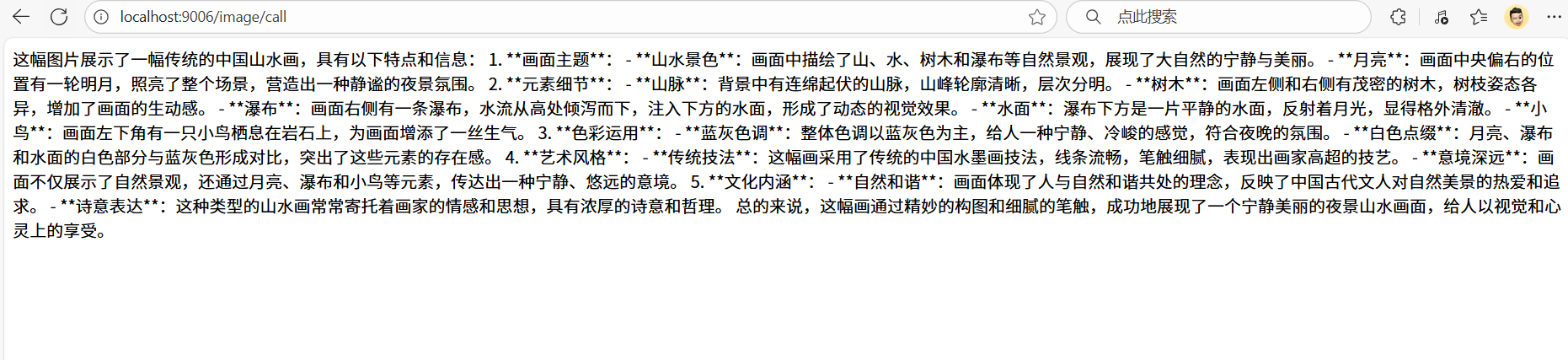

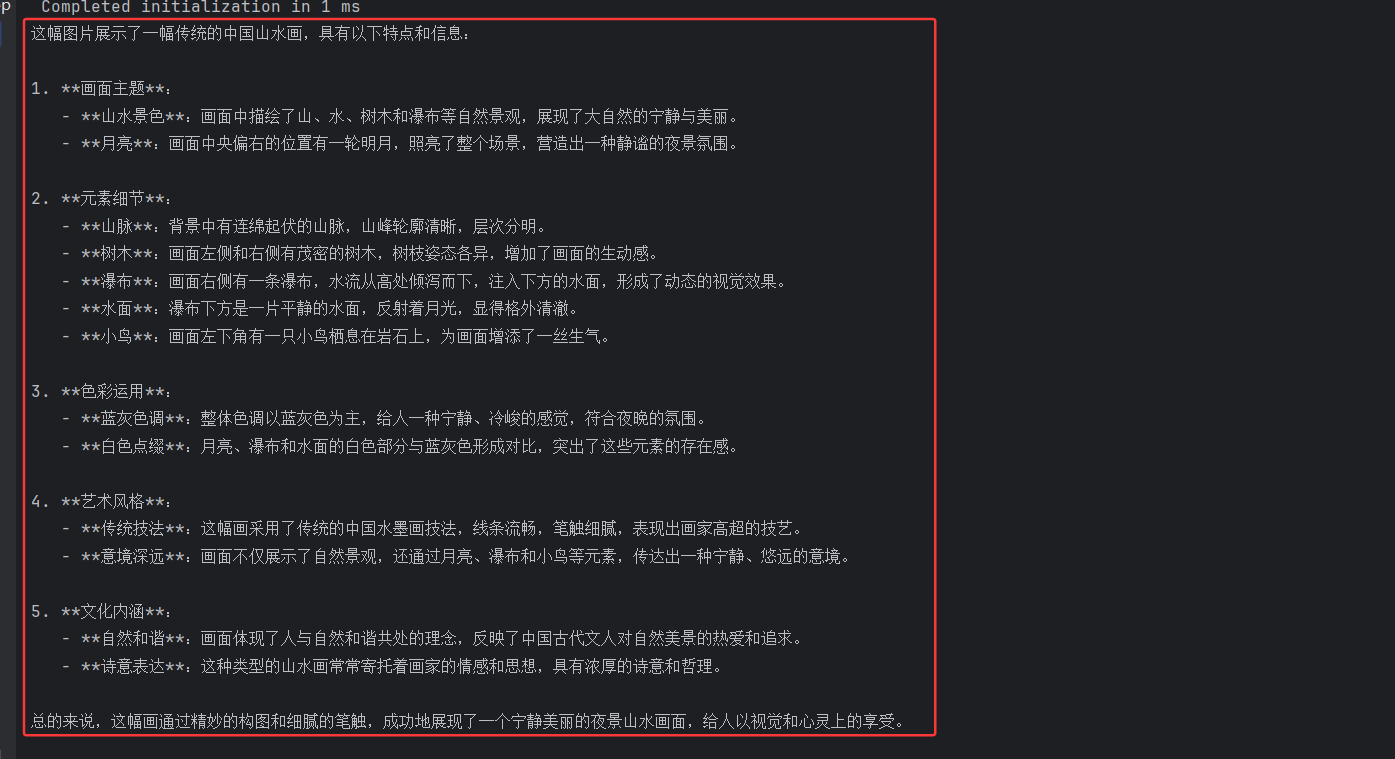

}编码步骤

- 图片转码:通过Base64编码将图片转化为字符串

- 提示词指定:结合

ImageContent和TextContent一起发送到模型处理 - API调用:使用

OpenAiChatModel来构建请求,并通过chat()方法调用模型。请求内容包括文本提示和图片,模型会根据输入返回分析结果。 - 解析与输出:从

ChatResponse中获取AI大模型的回复,打印出处理后的结果。

controller

package com.lazy.controller;

import dev.langchain4j.data.message.ImageContent;

import dev.langchain4j.data.message.TextContent;

import dev.langchain4j.data.message.UserMessage;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.response.ChatResponse;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.core.io.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

import java.io.IOException;

import java.util.Base64;

@RestController

public class ImageModelController {

@Value("classpath:static/yejing.png")

private Resource resource;

@Autowired

private ChatModel chatModel;

@GetMapping("/image/call")

public String call() throws IOException {

//1. 图片转码:通过Base64编码将图片转化为字符串

byte[] byteArray = resource.getContentAsByteArray();

//将图片转成base64编码

String base64Data = Base64.getEncoder().encodeToString(byteArray);

//2.提示词指定:结合ImageContent和TextContent一起发送到模型处理

UserMessage userMessage = UserMessage.from(

TextContent.from("从图片你能得到什么信息?"),

ImageContent.from(base64Data,"image/png")

);

//3.解析与输出:从ChatResponse中获取AI大模型的回复,打印出处理后的结果。

ChatResponse chatResponse = chatModel.chat(userMessage);

String result = chatResponse.aiMessage().text();

System.out.println(result);

return result;

}

}测试

为什么用AiMessage?

example 2(LangChain4j跟第三方整合)

地址:https://docs.langchain4j.info/integrations/language-models/dashscope

结合阿里巴巴通义万相进行图像理解,其支持视觉+语言的多模态任务

切换通义万相-文生图模型wanx2.1-t2i-turbo

两种方式

原生

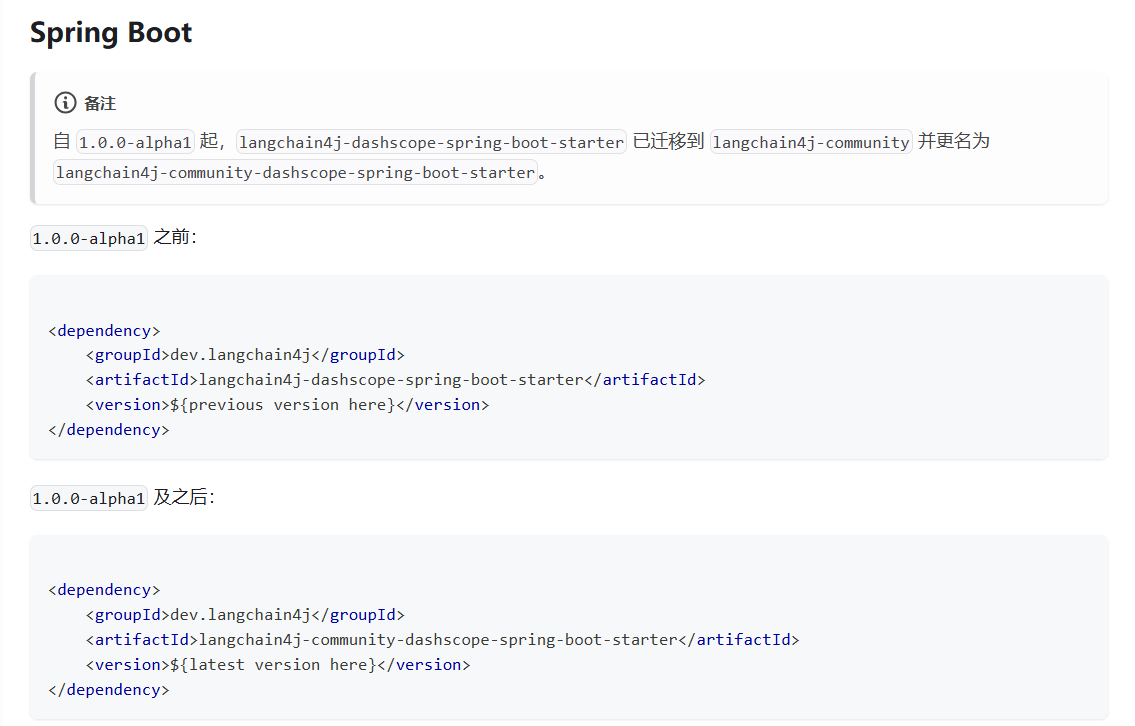

集成SpringBoot

我们在父工程的pom文件引入,物料管理清单

<langchain4j-community.version>1.0.1-beta6</langchain4j-community.version>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-bom</artifactId>

<version>${langchain4j-community.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>在子项目下引入

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-dashscope-spring-boot-starter</artifactId>

</dependency>修改LLMConfig

package com.lazy.config;

import dev.langchain4j.community.model.dashscope.WanxImageModel;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

/**

* 测试通义万象来实现图片生成,

* @return

*/

@Bean

public WanxImageModel wanxImageModel(){

return WanxImageModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("wanx2.1-t2i-turbo") //图片生成 https://help.aliyun.com/zh/model-studio/text-to-image

.build();

}

}WanxImageModelController

package com.lazy.controller;

import com.alibaba.dashscope.aigc.imagesynthesis.ImageSynthesis;

import com.alibaba.dashscope.aigc.imagesynthesis.ImageSynthesisParam;

import com.alibaba.dashscope.aigc.imagesynthesis.ImageSynthesisResult;

import com.alibaba.dashscope.exception.NoApiKeyException;

import com.alibaba.dashscope.utils.JsonUtils;

import dev.langchain4j.community.model.dashscope.WanxImageModel;

import dev.langchain4j.data.image.Image;

import dev.langchain4j.model.output.Response;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class WanxImageModelController {

@Autowired

private WanxImageModel wanxImageModel;

@GetMapping("/image/create")

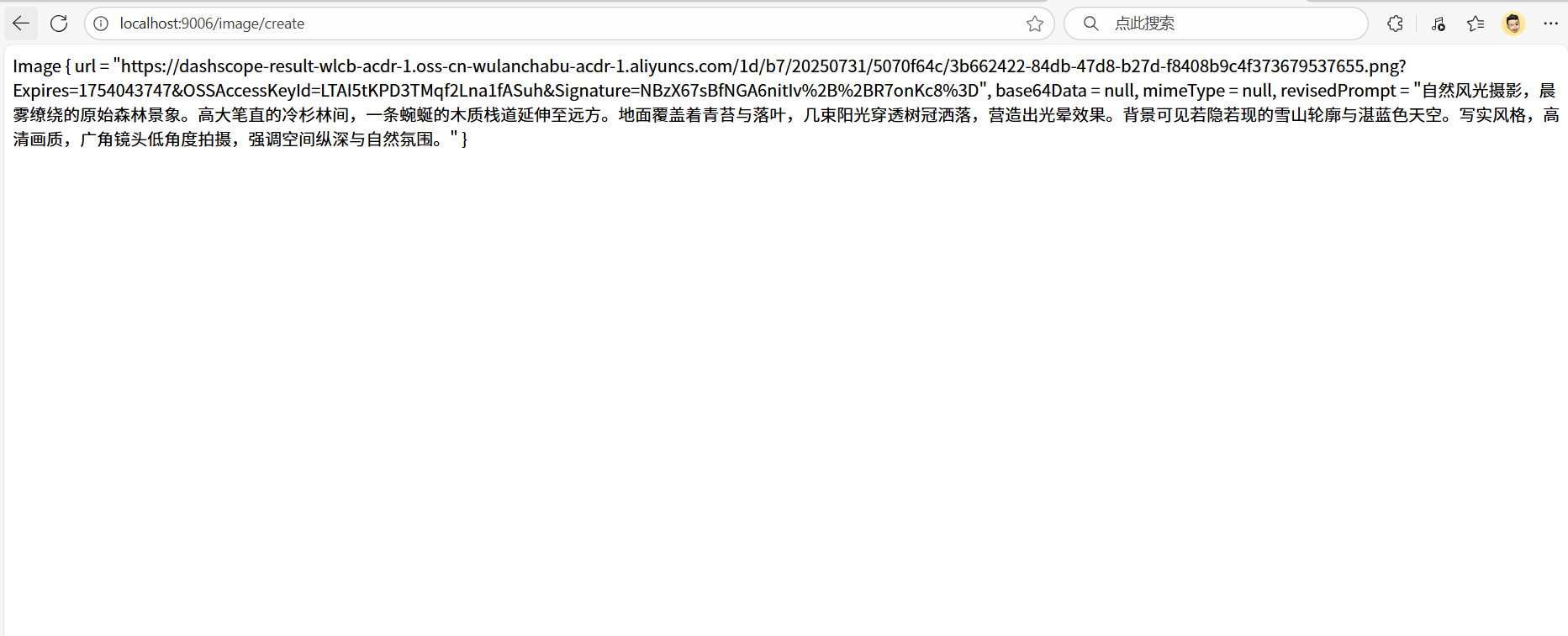

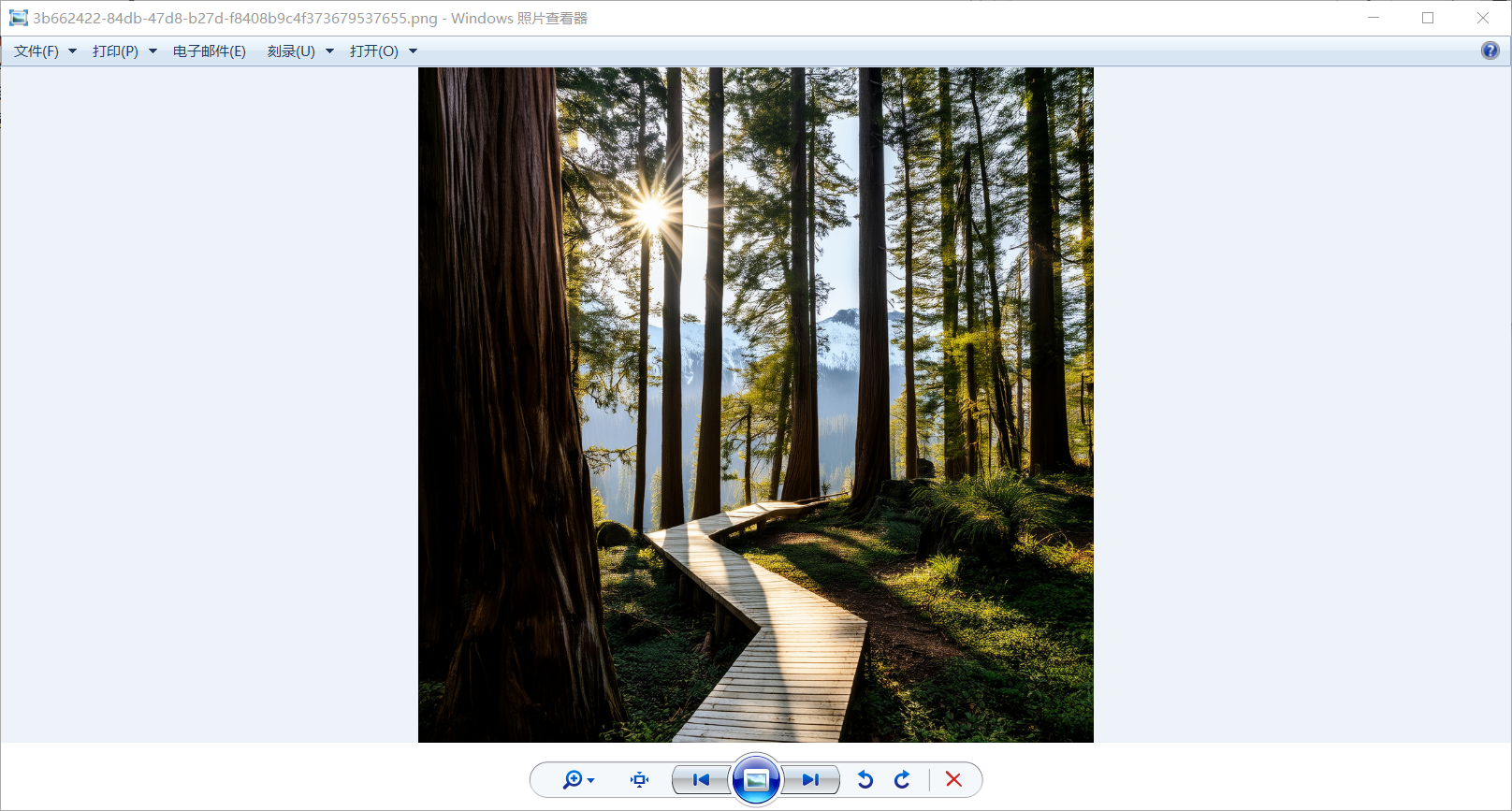

public String createImageModel() {

Response<Image> imageResponse = wanxImageModel.generate("风景照");

System.out.println(imageResponse.content().url());

return imageResponse.content().toString();

}

@GetMapping("/image/create2")

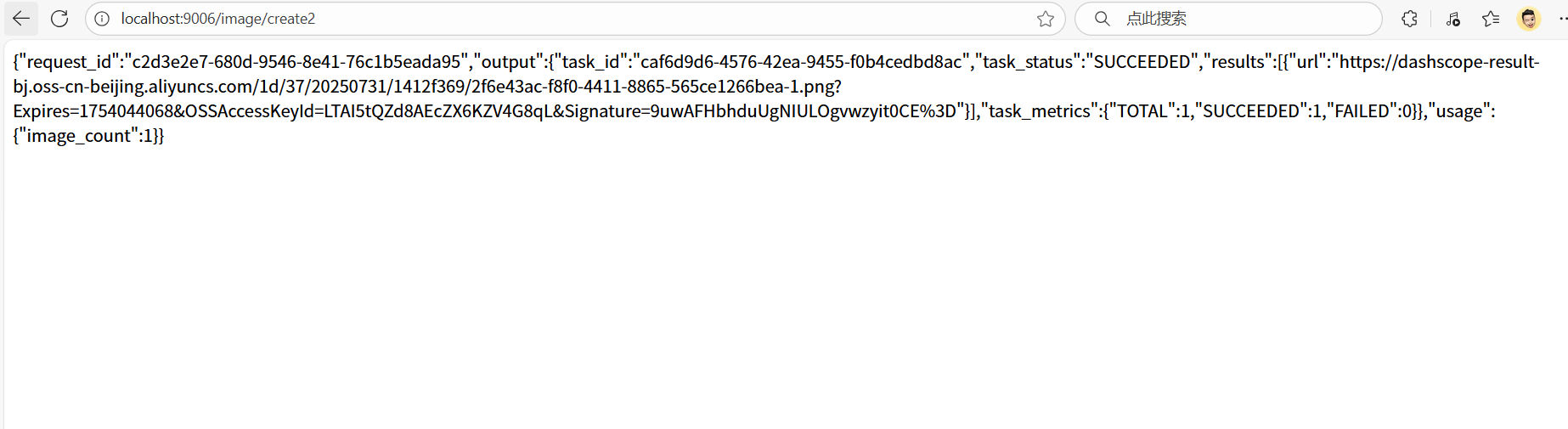

public String create2ImageModel() {

String prompt = "图片风格为3D渲染,中国风,一个巨大的展开的卷轴在空中飘浮,金银色调,玉髓雕刻," +

"色彩细腻,广角镜头,blender 渲染,丰富细节,超高清";

ImageSynthesisParam param = ImageSynthesisParam.builder()

.apiKey(System.getenv("aliQWen-api"))

.model(ImageSynthesis.Models.WANX_V1) //wanx_v1模型

.prompt(prompt) //图片要求

.style("<watercolor>") //水彩画

.n(1) //数量

.size("1024*1024") //大小

.build();

ImageSynthesis imageSynthesis = new ImageSynthesis();

ImageSynthesisResult result;

try {

result = imageSynthesis.call(param);

} catch (NoApiKeyException e) {

throw new RuntimeException(e);

}

return JsonUtils.toJson(result);

}

}测试

流式输出(streamingoutput)

网址:https://docs.langchain4j.info/tutorials/response-streaming

是什么?

- 是一种逐步返回大模型生成结果的技术,生成一点返回一点,允许服务器将响应内容分批次实时传输给客户端,而不是等待全部内容生成完毕后再一次性返回。这种机制能显著提升用户体验,尤其适用于大模型响应较慢的场景(如生成长文本或复杂推理结果)。

低阶api

建module:LangChain4j-07chat-stream

pom

<properties>

<maven.compiler.target>17</maven.compiler.target>

<maven.compiler.source>17</maven.compiler.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

</dependencies>yaml

server:

port: 9007

# 设置响应的字符编码,避免流式返回输出乱码

servlet:

encoding:

charset: utf-8

enabled: true # 启用http编码支持

force: true # HTTP 请求和响应上强制编码到配置的字符集

spring:

application:

name: LangChain4j-07chat-streamLLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.StreamingChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.model.openai.OpenAiStreamingChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

/**

* 普通对话

* @return

*/

@Bean

public ChatModel chatModelQWen(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

/**

* 配置流式输出

* @return

*/

@Bean

public StreamingChatModel streamingChatModelQWen() {

return OpenAiStreamingChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

}StreamChatModelController

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.StreamingChatModel;

import dev.langchain4j.model.chat.response.ChatResponse;

import dev.langchain4j.model.chat.response.StreamingChatResponseHandler;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class StreamChatModelController {

@Resource

private ChatModel chatModelQWen;

@Resource

private StreamingChatModel streamingChatModel;

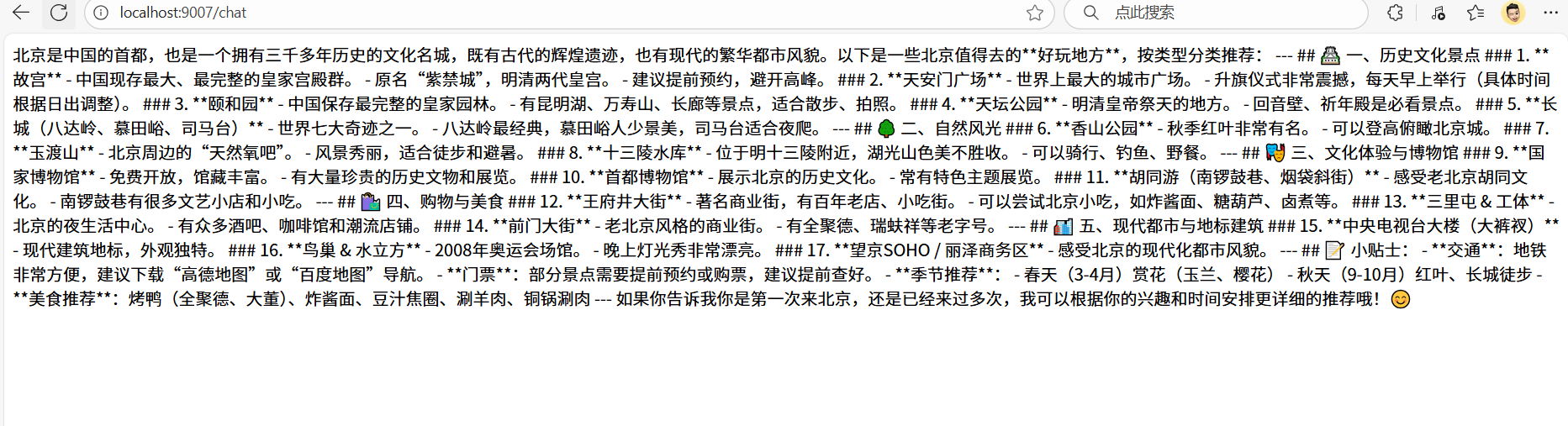

@GetMapping("/chat")

public String getStreamingChatModel(@RequestParam(value = "prompt",

defaultValue = "说一下北京有什么好玩的地方?") String prompt) {

return chatModelQWen.chat(prompt);

}

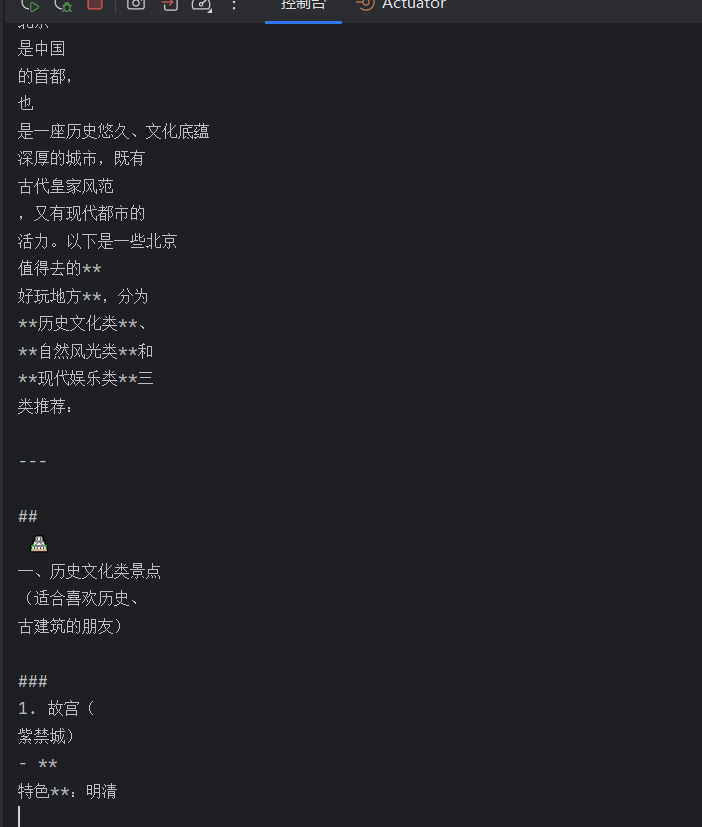

@GetMapping("/streaming")

public void streaming(@RequestParam(value = "prompt",

defaultValue = "说一下北京有什么好玩的地方?") String prompt) {

streamingChatModel.chat(prompt,new StreamingChatResponseHandler() {

@Override

public void onPartialResponse(String partialResponse) {

System.out.println(partialResponse);

}

@Override

public void onCompleteResponse(ChatResponse completeResponse) {

System.out.println(completeResponse);

}

@Override

public void onError(Throwable throwable) {

System.out.println(throwable);

}

});

}

}测试

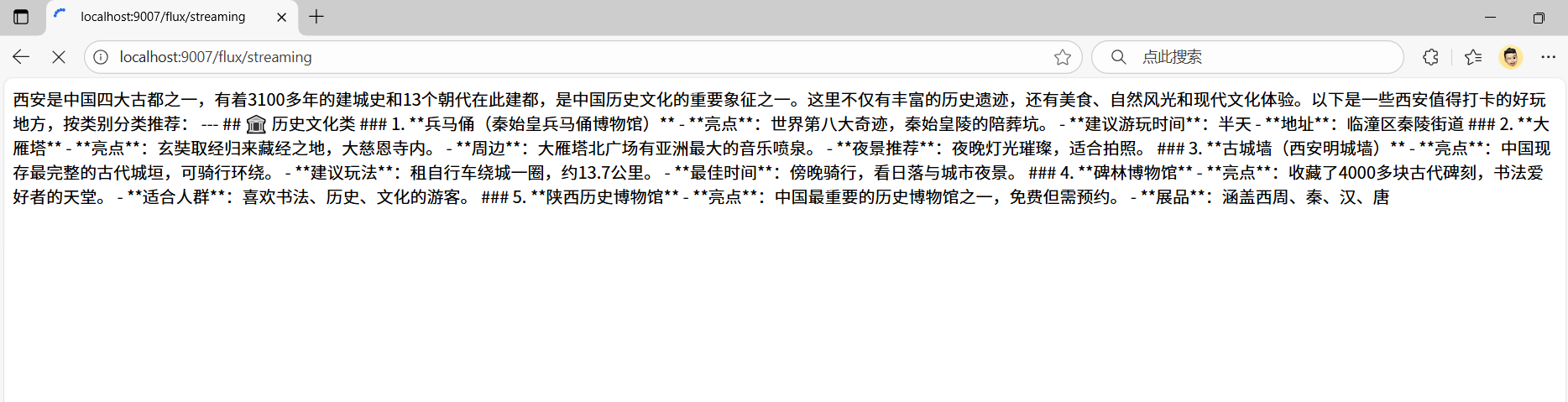

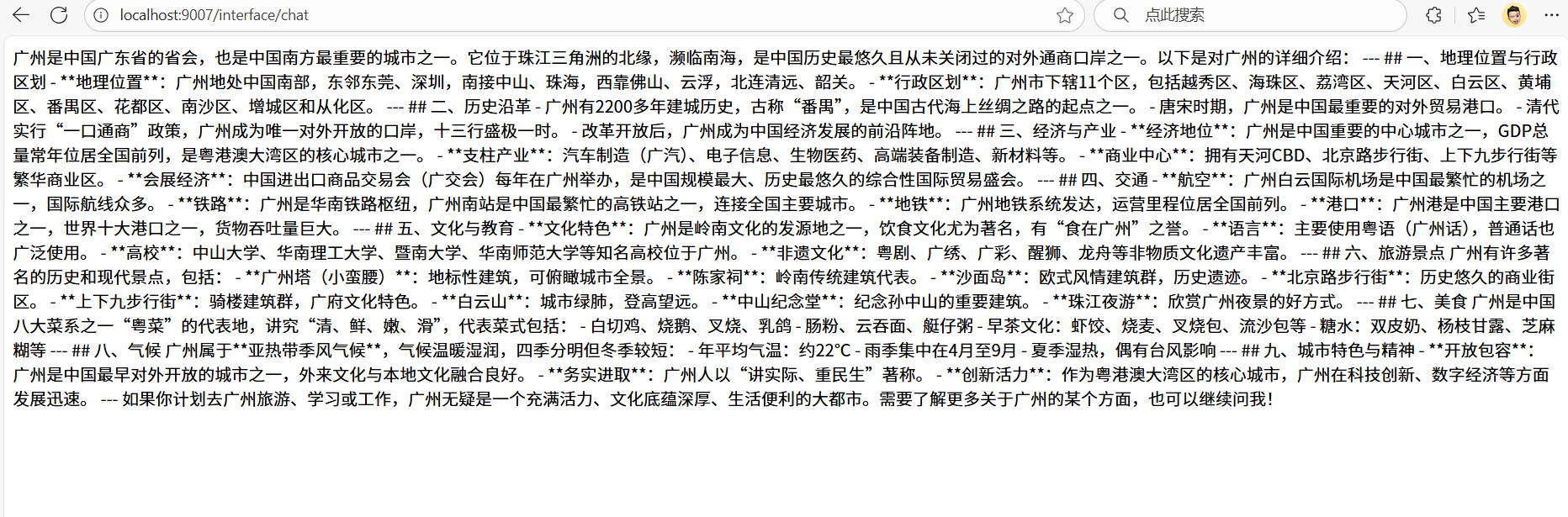

普通的

流水输出

高阶api(结合webFlux编程)

pom

<properties>

<maven.compiler.target>17</maven.compiler.target>

<maven.compiler.source>17</maven.compiler.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- 高阶api -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!-- langchain4j 结合web Flux编程 -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-reactor</artifactId>

</dependency>

</dependencies>yaml

server:

port: 9007

# 设置响应的字符编码,避免流式返回输出乱码

servlet:

encoding:

charset: utf-8

enabled: true # 启用http编码支持

force: true # HTTP 请求和响应上强制编码到配置的字符集

spring:

application:

name: LangChain4j-07chat-streamLLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.StreamingChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.model.openai.OpenAiStreamingChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

/**

* 普通对话

* @return

*/

@Bean

public ChatModel chatModelQWen(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

/**

* 配置流式输出

* @return

*/

@Bean

public StreamingChatModel streamingChatModelQWen() {

return OpenAiStreamingChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

}StreamingChatModelController

package com.lazy.controller;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.StreamingChatModel;

import dev.langchain4j.model.chat.response.ChatResponse;

import dev.langchain4j.model.chat.response.StreamingChatResponseHandler;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

import reactor.core.publisher.Flux;

@RestController

public class StreamChatModelFluxController {

@Resource

private ChatModel chatModel;

@Resource

private StreamingChatModel streamingChatModel;

@GetMapping("/flux/chat")

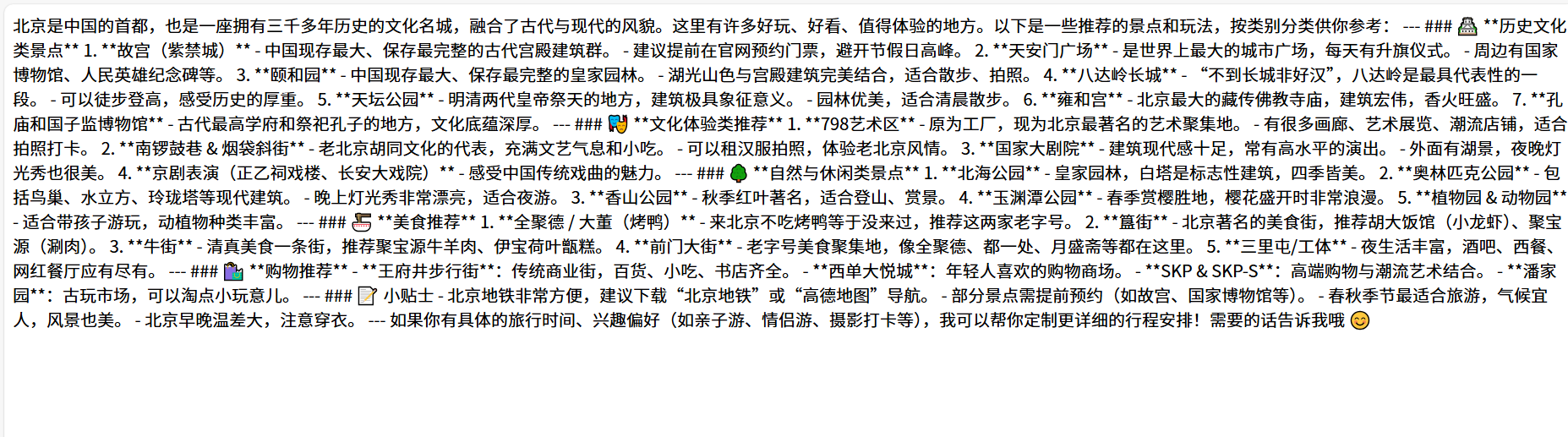

public Flux<String> chat(@RequestParam(value = "prompt"

,defaultValue = "北京有什么好玩的地方") String prompt) {

String chat = chatModel.chat(prompt);

return Flux.just(chat);

}

@GetMapping("/flux/streaming")

public Flux<String> stringFlux(@RequestParam(value = "prompt"

,defaultValue = "西安有什么好玩的地方?") String prompt){

return Flux.create(fluxSink -> streamingChatModel.chat(prompt, new StreamingChatResponseHandler() {

@Override

public void onPartialResponse(String partialResponse) {

fluxSink.next(partialResponse);

}

@Override

public void onCompleteResponse(ChatResponse completeResponse) {

fluxSink.complete();

}

@Override

public void onError(Throwable error) {

fluxSink.error(error);

}

}));

}

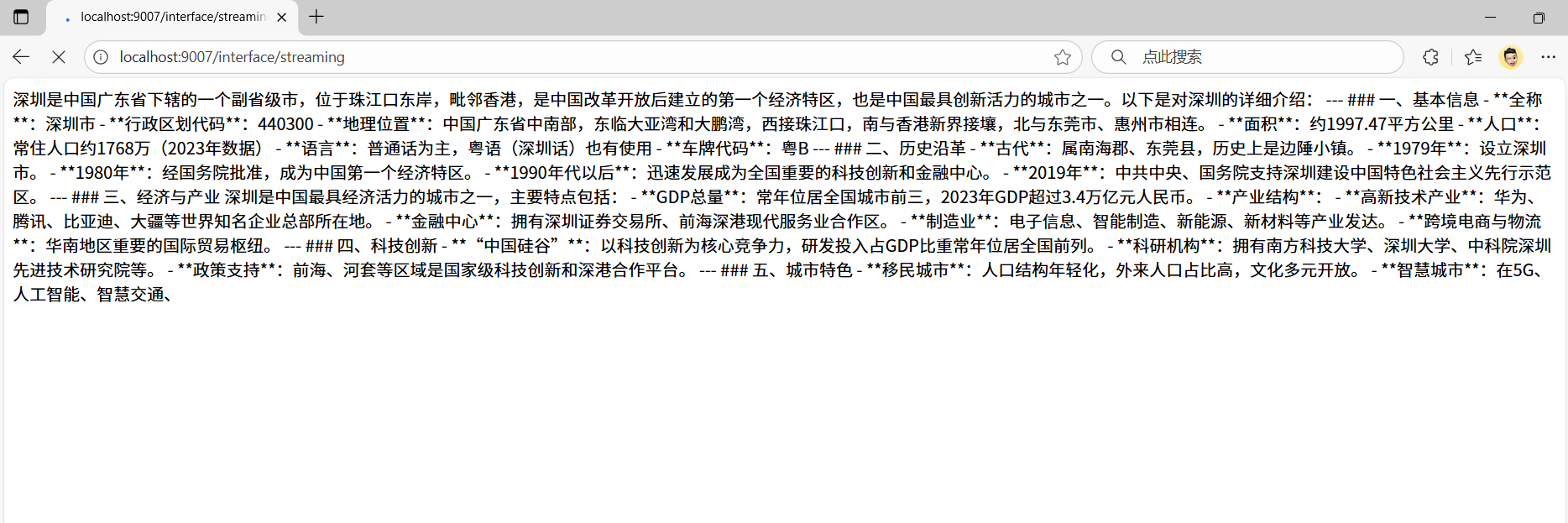

}测试

流式输出

接口式编程(结合Flux)

pom

<properties>

<maven.compiler.target>17</maven.compiler.target>

<maven.compiler.source>17</maven.compiler.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- 高阶api -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<!-- langchain4j 结合web Flux编程 -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-reactor</artifactId>

</dependency>

</dependencies>yaml

server:

port: 9007

# 设置响应的字符编码,避免流式返回输出乱码

servlet:

encoding:

charset: utf-8

enabled: true # 启用http编码支持

force: true # HTTP 请求和响应上强制编码到配置的字符集

spring:

application:

name: LangChain4j-07chat-streamLLMConfig

package com.lazy.config;

import com.lazy.service.ChatAssistant;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.StreamingChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.model.openai.OpenAiStreamingChatModel;

import dev.langchain4j.service.AiServices;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

/**

* 普通对话

* @return

*/

@Bean

public ChatModel chatModelQWen(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

/**

* 配置流式输出

* @return

*/

@Bean

public StreamingChatModel streamingChatModelQWen() {

return OpenAiStreamingChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-plus")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

/**

* 流式接口

* @return

*/

@Bean

public ChatAssistant assistantStreaming(StreamingChatModel streamingChatModel){

return AiServices.create(ChatAssistant.class,streamingChatModel);

}

}ChatAssistant

package com.lazy.service;

import reactor.core.publisher.Flux;

public interface ChatAssistant {

Flux<String> fluxChat(String prompt);

}StreamingChatModelWithInterfaceController

package com.lazy.controller;

import com.lazy.service.ChatAssistant;

import dev.langchain4j.model.chat.ChatModel;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

import reactor.core.publisher.Flux;

@RestController

public class StreamingChatModelWithInterfaceController {

@Resource

private ChatAssistant chatAssistant;

@Resource

private ChatModel chatModel;

@GetMapping("/interface/chat")

public String chat(@RequestParam(value = "prompt",

defaultValue = "介绍一下广州") String prompt){

return chatModel.chat(prompt);

}

@GetMapping("/interface/streaming")

public Flux<String> streaming(@RequestParam(value = "prompt",

defaultValue = "介绍一下深圳") String prompt){

return chatAssistant.fluxChat(prompt);

}

}测试

流式输出

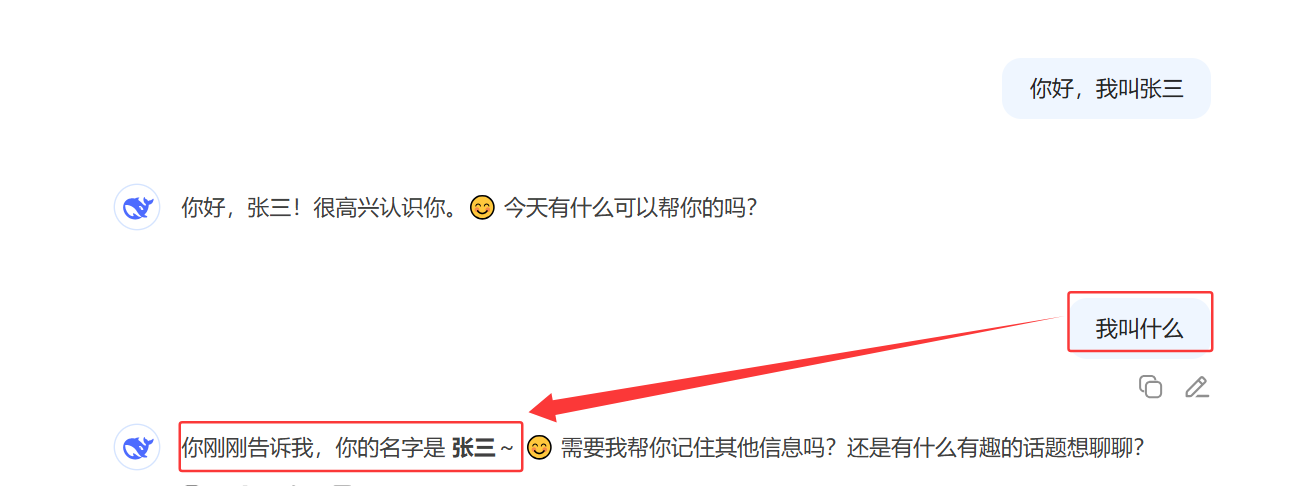

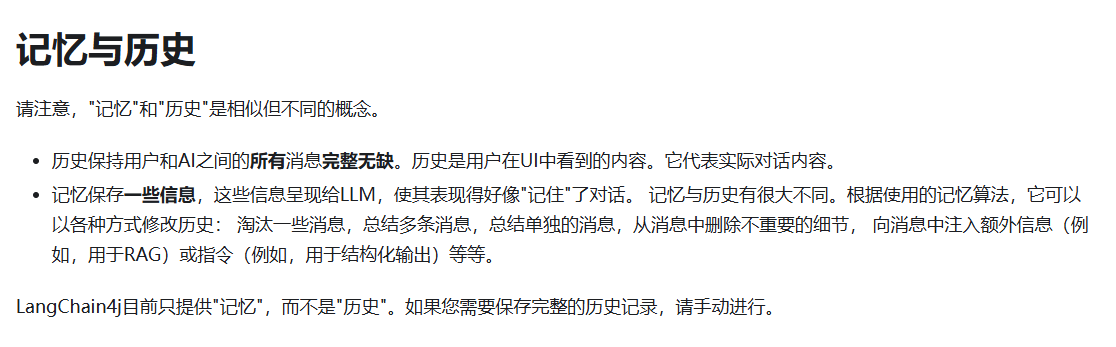

记忆缓存

官网:https://docs.langchain4j.info/tutorials/chat-memory

记忆缓存是聊天系统中的一个重要组件,用于存储和管理对话的上下文信息。它的主要作用是让AI助手能够“记住”之前的对话内容,从而提供连贯和个性化的回复。

持久化

默认情况下,ChatMemory实现在内存中存储ChatMessage。

如果需要持久化,可以实现自定义的ChatMemoryStore, 将ChatMessage存储在您选择的任何持久化存储中:

class PersistentChatMemoryStore implements ChatMemoryStore {

@Override

public List<ChatMessage> getMessages(Object memoryId) {

// TODO: 实现通过内存ID从持久化存储中获取所有消息。

// 可以使用ChatMessageDeserializer.messageFromJson(String)和

// ChatMessageDeserializer.messagesFromJson(String)辅助方法

// 轻松地从JSON反序列化聊天消息。

}

@Override

public void updateMessages(Object memoryId, List<ChatMessage> messages) {

// TODO: 实现通过内存ID更新持久化存储中的所有消息。

// 可以使用ChatMessageSerializer.messageToJson(ChatMessage)和

// ChatMessageSerializer.messagesToJson(List<ChatMessage>)辅助方法

// 轻松地将聊天消息序列化为JSON。

}

@Override

public void deleteMessages(Object memoryId) {

// TODO: 实现通过内存ID删除持久化存储中的所有消息。

}

}

ChatMemory chatMemory = MessageWindowChatMemory.builder()

.id("12345")

.maxMessages(10)

.chatMemoryStore(new PersistentChatMemoryStore())

.build();每当向ChatMemory添加新的ChatMessage时,都会调用updateMessages()方法。 这通常在与LLM的每次交互中发生两次: 一次是添加新的UserMessage时,另一次是添加新的AiMessage时。 updateMessages()方法预期会更新与给定内存ID关联的所有消息。 ChatMessage可以单独存储(例如,每条消息一条记录/行/对象) 或一起存储(例如,整个ChatMemory一条记录/行/对象)。

备注

请注意,从ChatMemory中淘汰的消息也将从ChatMemoryStore中淘汰。 当消息被淘汰时,会调用updateMessages()方法, 传入不包含被淘汰消息的消息列表。

当ChatMemory的用户请求所有消息时,会调用getMessages()方法。 这通常在与LLM的每次交互中发生一次。 Object memoryId参数的值对应于创建ChatMemory时指定的id。 它可以用来区分多个用户和/或对话。 getMessages()方法预期会返回与给定内存ID关联的所有消息。

当调用ChatMemory.clear()时,会调用deleteMessages()方法。 如果您不使用此功能,可以将此方法留空。

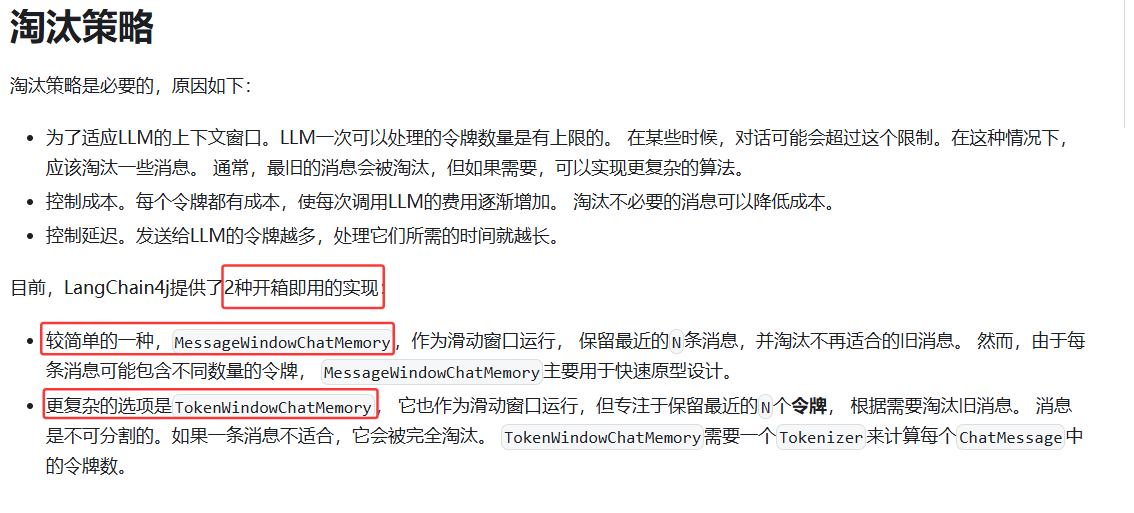

两种主要的ChatMemory实现类

- MessageWindowChatMemory

- 较简单的一种,

MessageWindowChatMemory,作为滑动窗口运行, 保留最近的N条消息,并淘汰不再适合的旧消息。 然而,由于每条消息可能包含不同数量的令牌,MessageWindowChatMemory主要用于快速原型设计。

- 较简单的一种,

- TokenWindowChatMemory

- 更复杂的选项是

TokenWindowChatMemory, 它也作为滑动窗口运行,但专注于保留最近的N个令牌, 根据需要淘汰旧消息。 消息是不可分割的。如果一条消息不适合,它会被完全淘汰。TokenWindowChatMemory需要一个Tokenizer来计算每个ChatMessage中的令牌数。

- 更复杂的选项是

大模型中的Token VS Web开发中的Token

大模型中的token

Web开发中的token

区别

- 目的不同:大模型中的token是为了将文本分割成可处理的单元,便于进行计算;而Web开发中的token主要用于安全地传递用户身份信息

- 生成方式不同:前者通过特定的算法(如BPE)对文本进行分割得到;后者则通常是通过加密算法生成的唯一字符串。

- 应用场景不同:前者应用于文本分析、机器翻译等NLP任务;后者多见于用户登录系统、API 访问控制等领域。

案例

新建module:LangChain4j-08chat-memory

pom

<properties>

<maven.compiler.taget>17</maven.compiler.taget>

<maven.compiler.souce>17</maven.compiler.souce>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- langchain4j low-api -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<!-- langchain4j high-api -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

</dependencies>yaml

server:

port: 9008

servlet:

encoding:

charset: utf-8

enabled: true

force: true

spring:

application:

name: LangChain4j-08chat-memoryChatAssistant

package com.lazy.service;

public interface ChatAssistant {

/**

* 普通聊天对话

* @param prompt 消息

* @return 回复

*/

String chat(String prompt);

}ChatMemoryAssistant

package com.lazy.service;

import dev.langchain4j.service.MemoryId;

import dev.langchain4j.service.UserMessage;

public interface ChatMemoryAssistant {

/**

* 带记忆缓存聊天

* @param userId 用户id

* @param prompt 消息

* @return 回复

*/

String chatMemory(@MemoryId Long userId, @UserMessage String prompt);

}更换模型

LLMConfig

package com.lazy.config;

import com.lazy.service.ChatAssistant;

import com.lazy.service.ChatMemoryAssistant;

import dev.langchain4j.memory.chat.MessageWindowChatMemory;

import dev.langchain4j.memory.chat.TokenWindowChatMemory;

import dev.langchain4j.model.TokenCountEstimator;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.model.openai.OpenAiTokenCountEstimator;

import dev.langchain4j.service.AiServices;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

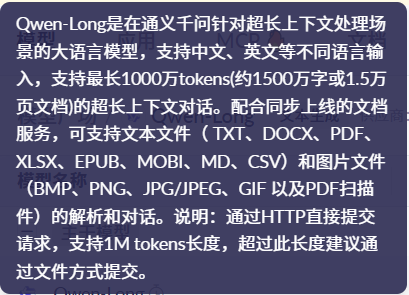

public ChatModel chatModel() {

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-long")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

@Bean(name = "chatAssistant")

public ChatAssistant chatAssistant(ChatModel chatModel) {

return AiServices.create(ChatAssistant.class, chatModel);

}

@Bean(name = "chatMessageMemoryChatMemory")

public ChatMemoryAssistant chatMessageWindowChatMemory(ChatModel chatModel) {

return AiServices.builder(ChatMemoryAssistant.class)

.chatModel(chatModel)

// 每个memoryId对应创建一个ChatMemory,withMaxMessages(int maxMessages) 保存maxMessages条消息

// 如果超过 maxMessages 条消息,将会执行MessageWindowChatMemory类中的clear方法清除消息

.chatMemoryProvider(memoryId -> MessageWindowChatMemory.withMaxMessages(100))

.build();

}

@Bean(name = "chatTokenWindowChatMemory")

public ChatMemoryAssistant chatMemoryAssistant(ChatModel chatModel) {

TokenCountEstimator tokenCountEstimator = new OpenAiTokenCountEstimator("gpt-4");

return AiServices.builder(ChatMemoryAssistant.class)

.chatModel(chatModel)

/**

* withMaxTokens(int maxTokens, TokenCountEstimator tokenCountEstimator)

* maxTokens:要保留的最大token数。聊天内存将保留尽可能多的最新消息,

* 以容纳 maxTokens。信息是不可分割的。如果旧消息不适合,则将其完全逐出。

* tokenCountEstimator:负责计算消息中的token

*/

.chatMemoryProvider(memoryId ->

TokenWindowChatMemory.withMaxTokens(1000,tokenCountEstimator))

.build();

}

}ChatMemoryController

package com.lazy.controller;

import com.lazy.service.ChatAssistant;

import com.lazy.service.ChatMemoryAssistant;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class ChatMemoryController {

@Resource(name = "chatAssistant")

private ChatAssistant chatAssistant;

@Resource(name = "chatMessageMemoryChatMemory")

private ChatMemoryAssistant chatMessageMemoryChatMemory;

@Resource(name = "chatTokenWindowChatMemory")

private ChatMemoryAssistant chatTokenWindowChatMemory;

@GetMapping("/chat")

public String chat() {

String answer01 = "你好,我叫张三";

String assistant = chatAssistant.chat(answer01);

String answer02 = "我叫什么?";

String assistant2 = chatAssistant.chat(answer02);

return result(answer01,assistant,answer02,assistant2);

}

@GetMapping("/chatmemory/chat1")

public String chatMessageMemoryChatMemory() {

String answer01 = "你好,我叫张三";

String assistant = chatMessageMemoryChatMemory.chatMemory(1L,answer01);

String answer02 = "我叫什么?";

String assistant2 = chatMessageMemoryChatMemory.chatMemory(1L,answer02);

return result(answer01,assistant,answer02,assistant2);

}

@GetMapping("/chatmemory/chat2")

public String chatTokenWindowChatMemory() {

String answer01 = "你好,我叫Java";

String assistant = chatTokenWindowChatMemory.chatMemory(1L,answer01);

String answer02 = "我叫什么?";

String assistant2 = chatTokenWindowChatMemory.chatMemory(1L,answer02);

return result(answer01,assistant,answer02,assistant2);

}

private String result(String... answer01){

StringBuilder result = new StringBuilder();

for (String item : answer01) {

result.append(item).append("<br/>");

}

return result.toString();

}

}测试

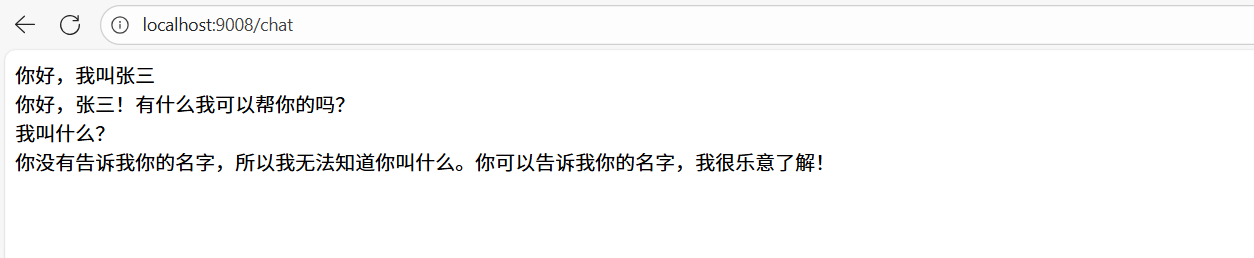

没有聊天记忆

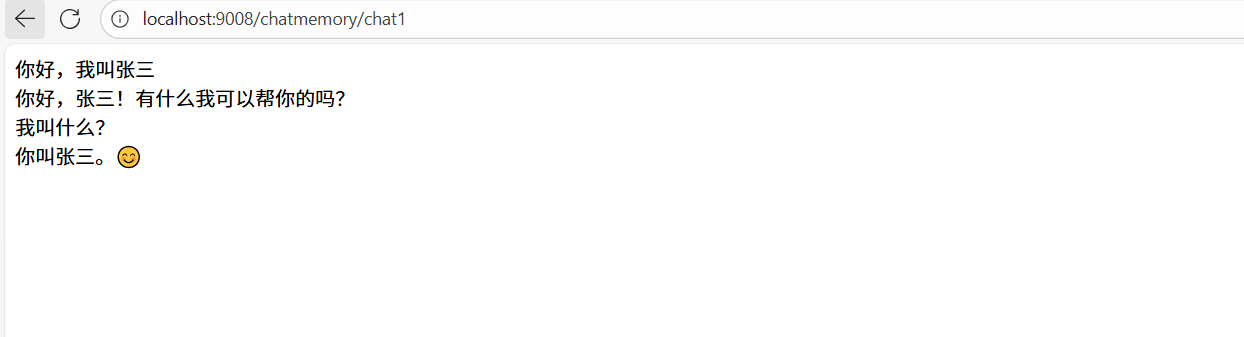

带聊天记忆MessageMemoryChatMemory

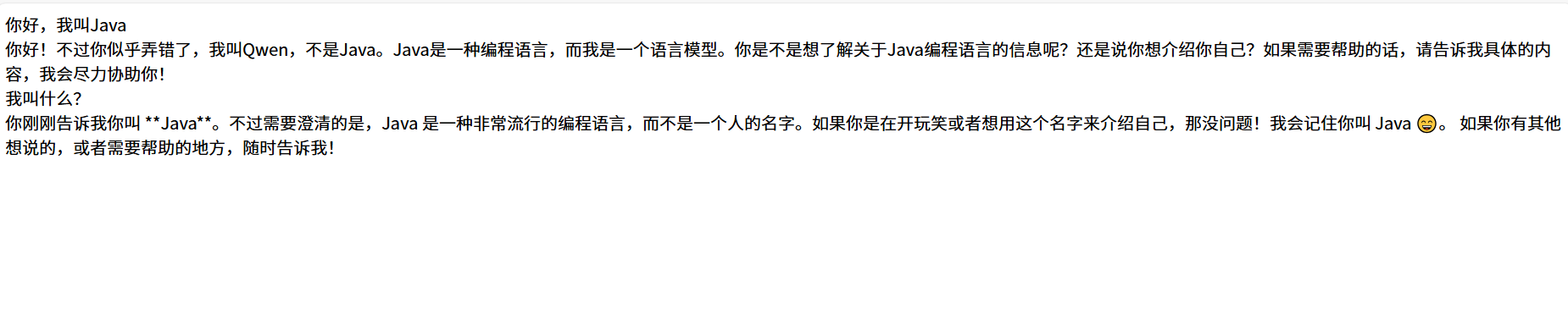

带聊天记忆TokenWindowChatMemory

提示词工程

什么是LangChain4j提示词?

LangChain4j 中的提示词(Prompt)用于引导模型生成特定输出。它们可以是简单的文本字符串,也可以是包含多种信息的复杂结构。

从普通的提问 过渡到 提示词

是什么?

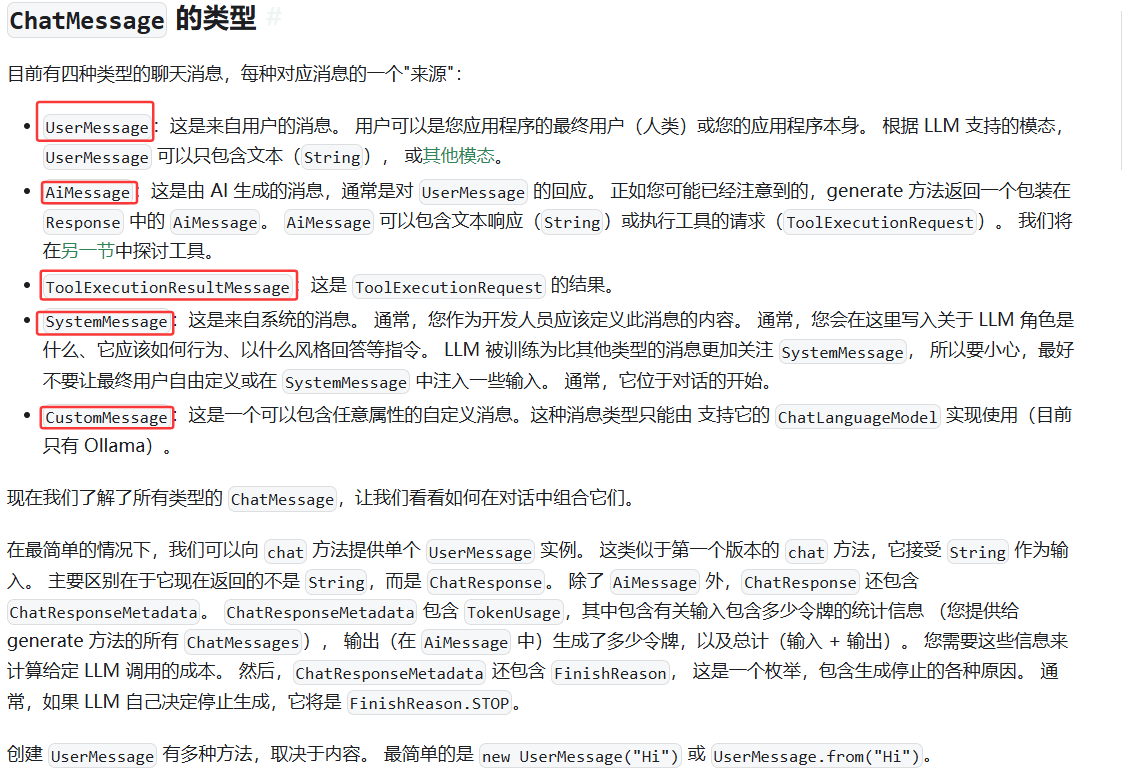

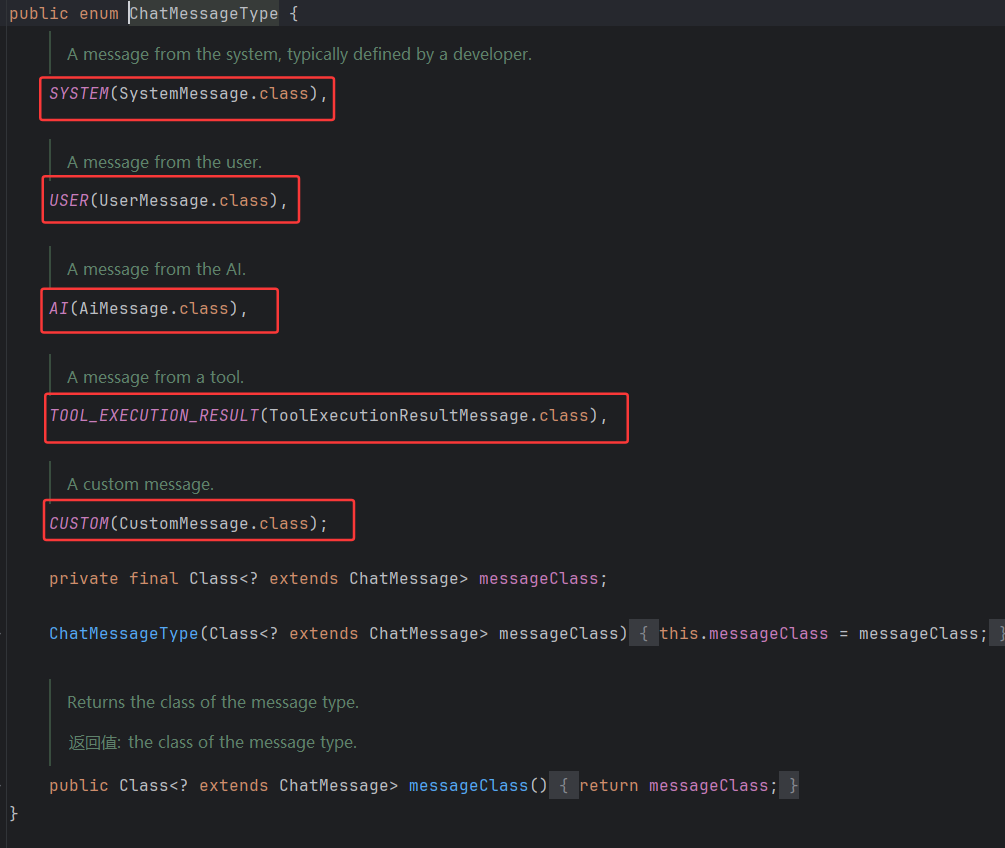

目前有五种类型的聊天消息,每个消息的“来源”对应一种

五大类型

SystemMessage

这是来自系统的消息。通常,作为开发人员,你应该定义这条消息的内容。通常,会在这里写关于LLM在这次对话的角色(例如:医生、律师)、应该如何表现、以什么风格回答等指令。LLM 被训练成比其他类型的消息更关注

SystemMessage,所以要小心,最好不要给最终用户自由访问权限来定义或注入一些输入到SystemMessage中。通常,它位于对话的开始。地址:

https://docs.langchain4j.info/tutorials/ai-services#systemmessageUserMessage

这是来自用户的消息。用户可以是你的应用程序的最终用户(一个人)或应用程序本身。根据LLM支持的模态,

UserMessage可以只包含文本(String),或其他模态地址:https://docs.langchain4j.info/tutorials/ai-services#usermessage

AiMessage

这是由 AI 生成的消息,通常是对

UserMessage的回应。 正如您可能已经注意到的,generate 方法返回一个包装在Response中的AiMessage。AiMessage可以包含文本响应(String)或执行工具的请求(ToolExecutionRequest)。 我们将在另一节中探讨工具。ToolExecutionResultMessage

这是

ToolExecutionRequest的结果CustomMessage

这是一个自定义消息,可以包含任意属性。这种消息类型只能由支持他的

ChatModel实现使用(目前只有 Ollama)

能干嘛

利用LangChain4J框架构建一个专业的法律/医疗/保险/教育等咨询助手。

这个助手将专注于回答中国法律相关问题,对其他领域的咨询则会礼貌地拒绝。

学习角色设定和提示词模板的使用,这是实现这个功能的两个关键要素。

角色设定:塑造AI助手的专业身份

一句话:打造专业的限定能力范围和作用边界的AI助手

code案例

设计要求:

- 使用

SystemMessage明确定义助手的角色和能力范围,将其限定在法律咨询领域。在LangChain4j中,我们主要利用SystemMessage来实现这一点,SystemMessage具有高优先级,能有效地指导模型的整体行为。 - 利用提示词模版(

@UserMessage,@)精确控制输入和期望的输出格式,确保问题被正确理解和回答

module:LangChain4j-09chat-prompt

pom

<properties>

<maven.compiler.target>17</maven.compiler.target>

<maven.compiler.source>17</maven.compiler.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

<version>5.8.38</version>

</dependency>

</dependencies>yaml

server:

port: 9009

servlet:

encoding:

charset: UTF-8

force: true

enabled: true

spring:

application:

name: LangChain4j-09chat-prompt第一组code

@SystemMessage+@UserMessage+@V

新建接口LawAssistant

- 提示词模版:精确控制输入输出

- 支持多个输入参数和条件

SystemMessage具有高优先级,能有效地指导模型的整体行为- 使用

@UserMssage和@V注解

LawAssistant

package com.lazy.service;

import dev.langchain4j.service.SystemMessage;

import dev.langchain4j.service.UserMessage;

import dev.langchain4j.service.V;

public interface LawAssistant {

@SystemMessage("你是一位专业的中国法律顾问,只能回答与中国法律相关的问题" +

"输出限制:对于其他领域的问题禁止回答,直接返回'抱歉,我只能回答于中国法律相关的问题'")

@UserMessage("请回答以下法律问题:{{question}},字数控制在{{length}}以内,输出格式为{{format}}") //{{question}},{{length}},{{format}}占位符

String chat(@V("question") String question, @V("length") int length, @V("format") String format);

}LLMConfig

package com.lazy.config;

import com.lazy.service.LawAssistant;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.service.AiServices;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModel(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-long")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

@Bean

public LawAssistant lawAssistant(ChatModel chatModel){

return AiServices.create(LawAssistant.class, chatModel);

}

}LawPromptController

package com.lazy.controller;

import cn.hutool.core.date.DateUtil;

import com.lazy.service.LawAssistant;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class ChatPromptController {

@Resource

private LawAssistant lawAssistant;

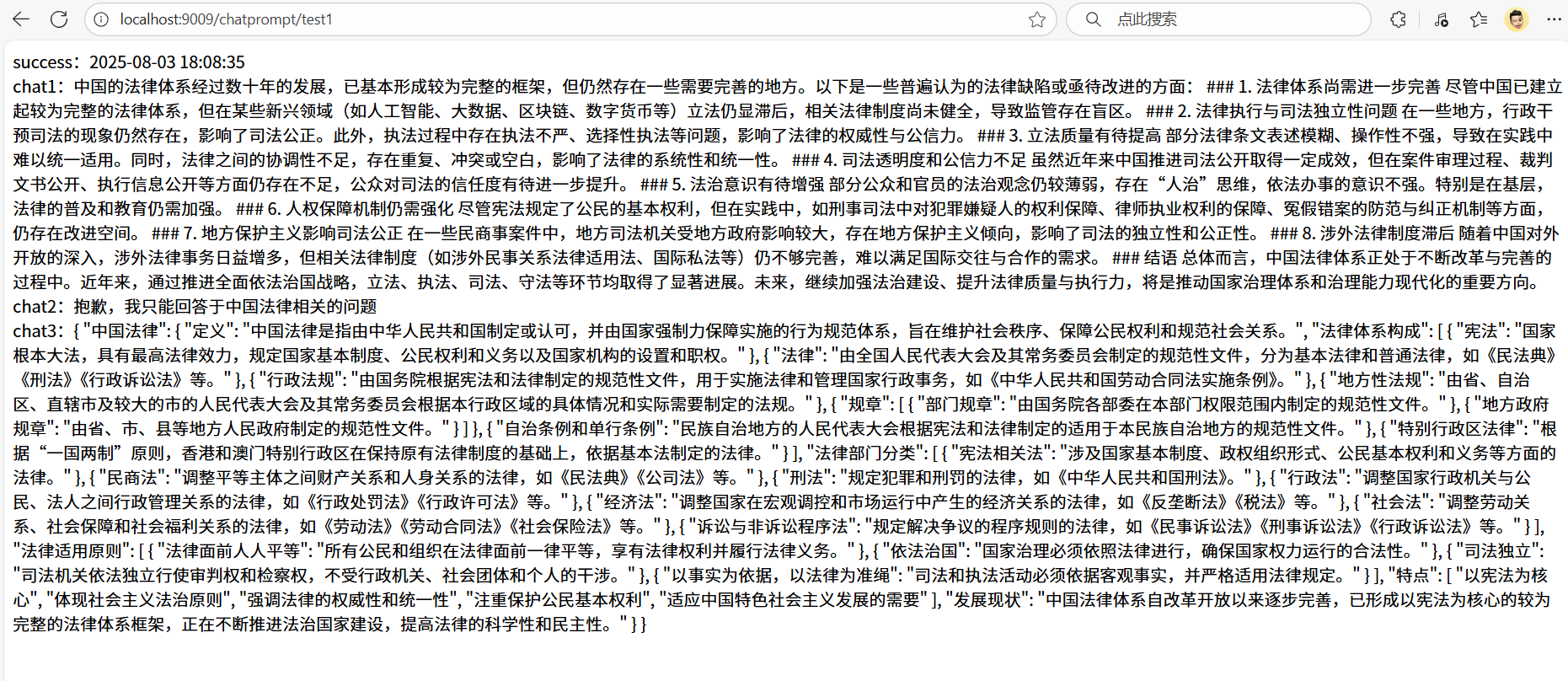

@GetMapping("/chatprompt/test1")

public String test1() {

String law = lawAssistant.chat("中国的法律缺陷包含哪些?", 2000, "md");

System.out.println(law);

String java = lawAssistant.chat("什么是java", 2000, "html");

System.out.println(java);

String chat = lawAssistant.chat("解释一下什么是中国法律", 2000, "json");

return "success:"+ DateUtil.now() + "<br/>chat1:"+law+"<br/>chat2:"+java+"<br/>chat3:"+chat;

}

}

第二组code

新建带着@StrcturedPrompt的业务实体类

LLMConfig

package com.lazy.config;

import com.lazy.service.LawAssistant;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import dev.langchain4j.service.AiServices;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModel(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-long")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

@Bean

public LawAssistant lawAssistant(ChatModel chatModel){

return AiServices.create(LawAssistant.class, chatModel);

}

}LawPrompt

package com.lazy.entities;

import dev.langchain4j.model.input.structured.StructuredPrompt;

import lombok.Data;

@Data

@StructuredPrompt("根据中国法律{{legal}}法律,解答以下问题,字数控制在{{length}}以内,输出格式为{{format}}")

public class LawPrompt {

private String legal;

private Integer length;

private String format;

}LawAssistant

package com.lazy.service;

import com.lazy.entities.LawPrompt;

import dev.langchain4j.service.SystemMessage;

public interface LawAssistant {

@SystemMessage("你是一位专业的中国法律顾问,只回答与中国法律相关的问题" +

"输出限制:对于其他领域的问题禁止回答,直接返回'抱歉,我只能回答于中国法律相关的问题'")

String chat(LawPrompt lawPrompt);

}ChatPromptController

package com.lazy.controller;

import cn.hutool.core.date.DateUtil;

import com.lazy.entities.LawPrompt;

import com.lazy.service.LawAssistant;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class ChatPromptController {

@Resource

private LawAssistant lawAssistant;

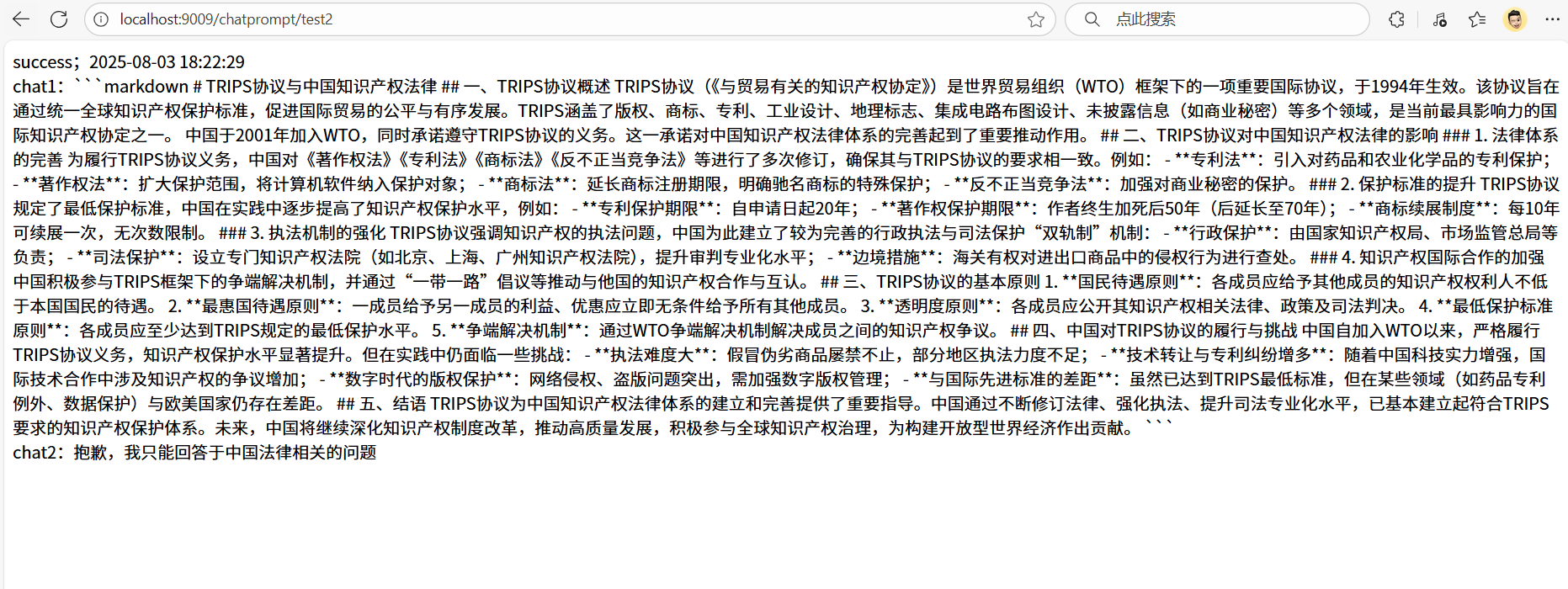

@GetMapping("/chatprompt/test2")

public String test2() {

String chat = lawAssistant.chat(new LawPrompt("知识产权", "TRIPS协议?",2000, "md"));

String chat1 = lawAssistant.chat(new LawPrompt("java", "Date类里面有哪些方法?", 2000, "html"));

return "success;"+DateUtil.now()+"<br/>chat1:"+chat+"<br/>chat2:"+chat1;

}

}

第三组code

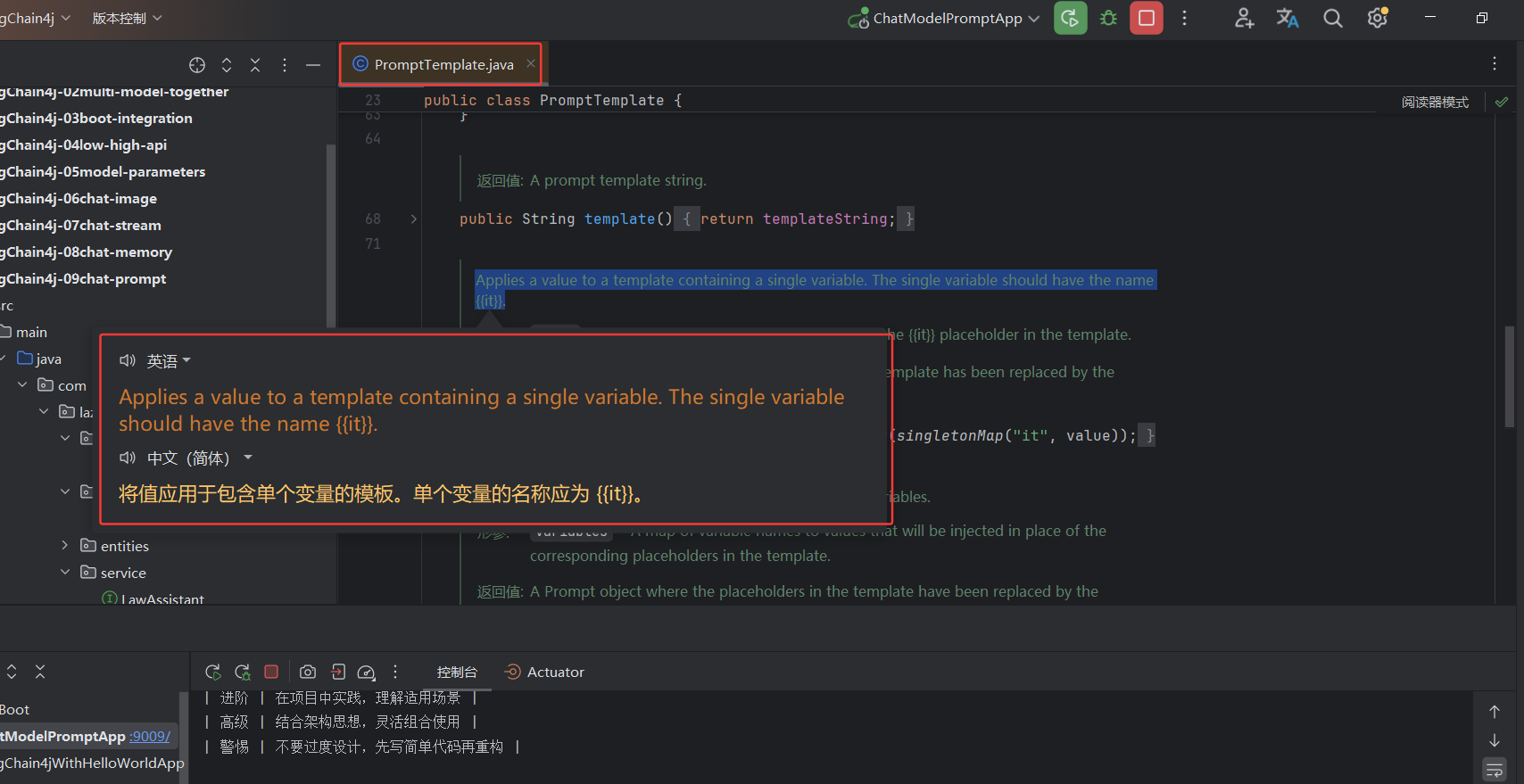

在LangChain4j中有两个对象PromptTemplate以及Prompt用来实现提示词相关功能

LLMConfig

package com.lazy.config;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class LLMConfig {

@Bean

public ChatModel chatModel(){

return OpenAiChatModel.builder()

.apiKey(System.getenv("aliQWen-api"))

.modelName("qwen-long")

.baseUrl("https://dashscope.aliyuncs.com/compatible-mode/v1")

.build();

}

}LawPromptController

package com.lazy.controller;

import cn.hutool.core.date.DateUtil;

import dev.langchain4j.data.message.UserMessage;

import dev.langchain4j.model.chat.ChatModel;

import dev.langchain4j.model.chat.response.ChatResponse;

import dev.langchain4j.model.input.Prompt;

import dev.langchain4j.model.input.PromptTemplate;

import jakarta.annotation.Resource;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

import java.util.Map;

@RestController

public class ChatPromptController {

@Resource

private ChatModel chatModel;

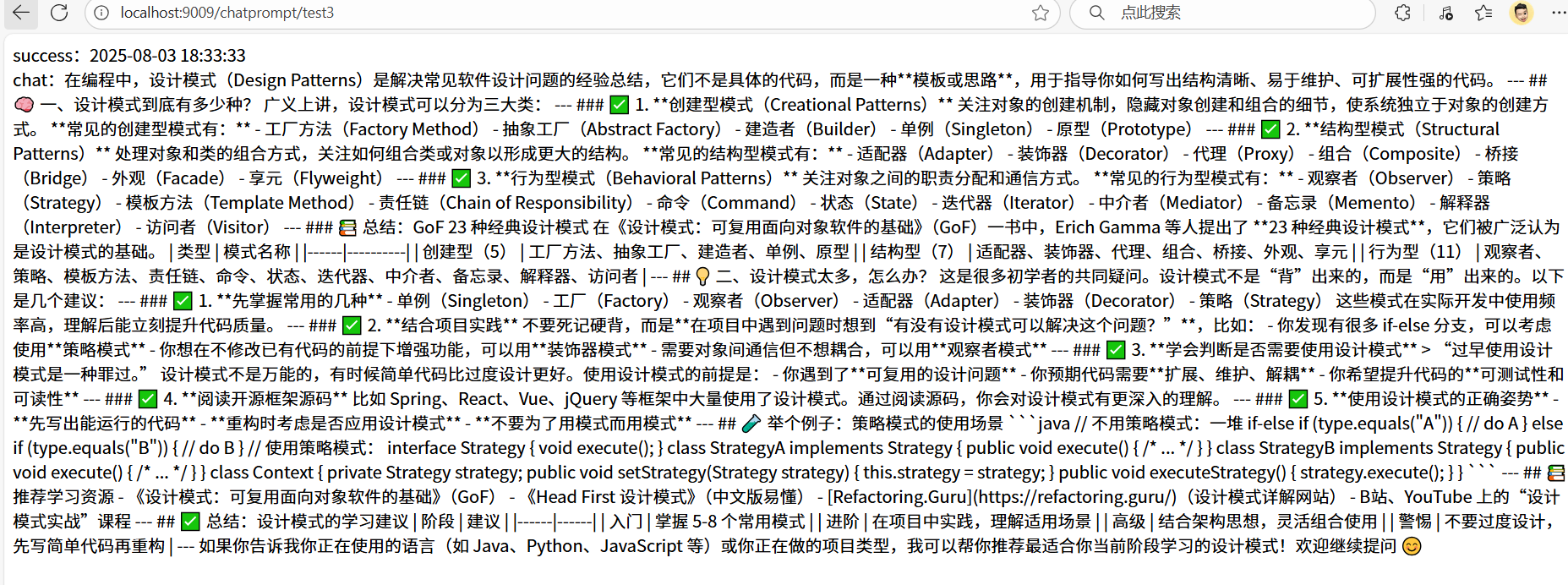

@GetMapping("/chatprompt/test3")

public String test3() {

//默认 PromptTemplate 构造使用 it 属性作为默认占位符

String role = "资深程序员";

String question = "编程中有多少种设计模式";

// 1、构造PromptTemplate 模版

PromptTemplate template = PromptTemplate.from("你是一个{{it}}助手,{{question}}怎么办?");

// 2、由 PromptTemplate 生成 Prompt

Prompt prompt = template.apply(Map.of("it", role, "question", question));

// 3、Prompt 提示词编程 UserMessage

UserMessage userMessage = prompt.toUserMessage();

// 4、调用大模型

ChatResponse chatResponse = chatModel.chat(userMessage);

System.out.println(chatResponse.aiMessage().text());

return "success:"+DateUtil.now()+"<br/>chat:"+chatResponse.aiMessage().text();

}

}

注意:

第一个变量名称占位符必须为it

持久化

"持久化"就是将聊天重要的东西保存到Mysql、Redis、消息中间件...

地址:https://docs.langchain4j.info/tutorials/chat-memory

想要持久化就需要实现ChatMemoryStore接口,并配置到我们的Spring IOC容器里

code案例

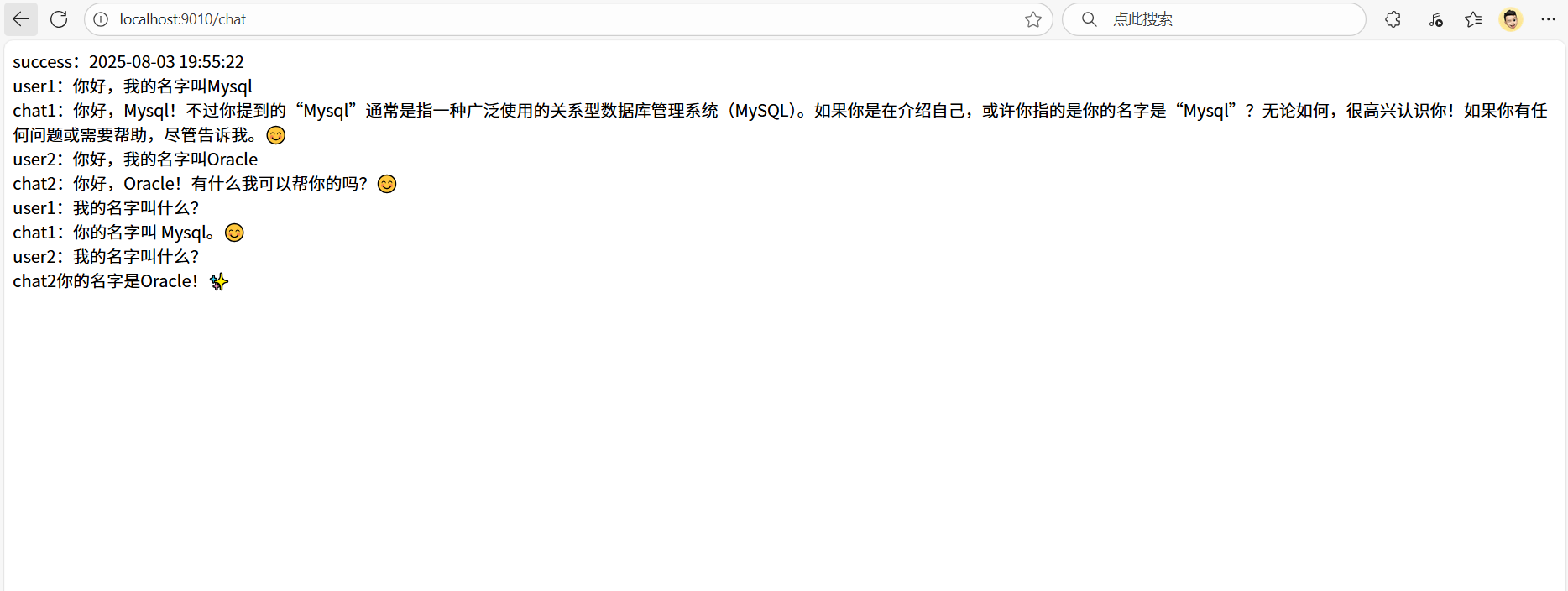

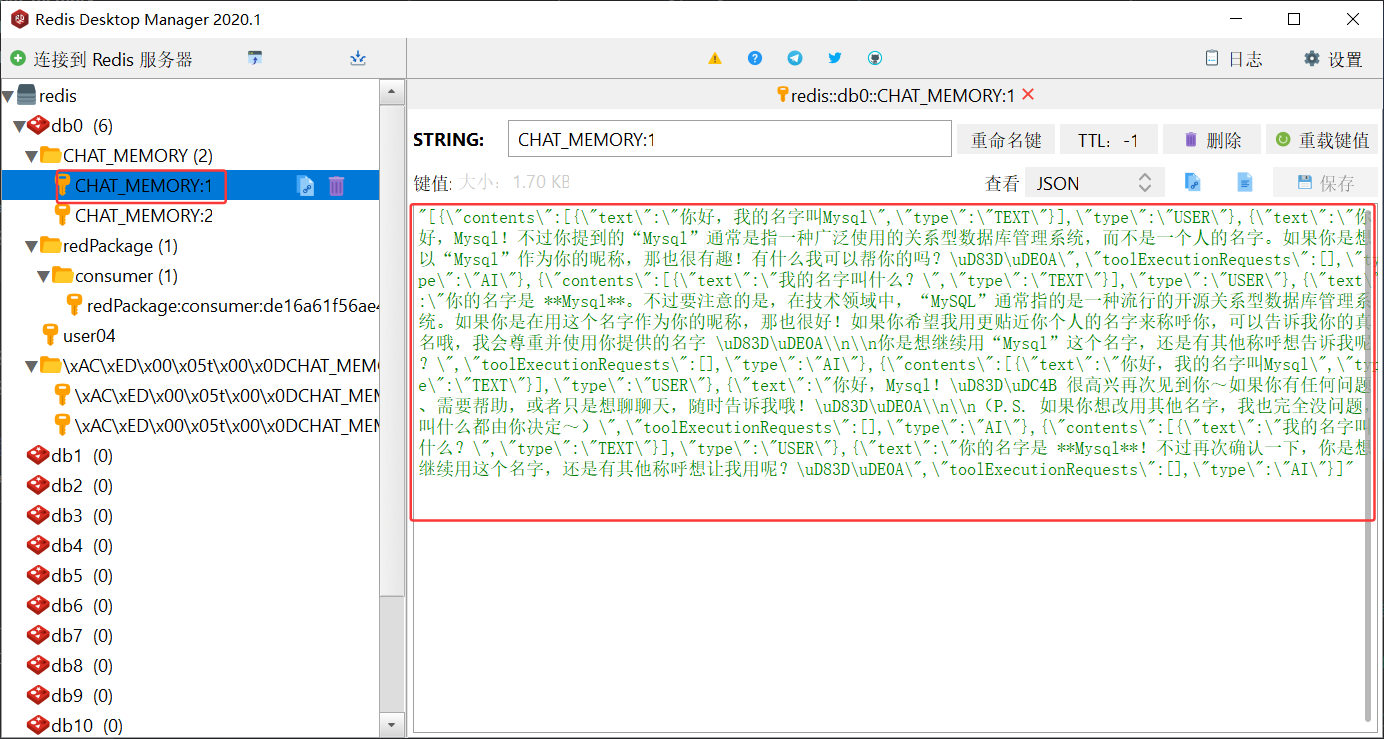

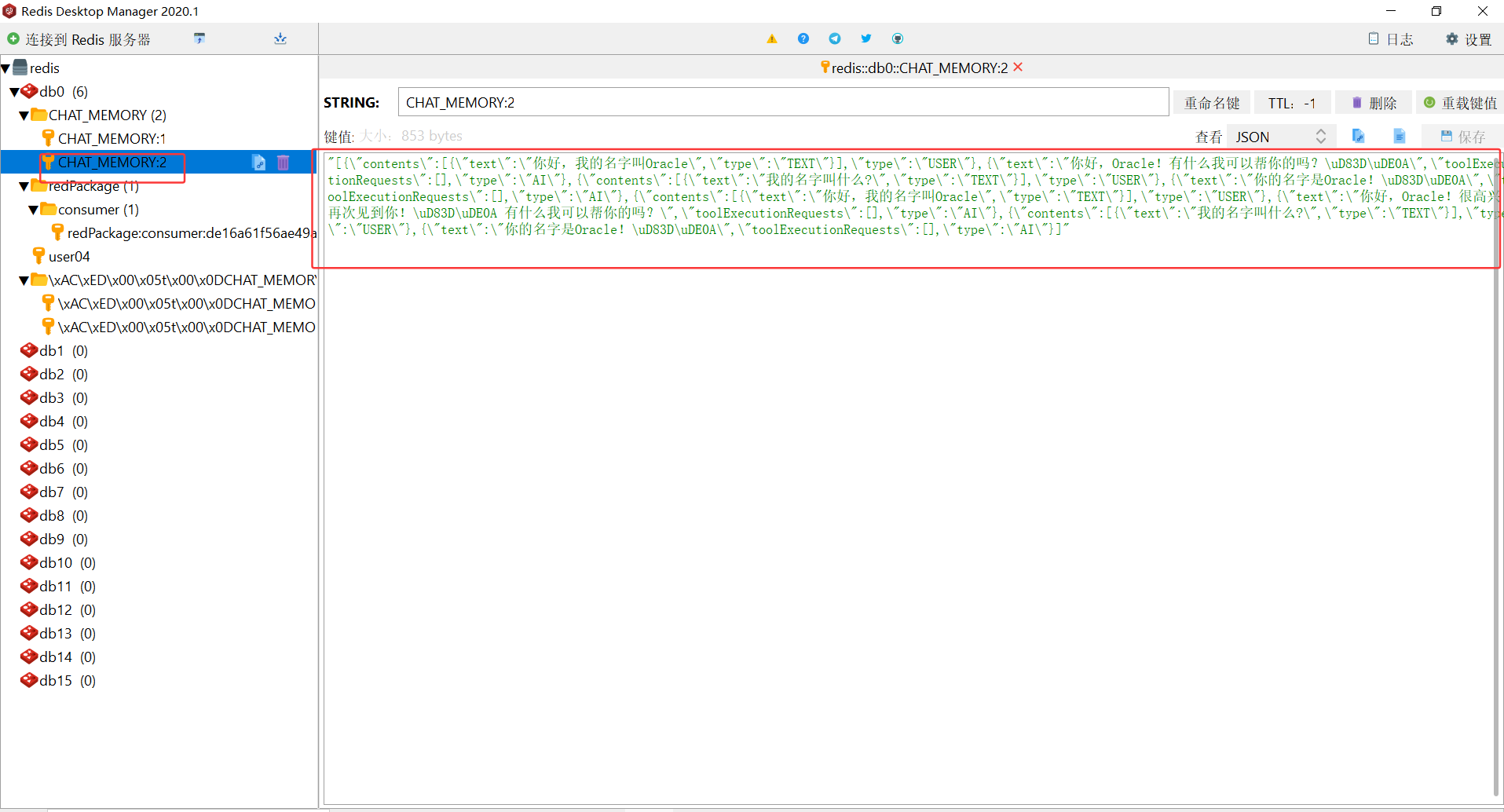

设计要求:将客户和大模型的对话问答保存进redis进行持久化记忆留存

model:LangChain4j-10chat-persistence

pom

<properties>

<maven.comiper.target>17</maven.comiper.target>

<maven.comiper.source>17</maven.comiper.source>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-open-ai</artifactId>

</dependency>

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-redis</artifactId>

</dependency>

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

<version>5.8.38</version>

</dependency>

</dependencies>yaml

server:

port: 9010

servlet:

encoding:

charset: UTF-8

enabled: true

force: true

spring:

application:

name: LangChain4j-10chat-persistence

data:

redis:

database: 0

host: 192.168.0.136

port: 6379

connect-timeout: 3s # 连接超时

timeout: 2s #读取超时

password: redisChatPersistenceAssistant

package com.lazy.service;

import dev.langchain4j.service.MemoryId;

import dev.langchain4j.service.UserMessage;

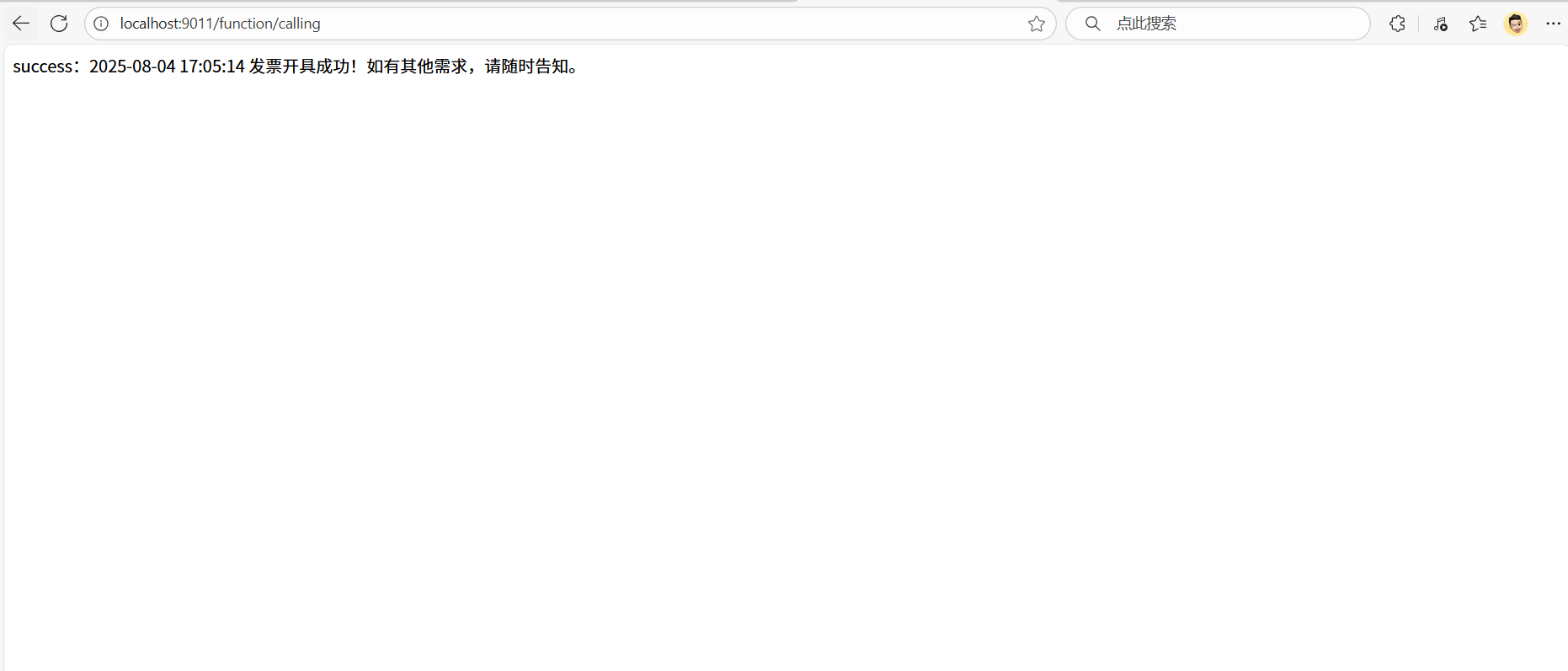

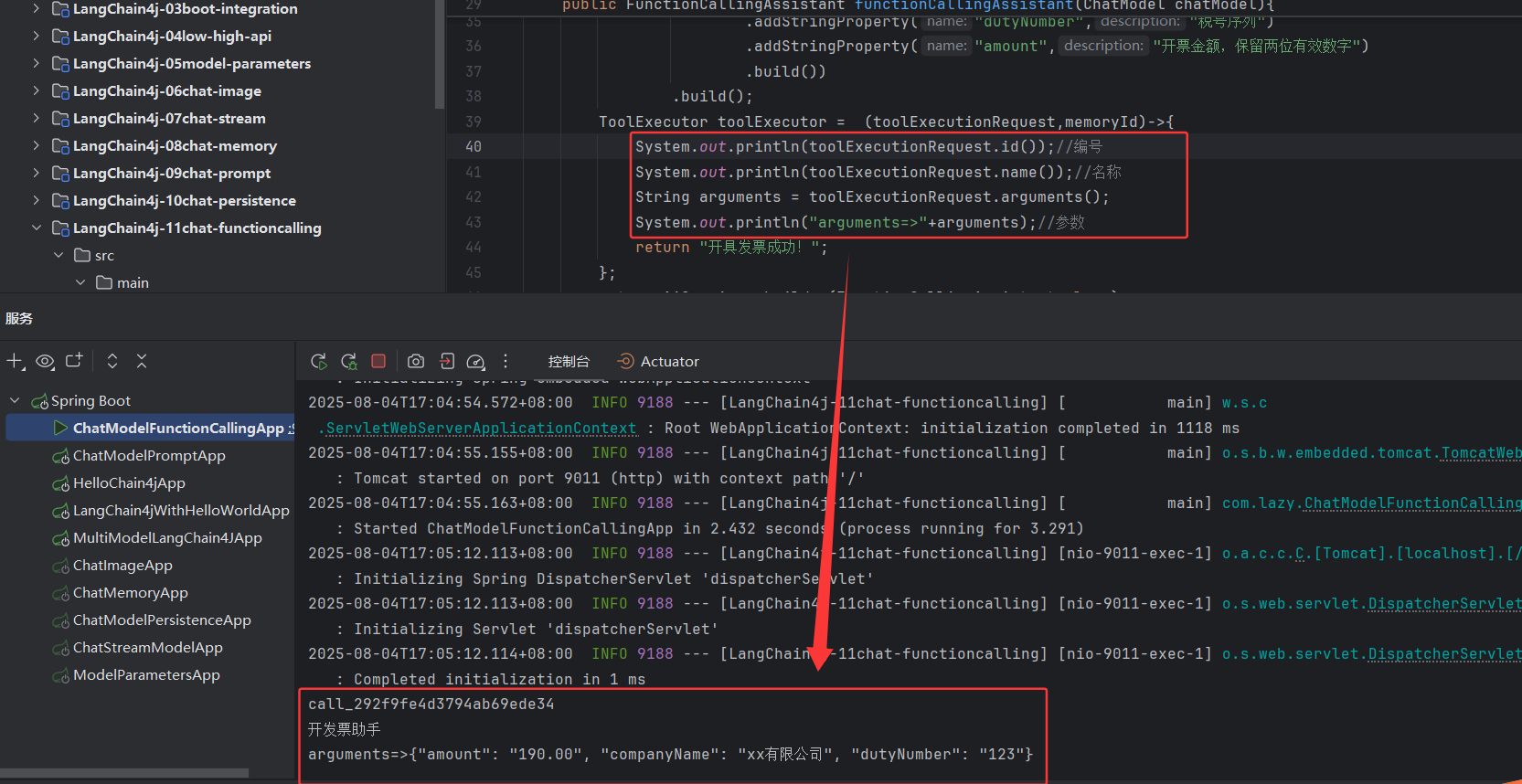

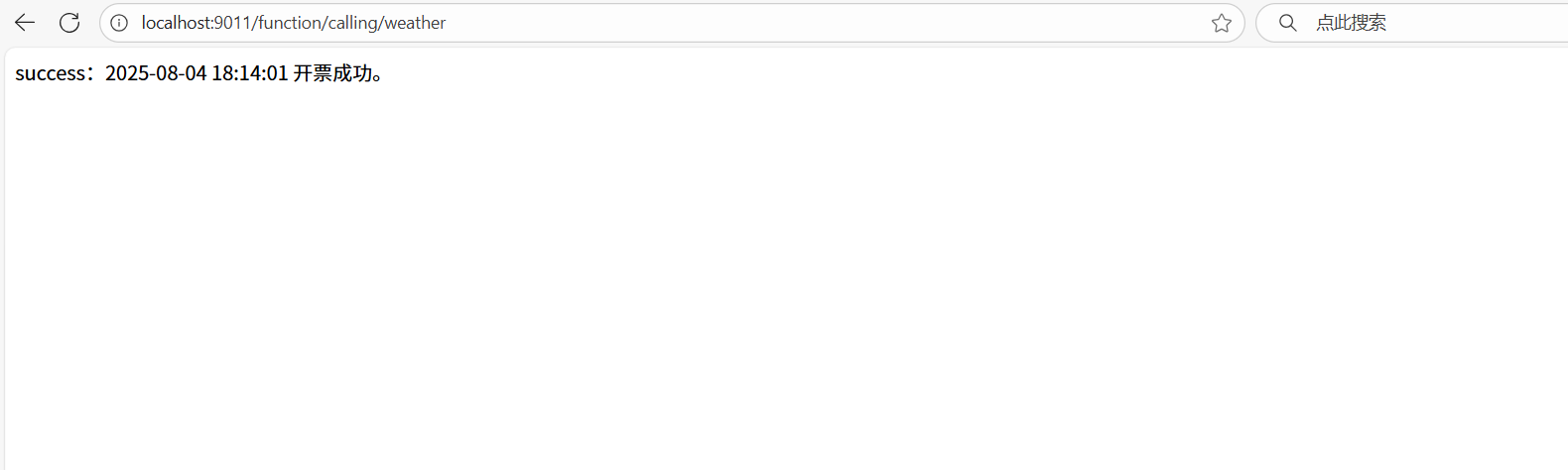

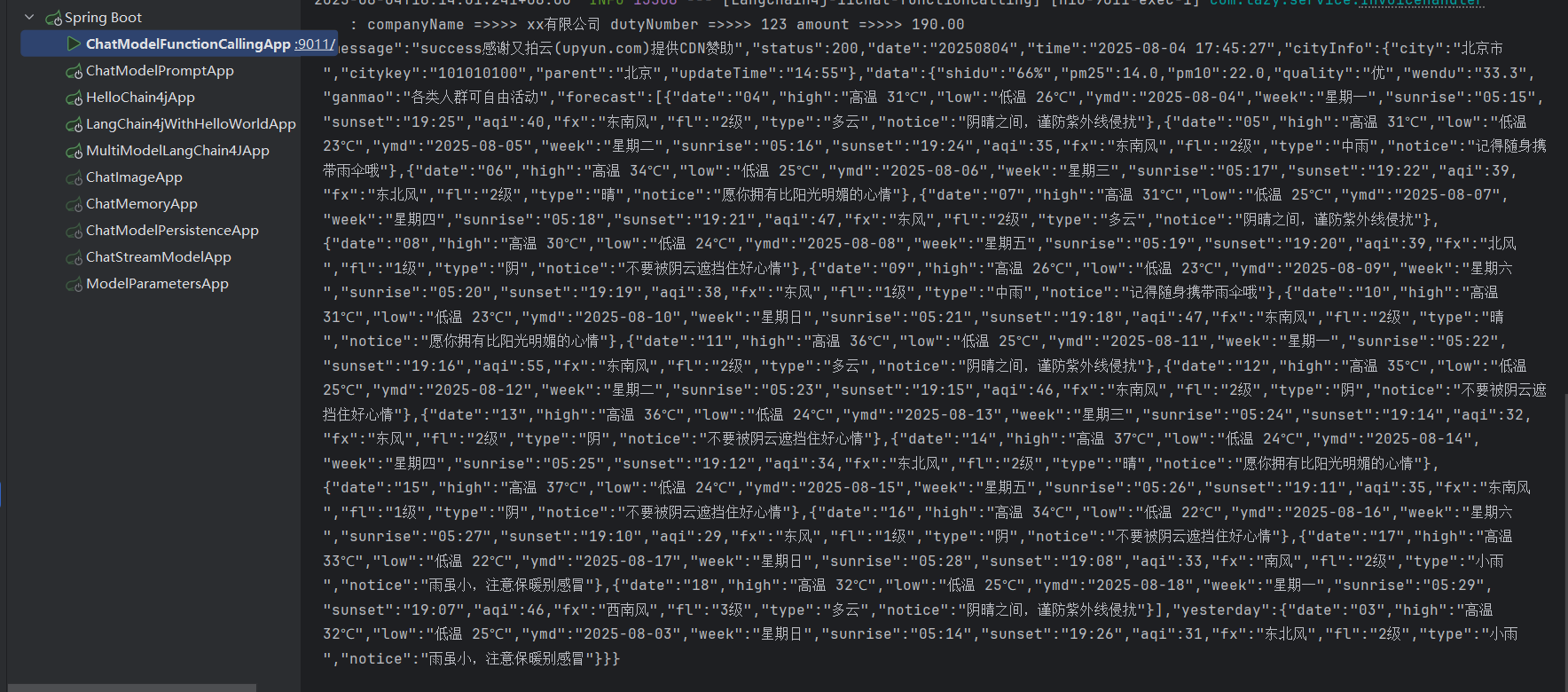

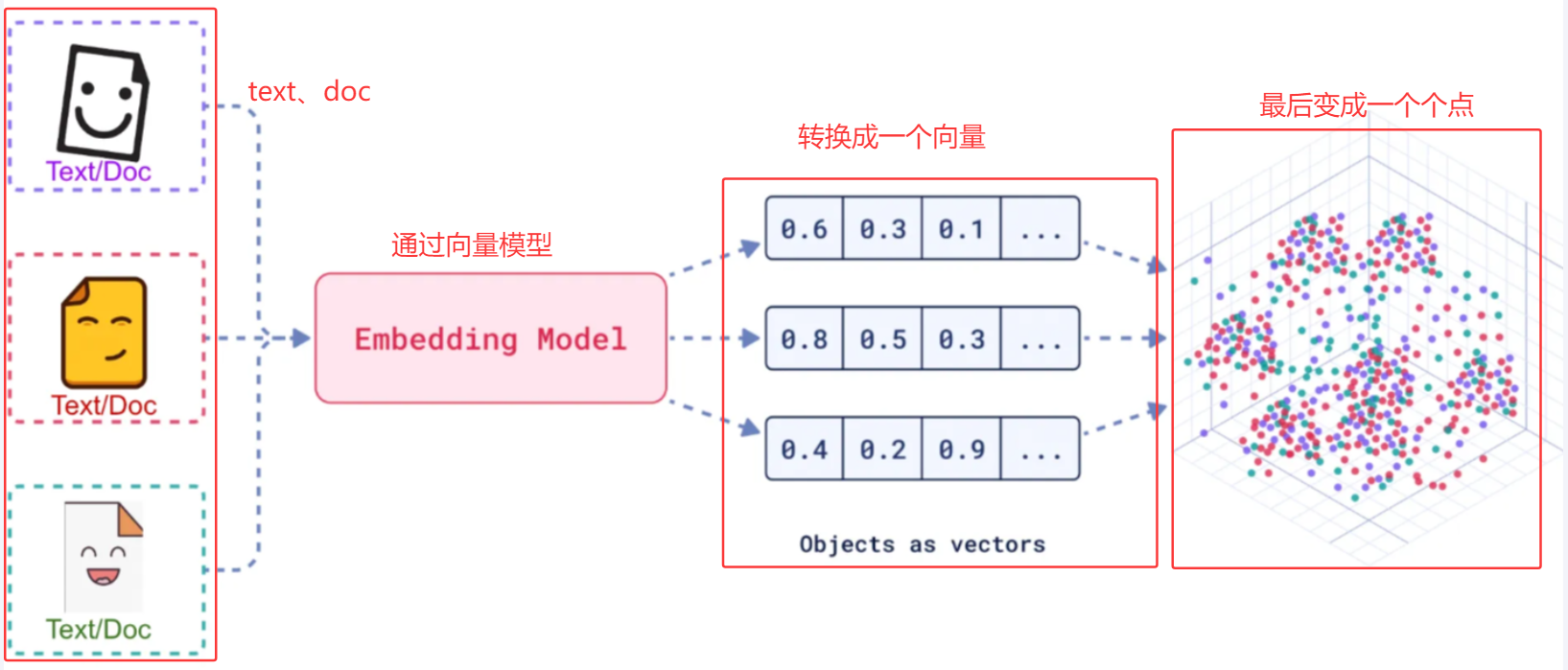

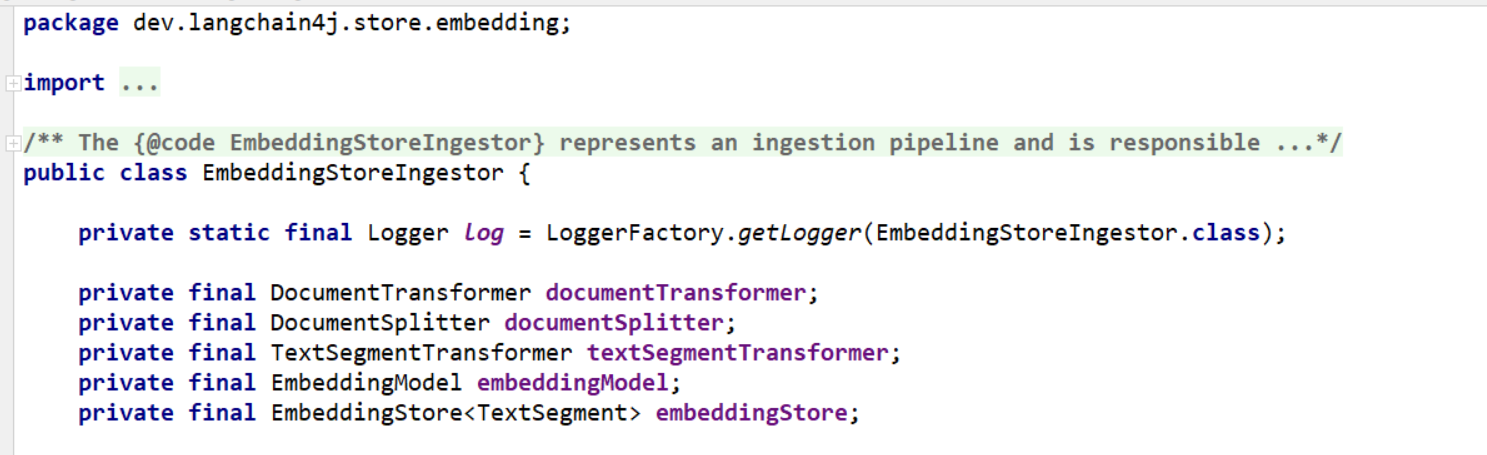

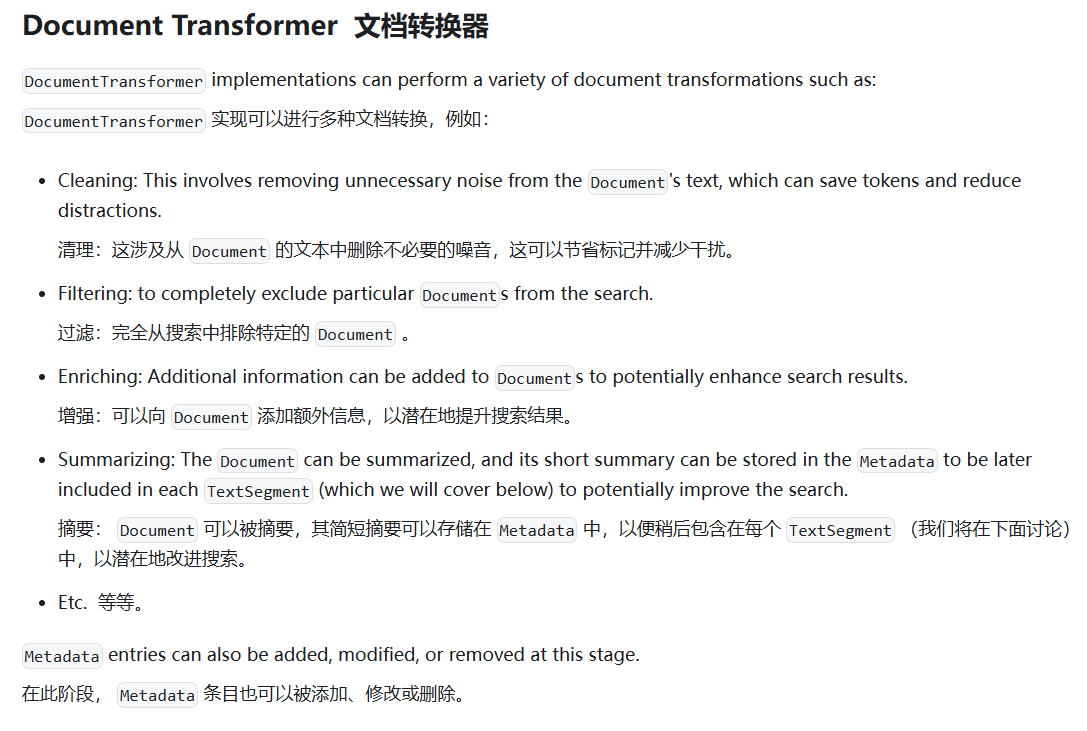

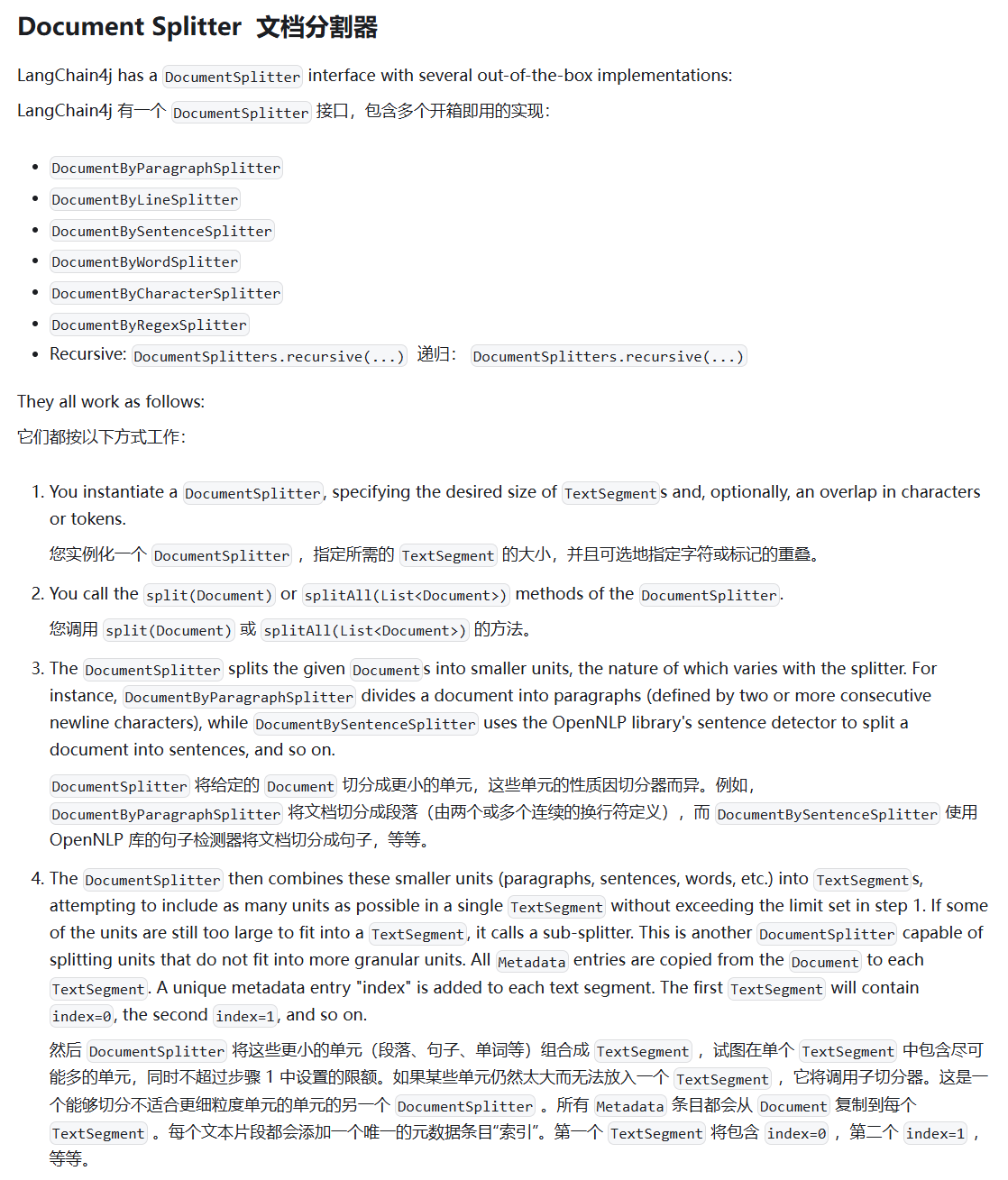

public interface ChatPersistenceAssistant {